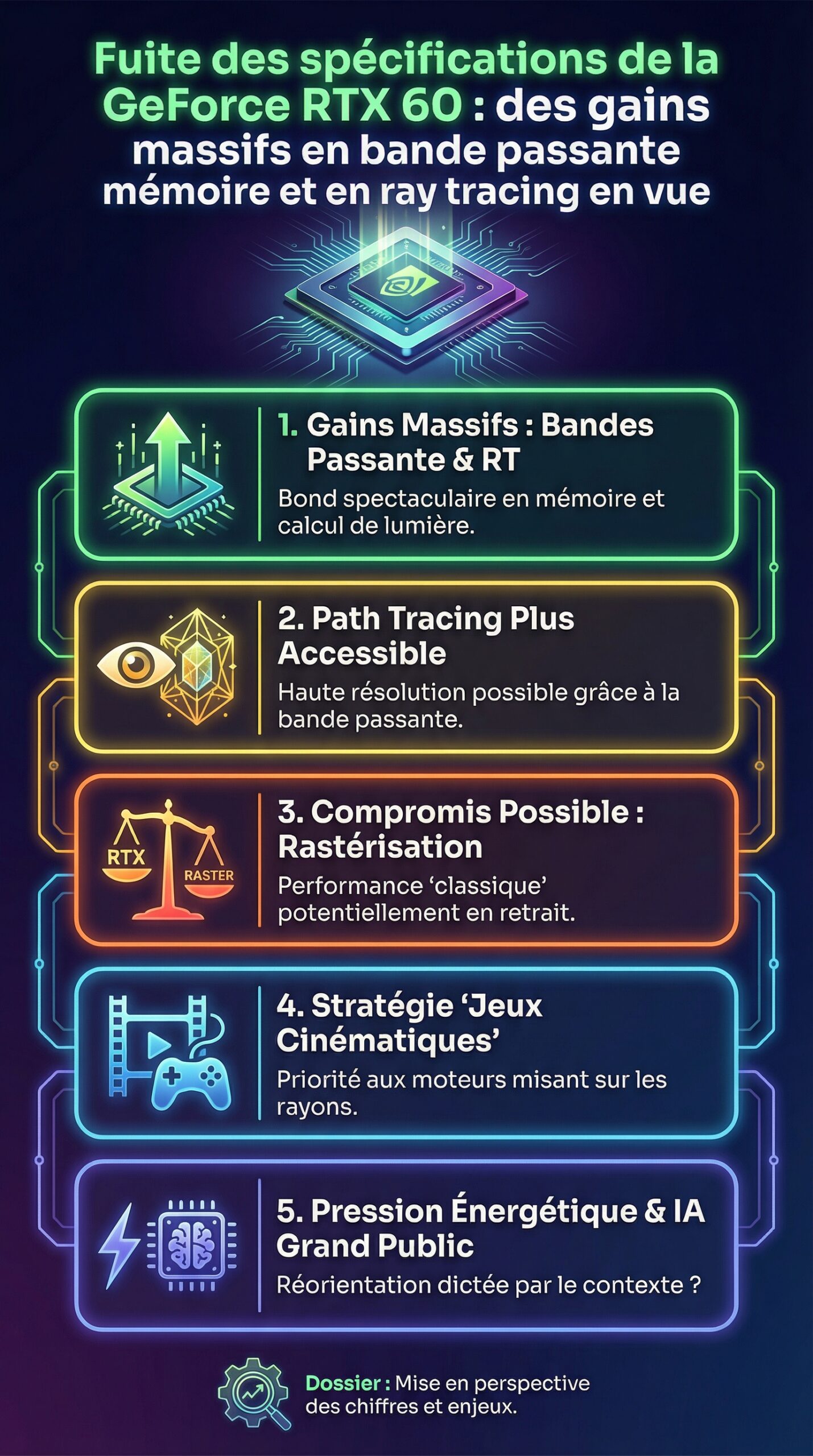

À mesure que les jeux adoptent des éclairages plus réalistes et des mondes plus denses, les attentes autour de la prochaine carte graphique haut de gamme grimpent vite. Dans ce contexte, une fuite des spécifications autour de la GeForce RTX 60 remet la lumière sur un basculement possible chez NVIDIA : privilégier des bonds spectaculaires en ray tracing et en calcul de lumière, quitte à être moins impérial en rendu “classique”. Le signal le plus marquant concerne la mémoire. Car si la bande passante mémoire augmente fortement, les effets de path tracing deviennent plus accessibles, même à haute résolution. Cependant, certaines rumeurs évoquent aussi des compromis sur la rastérisation à fréquence comparable. Faut-il y voir une nouvelle stratégie, pensée pour les jeux “cinématiques” et pour les moteurs qui misent sur les rayons ? Ou une réorientation dictée par la pression énergétique et la montée des charges IA côté grand public ? Ce dossier fait le point, met en perspective les chiffres évoqués, et détaille ce que ces performances GPU pourraient changer concrètement dans les usages.

En Bref

- La fuite des spécifications associe la GeForce RTX 60 à l’architecture Rubin, jusque-là surtout liée à l’IA et aux datacenters.

- La rumeur parle de gains massifs en ray tracing et surtout en path tracing, avec un objectif d’au moins x2 face à la génération précédente sur ce type de charge.

- En contrepartie, la rastérisation “pure” pourrait reculer jusqu’à 35% à fréquences comparables, ce qui redessine l’intérêt selon les jeux.

- Côté mémoire, des capacités de 32 Go, 20 Go et 16 Go sont évoquées selon les modèles, avec une bande passante mémoire pensée pour les scènes lourdes.

- Le calendrier de lancement produit reste flou, mais les rumeurs convergent vers une arrivée plus tardive que prévu pour Rubin côté grand public.

Fuite des spécifications GeForce RTX 60 : ce que la rumeur dit vraiment sur Rubin et les modèles

La fuite des spécifications la plus commentée associe la GeForce RTX 60 à l’architecture Rubin, un nom déjà utilisé dans l’écosystème IA. Jusqu’ici, Rubin a surtout été évoquée dans des contextes datacenter, ce qui alimente une question simple : comment une base “serveur” peut-elle se traduire dans une technologie graphique orientée jeu ? Pourtant, l’idée n’est pas absurde. Les blocs dédiés au lancer de rayons, à l’accélération matricielle et à la gestion de mémoire ont déjà montré qu’ils pouvaient migrer d’un segment à l’autre.

Selon la rumeur attribuée à une source relayée par RedGamingTech, les puces grand public porteraient des désignations de type GR202, GR203 et GR205. La logique de nommage est cohérente avec l’historique de NVIDIA. Ainsi, la supposée RTX 6090 serait basée sur GR202, la RTX 6080 sur GR203, tandis que la RTX 6070 reposerait sur GR205. Ce qui compte ici n’est pas le label, mais la segmentation qu’il implique : un gros die pour le sommet, puis des déclinaisons taillées pour le volume.

Les capacités mémoire citées donnent aussi une indication stratégique. La fuite mentionne 32 Go pour la RTX 6090, 20 Go pour la RTX 6080 et 16 Go pour la RTX 6070. Ces chiffres visent un double objectif. D’un côté, ils sécurisent les usages 4K avec textures lourdes et mods. De l’autre, ils servent les effets avancés, où le stockage de données de scène et de buffers devient vite volumineux. Autrement dit, la mémoire ne serait plus un simple “confort”, mais une condition pour activer des options visuelles agressives.

Pour rendre ces éléments concrets, un fil conducteur aide à projeter l’impact. Un studio fictif, “Atelier Meridian”, prépare un jeu d’action narratif avec éclairage intégralement en path tracing. Dans sa version actuelle, le jeu tourne bien sur les cartes récentes en rendu classique. En revanche, dès que le path tracing est activé, les besoins explosent en buffers, en denoisers et en échanges mémoire. Dans ce cas, une hausse réelle de bande passante mémoire et une réserve VRAM plus large font une différence directe sur la stabilité du framerate. Cette lecture “terrain” donne du poids à la rumeur, car elle correspond aux douleurs actuelles observées sur PC.

Enfin, le thème du calendrier revient souvent dans les discussions. Plusieurs sources de l’écosystème évoquent une fenêtre tardive pour Rubin côté gaming, parfois au second semestre d’une année future. Le point clé, toutefois, concerne moins la date exacte que l’intention : si Rubin arrive, ce serait pour porter une génération où le ray tracing devient central. Cette bascule prépare naturellement l’analyse des gains annoncés et des compromis possibles.

Gains massifs en ray tracing et path tracing : pourquoi la GeForce RTX 60 pourrait changer la donne

Le cœur de cette fuite des spécifications tient en une promesse : au minimum x2 en performance path traced par rapport à la génération précédente. Dit autrement, les jeux qui calculent la lumière via des rayons pour presque tout l’éclairage pourraient passer un cap. Cette perspective a un effet immédiat sur le grand public, car les démonstrations path traced restent souvent “impressionnantes mais lourdes”. L’enjeu est donc la démocratisation : jouer avec ces effets sans sacrifier la fluidité.

La différence entre ray tracing “classique” et path tracing mérite une explication simple. Dans le premier cas, quelques effets ciblés sont tracés : reflets, ombres, parfois illumination partielle. Dans le second, une part bien plus large de la lumière suit des trajectoires simulées, avec rebonds multiples. Le réalisme progresse, mais le coût grimpe. C’est précisément là que des gains massifs deviennent visibles, surtout quand les moteurs s’appuient sur des denoisers et des reconstructions temporelles.

Des titres récents ou très médiatisés sont souvent cités comme vitrines du path tracing. Des jeux comme Cyberpunk 2077 ont déjà montré comment un éclairage complet transforme l’ambiance. D’autres productions, telles que Doom The Dark Ages ou Resident Evil Requiem, sont régulièrement évoquées dans les discussions autour du rendu avancé. Dans ces cas, un doublement de performance ne se traduit pas seulement par “plus de FPS”. Il permet aussi d’augmenter la résolution interne, d’améliorer la qualité des rebonds, ou de limiter l’agressivité du denoising. En pratique, l’image gagne en stabilité, ce qui est souvent plus important que le pic de performance.

Un exemple concret aide à visualiser. Sur une scène urbaine de nuit, le path tracing ajoute des reflets indirects, des couleurs qui rebondissent entre façades, et des sources lumineuses qui “teintent” naturellement les ombres. Or ces détails se perdent quand le moteur doit réduire le nombre de rayons. Si la GeForce RTX 60 tient l’objectif, le jeu pourrait conserver plus de rayons par pixel, donc réduire le bruit sans sur-filtrer. Résultat : une image plus nette en mouvement, avec moins de scintillement sur les grilles, les néons et les vitrines.

Pourquoi ce bond serait-il plausible ? D’abord, NVIDIA a déjà orienté ses innovations vers des pipelines hybrides, où des unités spécialisées traitent des tâches précises. Ensuite, les techniques de reconstruction ont progressé, ce qui augmente le rendement des rayons calculés. Enfin, l’arrivée d’une architecture issue du monde IA pourrait apporter des accélérations ciblées sur les étapes de denoising et de sampling. Même si chaque détail reste à confirmer, la logique technique suit une trajectoire réelle.

Ce saut en lumière calculée pose néanmoins une question : d’où vient le budget matériel ? La section suivante examine l’hypothèse la plus controversée, à savoir un recul en rendu traditionnel, et ses implications sur les choix d’achat.

Pour suivre les rumeurs et les discussions techniques, les chaînes spécialisées donnent souvent un bon thermomètre du marché.

Performances GPU en rasterisation : la rumeur d’un recul jusqu’à 35% et ses conséquences

La partie la plus déroutante de la fuite des spécifications concerne la rastérisation. Selon la rumeur, à fréquences comparables, les performances en rendu traditionnel pourraient baisser jusqu’à 35% par rapport à la génération précédente. Une telle idée va à contre-courant de l’attente habituelle, où chaque génération progresse “partout”. Pourtant, un changement de priorités peut produire ce type de profil, surtout si la puce est optimisée pour des charges spécifiques.

Pour le grand public, la rastérisation reste le mode principal de nombreux jeux. Les titres e-sport, les productions stylisées, ou les jeux optimisés pour tourner sur une large gamme de machines dépendent moins du ray tracing. Dans ces cas, un recul brut serait difficile à justifier. Cependant, le marché PC en 2026 montre une réalité : les options RT deviennent courantes, et les studios utilisent de plus en plus des pipelines hybrides. Ainsi, le “tout raster” pur perd du terrain dans les blockbusters.

Il faut aussi distinguer plusieurs scénarios. Un recul “clock-for-clock” ne signifie pas forcément un recul en pratique. Une puce peut viser des fréquences différentes, ou dépendre davantage de techniques d’upscaling pour délivrer l’expérience attendue. De même, une baisse en raster peut être compensée par une meilleure efficacité dans les tâches annexes : décompression d’assets, gestion de caches, ou accélération des shaders complexes. En clair, la métrique brute ne raconte pas toute l’histoire.

Pour illustrer, reprenons “Atelier Meridian”. Le studio propose deux modes : un mode compétitif à haute fréquence d’image, et un mode cinéma avec path tracing. Sur le premier, la rastérisation domine, donc la carte devrait briller en FPS “secs”. Sur le second, le pipeline s’appuie sur des rayons, des denoisers et des reconstructions. Si la GeForce RTX 60 sacrifie une part de raster pour doubler le path tracing, le mode cinéma devient enfin jouable à haute résolution, ce qui change la perception du produit. La carte ne vise alors pas le même “contrat” qu’avant.

Pour l’acheteur, la conséquence est simple : il faudra acheter selon les jeux. Une liste de vérifications rapides réduit le risque de déception :

- Identifier les titres joués le plus souvent, et vérifier leur dépendance au ray tracing.

- Regarder les benchmarks en raster et en RT, séparément, plutôt qu’un score global.

- Évaluer la résolution cible (1440p, 4K) et l’intérêt de l’upscaling.

- Surveiller la VRAM nécessaire avec textures élevées et mods, surtout en monde ouvert.

- Prendre en compte la consommation et le bruit, car le confort compte autant que les FPS.

Ce point est souvent négligé : un produit peut être excellent, mais seulement pour un profil d’usage. Dans un contexte de lancement produit potentiellement tardif, la concurrence aura le temps de se positionner. Il faudra donc des mesures indépendantes pour trancher entre promesse RT et compromis raster. Le sujet mène naturellement à la mémoire, car la montée du path tracing met la bande passante mémoire au centre du jeu.

Bande passante mémoire et VRAM : pourquoi la fuite RTX 60 insiste sur la capacité et le débit

Dans l’univers GPU, la bande passante mémoire agit comme une autoroute. Quand les textures, les buffers et les structures d’accélération RT circulent vite, la puce respire. À l’inverse, un goulet d’étranglement mémoire peut ruiner un gain théorique en calcul. C’est pourquoi la fuite des spécifications centrée sur la GeForce RTX 60 attire l’attention dès qu’elle évoque des capacités élevées. La quantité de VRAM n’est pas qu’un argument marketing, car elle conditionne le niveau de détails réellement utilisable.

Les chiffres évoqués — 32 Go, 20 Go, 16 Go selon les modèles — résonnent avec une tendance nette. Les jeux récents chargent davantage de données en mémoire, notamment à cause des textures 4K, des environnements ouverts, et des packs haute définition. Ajoutons le ray tracing : les structures BVH, les buffers de denoising, et les historiques temporels consomment aussi de l’espace. Par conséquent, même si la puissance brute est suffisante, une VRAM limitée peut provoquer du stuttering, car des transferts vers la RAM système se déclenchent.

Un exemple courant en 2026 concerne les joueurs qui combinent 4K, textures ultra et mods. Sur certains titres, passer de 12 à 16 Go réduit fortement les à-coups, alors que le framerate moyen bouge peu. Cette nuance compte, car l’expérience perçue dépend de la régularité. Ainsi, une RTX 6070 à 16 Go peut parfois “paraître” plus stable qu’un modèle plus rapide mais plus contraint en mémoire, selon le scénario. Les capacités annoncées prennent donc un sens pratique.

Le débit, lui, reste l’autre moitié de l’équation. Sans entrer dans des spéculations de bus ou de type de mémoire non confirmées, l’idée de gains massifs en path tracing suppose un sous-système mémoire plus musclé. En effet, les rayons multiplient les accès à des données dispersées : matériaux, géométrie, textures, et tables d’échantillonnage. Si le débit augmente, la carte maintient plus facilement un niveau de qualité stable. À l’inverse, si le calcul RT progresse mais que la mémoire suit mal, le bénéfice s’effondre en situation réelle.

Le fil conducteur “Atelier Meridian” illustre bien la contrainte. Le studio active des matériaux complexes, comme des tissus micro-détaillés et des surfaces humides. Ces shaders nécessitent plus de données, donc plus d’échanges mémoire. En path tracing, le problème se renforce, car les rayons interrogent la scène à de nombreux endroits. Dans ce cadre, l’amélioration de la bande passante mémoire limite les micro-pauses et permet d’éviter certains compromis visuels. L’insight est clair : la mémoire devient un facteur d’image, pas seulement un facteur de performance.

Pour compléter la veille, d’autres analyses vidéo permettent de comparer les orientations “raster versus RT” et les impacts mémoire sur les jeux.

Lancement produit GeForce RTX 60 : comment lire les rumeurs et préparer un achat rationnel

Les rumeurs de lancement produit autour de la GeForce RTX 60 circulent souvent avec des fenêtres larges. Cela crée un effet classique : certains acheteurs gèlent leur configuration, tandis que d’autres achètent maintenant, par fatigue d’attendre. Une approche pragmatique consiste à découper la décision en critères mesurables, plutôt qu’en dates. D’abord, la question est simple : quels jeux et quels usages doivent être servis dans les six à douze mois ? Ensuite, les options deviennent claires : acheter une solution actuelle, ou patienter pour une architecture possiblement centrée sur le ray tracing.

Le marché a aussi changé. En 2026, une carte graphique ne sert plus seulement au jeu. Le streaming, la création vidéo, et certaines tâches IA locales entrent dans la routine des utilisateurs. Ainsi, la VRAM et les accélérateurs matriciels pèsent davantage. Si Rubin vient du monde datacenter, certains y verront une opportunité : une puce plus à l’aise sur des workloads modernes, même si la rastérisation brute n’explose pas. Cette lecture explique pourquoi une fuite peut évoquer un profil “non universel” sans que ce soit incohérent.

Pour éviter les achats impulsifs, un plan d’action concret aide. Il repose sur la mesure et la comparaison, ce qui correspond à l’esprit hardware :

- Comparer les performances GPU sur trois axes : raster, RT, et stabilité (1% low) dans des scènes lourdes.

- Vérifier les contraintes de boîtier : longueur de carte, airflow, et capacité de l’alimentation.

- Examiner le coût total : carte, éventuel upgrade PSU, et écran si la 4K devient un objectif.

- Lire les retours de pilotes durant les premières semaines, car la maturité logicielle influence les résultats.

Un cas d’école illustre bien la méthode. Un joueur équipé d’un écran 1440p 165 Hz joue à des titres compétitifs, avec peu ou pas de ray tracing. Dans ce scénario, une carte “RT-first” n’est pas forcément la meilleure allocation de budget. À l’inverse, un joueur en 4K, attiré par les modes path traced et les expériences solo, profite davantage d’une génération qui vise des gains massifs sur ces effets. La même gamme peut donc être “parfaite” ou “décevante” selon le profil.

Enfin, la façon de suivre les fuites compte. Les informations qui citent des noms de puces et des capacités mémoire sont souvent plus structurées que les “scores” sans contexte. Cependant, seule une annonce officielle verrouille le tableau. En attendant, une règle reste fiable : préparer son achat autour de ses usages, puis ajuster à la sortie des tests. Cette discipline réduit le bruit, et elle prépare la dernière partie utile : répondre aux questions fréquentes que posent ces rumeurs.

La GeForce RTX 60 va-t-elle vraiment doubler les performances en ray tracing ?

Les rumeurs évoquent au moins x2 en path tracing, ce qui viserait surtout les jeux qui calculent l’éclairage via des rayons. Concrètement, cela améliorerait la fluidité, mais aussi la stabilité d’image avec moins de bruit et de scintillement. La confirmation dépendra des tests indépendants et de la maturité des pilotes au moment du lancement produit.

Pourquoi une fuite des spécifications parlerait d’une baisse en rasterisation jusqu’à 35% ?

L’hypothèse la plus logique est un changement de priorités dans la technologie graphique, avec davantage de ressources dédiées au ray tracing, au denoising et aux pipelines hybrides. Dans ce cas, certains jeux “raster-first” pourraient moins profiter de la nouvelle génération, tandis que les titres path traced verraient un gain net.

La bande passante mémoire est-elle aussi importante que la puissance brute du GPU ?

Oui, car la bande passante mémoire conditionne la vitesse d’accès aux textures, aux buffers et aux structures RT. Quand le débit est insuffisant, des limitations apparaissent malgré une puce rapide, avec du stuttering ou une chute dans les scènes lourdes. C’est pourquoi VRAM et sous-système mémoire restent centraux pour les performances GPU réelles.

32 Go de VRAM sur une carte graphique, est-ce utile pour jouer ?

Pour la majorité des joueurs, 32 Go ne seront pas indispensables. En revanche, cela peut devenir pertinent en 4K avec textures très lourdes, mods, ou certains jeux qui poussent le ray tracing et le path tracing. Cela aide aussi les usages mixtes, comme la création ou certaines tâches IA locales, où la VRAM sert de réserve de travail.