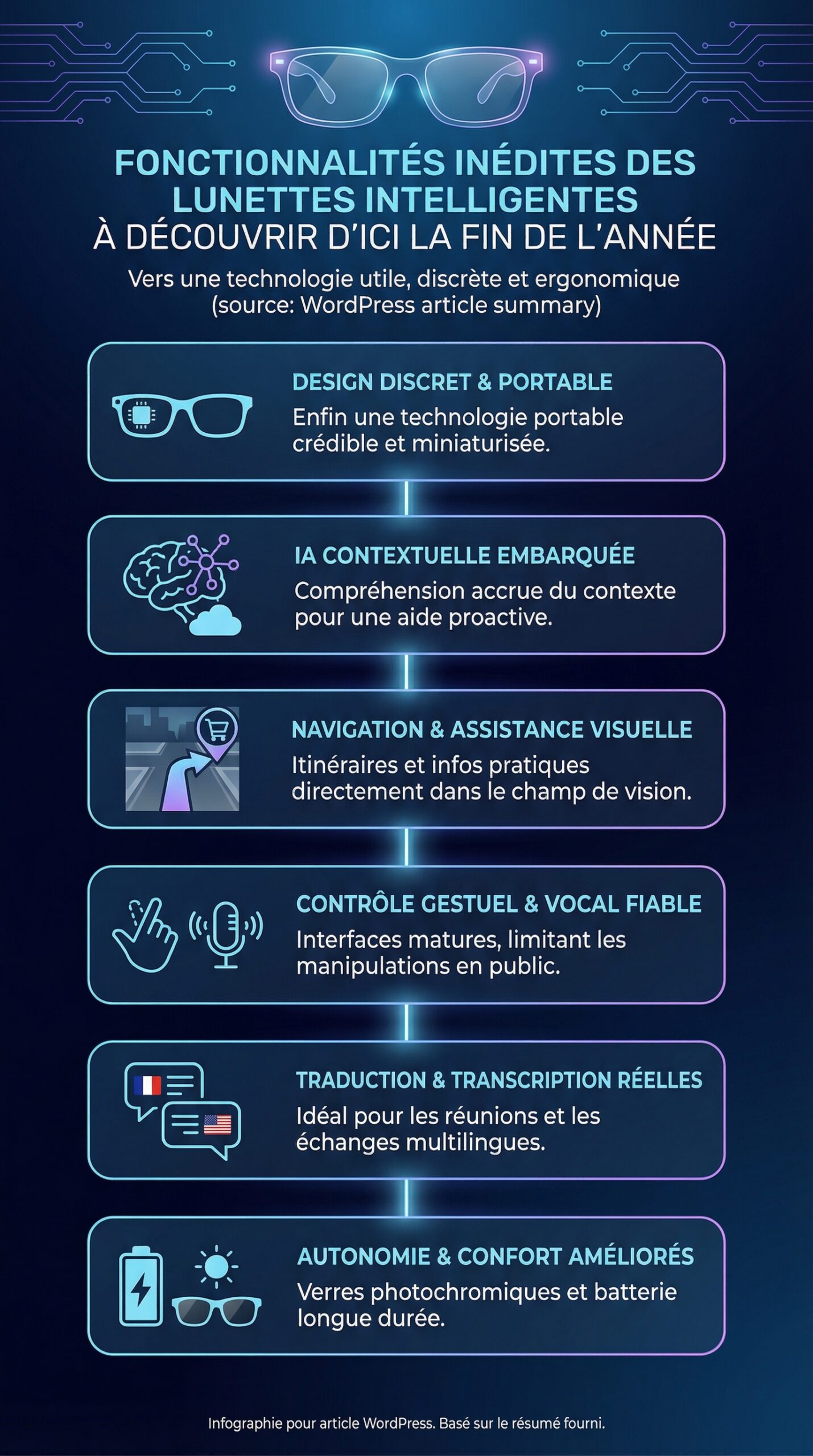

Les lunettes intelligentes sortent du statut de gadget pour devenir une technologie portable crédible, utile et enfin discrète. D’ici la fin de l’année, plusieurs marques accélèrent, car les usages se stabilisent et les coûts baissent. D’un côté, l’IA embarquée comprend mieux le contexte. De l’autre, la réalité augmentée se miniaturise et vise des apports concrets, comme l’itinéraire dans le champ de vision ou l’assistance en magasin. Parallèlement, les interfaces gagnent en maturité grâce à une commande vocale plus fiable, mais aussi grâce au contrôle gestuel qui limite les manipulations en public.

Le marché se structure aussi autour d’un compromis clair : des lunettes très légères, connectées au smartphone, ou des modèles plus riches avec écran et capteurs, mais plus exigeants en énergie. Or, les fuites sur des “Galaxy Glasses” sous Android XR, ainsi que les itérations “display” chez la concurrence, indiquent que l’année à venir sera surtout celle des fonctionnalités inédites qui améliorent le quotidien, pas seulement des démonstrations techniques. Enfin, la question de la vie privée revient sur le devant de la scène, car une caméra au niveau des yeux change la donne. Ce dossier passe en revue ce qui arrive, comment l’évaluer, et ce qu’il faut surveiller avant d’acheter.

En Bref

- Les lunettes intelligentes basculent vers des usages pratiques : navigation, assistance, recherche visuelle et notifications en temps réel.

- Les modèles avec écran gagnent du terrain, car l’interface utilisateur devient plus lisible et mieux intégrée à Android XR.

- La connectivité reste souvent dépendante du smartphone, ce qui protège la batterie mais limite l’autonomie “standalone”.

- Les capteurs biométriques et la détection contextuelle ouvrent des scénarios santé, sport et sécurité plus fins.

- La caméra et la reconnaissance visuelle imposent des réglages de confidentialité plus stricts et des usages responsables.

Lunettes intelligentes avec écran : des fonctionnalités inédites qui rendent la réalité augmentée enfin utile

L’arrivée de lunettes avec écran discret change l’expérience, car l’information n’est plus seulement audio. Ainsi, une interface utilisateur minimale peut afficher une flèche de navigation, un rappel d’agenda ou un message court. Ce format réduit la friction, car il évite de sortir le téléphone dans la rue. En pratique, l’écran n’a pas besoin d’être spectaculaire : il doit surtout rester lisible, stable, et peu intrusif.

Les rumeurs récentes autour de lunettes Android XR, attendues aux côtés d’un casque XR chez certains fabricants, évoquent une batterie autour de 245 mAh. Ce chiffre paraît modeste, pourtant il suggère une stratégie : déléguer le calcul au smartphone. Par conséquent, les lunettes deviennent un terminal d’affichage, plus qu’un ordinateur autonome. Ce modèle a un avantage immédiat, car la chaleur et la consommation restent mieux maîtrisées.

Un point clé concerne les “micro-interactions”. Par exemple, une notification de livraison peut s’afficher au bon moment, puis disparaître. De même, un itinéraire piéton peut se résumer à deux instructions visuelles. Au lieu d’un plan complet, le système montre l’essentiel. Cette sobriété rend la réalité augmentée plus acceptable socialement, car elle n’envahit pas le champ de vision.

Affichage contextuel : navigation, listes et assistance en magasin

Dans un scénario simple, une personne sort du métro et lance la navigation. Ensuite, les lunettes affichent un repère directionnel et la distance restante. Pendant ce temps, l’audio reste disponible pour les changements importants. Cette combinaison limite les erreurs, car l’œil confirme l’information rapidement. De plus, cela aide quand le téléphone capte mal le GPS ou quand la foule bloque l’écran.

En magasin, l’affichage contextuel devient aussi un outil de décision. Par exemple, une liste de courses peut se cocher par geste. Ensuite, la caméra identifie le produit et confirme le bon article. Ce type d’assistance dépend de la reconnaissance visuelle, mais il devient pertinent quand l’IA comprend les emballages et les variantes. À la clé, le temps passé à comparer diminue nettement.

Pour évaluer la qualité d’un écran, trois critères comptent. D’abord, la lisibilité en plein soleil. Ensuite, la stabilité du rendu quand la tête bouge. Enfin, la latence entre l’action et l’affichage. Sans ces bases, les fonctionnalités inédites restent des promesses. Cette section mène naturellement au second pilier : l’IA, la voix et les gestes, qui déterminent la fluidité au quotidien.

Commande vocale, contrôle gestuel et interface utilisateur : l’ergonomie devient la vraie révolution

Les lunettes ne peuvent pas copier le smartphone, car l’écran est limité et l’attention aussi. Donc, l’interface utilisateur doit être orientée vers l’instantané. La commande vocale devient centrale, car elle libère les mains. Cependant, la voix seule ne suffit pas en extérieur, car le bruit perturbe la reconnaissance. C’est là que le contrôle gestuel prend de la valeur, surtout pour valider, annuler ou faire défiler.

Dans les prototypes et produits récents, l’approche la plus efficace combine trois couches. D’abord, la voix pour l’intention (“lancer l’itinéraire”, “résumer ce message”). Ensuite, un geste court pour confirmer. Enfin, un affichage bref pour vérifier. Ce trio réduit les erreurs, car l’utilisateur garde le contrôle. En parallèle, cela évite de parler à voix haute en toute circonstance, ce qui reste un frein social.

Cas d’usage : réunion, traduction et transcription en temps réel

Dans une petite entreprise fictive, “Atelier Nord”, un chef de projet anime une réunion hybride. D’abord, les lunettes captent l’audio et affichent une transcription courte des points clés. Ensuite, un geste permet de marquer une décision. Enfin, une note est envoyée au smartphone pour archivage. Ce flux réduit les oublis, car la synthèse se construit au fil de la discussion.

La traduction en direct suit une logique similaire. Une phrase entendue peut apparaître sous forme de sous-titres, puis l’utilisateur demande une reformulation. Grâce à la commande vocale, l’échange reste naturel. Pourtant, le vrai gain vient des réglages : taille de police, durée d’affichage, et choix de langue prioritaire. Sans ces paramètres, le texte gêne plus qu’il n’aide.

Pour tester l’ergonomie avant achat, une méthode simple existe. Il faut reproduire un trajet, répondre à quelques messages, puis utiliser la navigation. Ensuite, il faut vérifier la fatigue : maux de tête, gêne visuelle, ou surcharge d’alertes. Si l’expérience reste légère, le produit est sur la bonne voie. La question suivante devient alors matérielle : batterie, verres et équilibre, car l’usage intensif expose vite les limites.

Autonomie, verres photochromiques et confort : les compromis techniques derrière les fonctionnalités inédites

Un bon modèle échoue rarement sur l’IA, mais souvent sur le confort. Or, des lunettes se portent des heures, donc le poids, l’équilibrage et la chauffe importent. De plus, la batterie conditionne tout : affichage, caméra, microphones, et traitement. C’est pourquoi une capacité autour de 245 mAh, évoquée pour certains modèles, mérite une lecture réaliste. Elle peut suffire si le téléphone fournit la puissance, mais elle impose une discipline logicielle stricte.

Le verre photochromique, parfois appelé verre à teinte variable, devient un choix rationnel. En intérieur, la vision reste claire. Ensuite, au soleil, la teinte fonce et protège. Ce détail paraît secondaire, pourtant il détermine la fréquence d’usage. Sans ce type de verres, les lunettes sont “bonnes certains jours”, ce qui réduit leur valeur. Avec des verres adaptatifs, elles deviennent un accessoire quotidien.

Gestion de l’énergie : affichage, caméra et notifications en temps réel

La consommation monte vite quand l’écran reste actif. De même, une caméra en mode vidéo peut vider la batterie en moins d’une heure selon les profils. Par conséquent, les meilleures implémentations privilégient des réveils courts. Ainsi, les notifications en temps réel s’affichent quelques secondes, puis l’écran s’éteint. Cette stratégie améliore l’autonomie sans dégrader l’utilité.

Un autre levier concerne la répartition du calcul. Quand l’IA tourne sur le smartphone, les lunettes se contentent de capter et d’afficher. De plus, la latence peut rester basse via une liaison optimisée. En revanche, cela dépend d’une connectivité stable. Si le lien chute, l’expérience se dégrade, surtout pour la traduction et la recherche visuelle.

Avant l’achat, quelques vérifications simples évitent les déceptions :

- Confort : pression sur le nez, stabilité en marche, et chauffe après 20 minutes.

- Autonomie : durée avec affichage intermittent, puis avec caméra active.

- Verres : efficacité des teintes variables et qualité optique sur les bords.

- Charge : présence d’un étui batterie et vitesse de recharge.

- Audio : intelligibilité en extérieur et fuite sonore.

Un insight reste constant : le confort prolonge l’usage, et l’usage révèle la valeur. La prochaine étape logique porte donc sur la caméra et l’IA visuelle, car ce duo crée les usages les plus “magiques”, mais aussi les plus sensibles.

Caméra embarquée, IA visuelle et confidentialité : les lunettes intelligentes entrent dans le réel

Une caméra sur des lunettes change la posture. Elle libère les mains, et elle capture un point de vue naturel. Certaines fuites évoquent un capteur autour de 12 MP, ce qui correspond à une norme actuelle sur ce format. Pourtant, la photo parfaite reste difficile, car le cadrage dépend de la tête. En revanche, la vidéo “à la première personne” fonctionne très bien pour documenter une réparation, une randonnée, ou un tutoriel.

Le gain le plus important vient de l’IA qui “voit”. Grâce à l’analyse de scène, les lunettes peuvent identifier un produit, lire une étiquette, ou signaler une information utile. Ainsi, une personne peut demander si un allergène apparaît sur une liste d’ingrédients. Ensuite, l’assistant met en évidence le terme concerné. Ce type d’aide dépasse la simple recherche web, car il s’appuie sur le contexte immédiat.

Exemple concret : assistance technique et “mémoire” de terrain

Dans un atelier de maintenance, un technicien reçoit une alerte sur une machine. D’abord, la caméra montre le panneau de contrôle. Ensuite, l’IA reconnaît le modèle et propose la procédure. Enfin, les étapes s’affichent une par une, ce qui réduit les erreurs. Ce scénario marche particulièrement bien quand l’interface utilisateur reste sobre et que les confirmations se font par contrôle gestuel.

Ce même mécanisme sert aussi à la “mémoire” personnelle. Par exemple, une personne filme une installation de box internet. Plus tard, elle demande où passe tel câble, et l’assistant retrouve l’extrait pertinent. Ce n’est pas une science-fiction, car l’indexation vidéo progresse vite. Toutefois, cela exige une gestion stricte des données, sinon la confiance s’effondre.

La confidentialité doit être traitée comme une fonctionnalité, pas comme une option. Donc, des signaux visuels d’enregistrement, des réglages simples, et un bouton de coupure deviennent essentiels. De plus, l’effacement local et le chiffrement doivent être clairs. À ce stade, un dernier sujet complète le tableau : la plateforme logicielle, les apps XR et la connectivité qui relie tout à l’écosystème.

Android XR, connectivité et applications optimisées : vers des fonctionnalités inédites centrées sur l’écosystème

Les lunettes gagnent quand elles exploitent l’écosystème existant. Avec Android XR, l’idée est d’adapter des applications mobiles à un usage “tête haute”. Ainsi, la musique, la cartographie, ou la messagerie peuvent afficher des éléments simples. En parallèle, la logique rappelle les applications optimisées pour montres, mais avec un objectif différent. Ici, l’affichage est projeté et orienté contexte, pas pensé pour des interactions longues.

Les informations disponibles suggèrent que certains modèles de première génération n’intègrent pas de connexion cellulaire dédiée. Donc, la connectivité passe par le smartphone. Cette décision paraît frustrante, pourtant elle simplifie la conception. D’abord, la batterie dure plus longtemps. Ensuite, le coût baisse. Enfin, la configuration reste familière : app compagnon, Bluetooth, et éventuellement Wi‑Fi assisté.

Notifications en temps réel et scénarios “micro-apps”

Les notifications en temps réel représentent l’usage le plus fréquent, à condition d’être bien filtrées. Un bon système distingue l’urgent du bruit. Par exemple, une notification bancaire importante apparaît immédiatement. En revanche, un “like” sur un réseau social peut rester sur le téléphone. Ce tri augmente l’acceptation, car l’utilisateur ne se sent pas harcelé.

Les micro-apps, elles, misent sur des actions courtes. Par exemple, valider un code de sécurité, accepter un appel, ou lancer un minuteur cuisine. Grâce à la commande vocale, l’action démarre vite. Ensuite, un geste confirme. Ce modèle limite la dépendance à l’écran et protège l’attention.

Capteurs biométriques et santé : la prochaine frontière de la technologie portable

L’ajout de capteurs biométriques dans la monture ouvre des pistes, même sans viser le médical. Par exemple, une estimation de fatigue via la température cutanée, ou un suivi de stress via des micro-variations physiologiques. Ensuite, des alertes peuvent proposer une pause, une respiration guidée, ou une baisse de notifications. Ce lien entre corps et interface reste une promesse forte, car il personnalise l’expérience.

Le point délicat concerne la fiabilité. Un capteur mal placé ou une monture mal ajustée fausse les mesures. Par conséquent, les fabricants devront proposer des calibrations simples et des marges d’erreur explicites. Quand ces garde-fous existent, la valeur augmente, car l’outil devient cohérent au quotidien. À ce niveau, les fonctionnalités inédites ne sont plus des “options”, mais une architecture complète entre matériel, apps et services.

Quelles fonctionnalités inédites attendre le plus d’ici la fin de l’année sur des lunettes intelligentes ?

Les apports les plus concrets concernent l’affichage contextuel (navigation, rappels), l’IA visuelle via caméra (reconnaissance d’objets, lecture d’étiquettes), ainsi qu’une interface plus fluide combinant commande vocale et contrôle gestuel. Les progrès viennent surtout de l’intégration logicielle, pas uniquement du matériel.

Les lunettes avec écran remplacent-elles un smartphone ?

Non, car la plupart des modèles s’appuient encore sur le téléphone pour le calcul et la connectivité. En revanche, elles réduisent le nombre de consultations, grâce à des notifications en temps réel et des actions rapides. Le smartphone reste la base, tandis que les lunettes deviennent un affichage et une télécommande contextuels.

À quoi sert une caméra sur des lunettes intelligentes au-delà des photos ?

La photo reste secondaire, car le cadrage est moins précis. En revanche, la vidéo à la première personne est très utile, tout comme l’IA visuelle qui analyse ce qui se trouve devant l’utilisateur. Cela sert à identifier un produit, comprendre une panne, ou obtenir une aide contextualisée.

Pourquoi les verres photochromiques sont-ils importants sur des lunettes intelligentes ?

Ils permettent un usage continu entre intérieur et extérieur, sans changer de lunettes. Comme l’écran et la caméra dépendent de la visibilité, le confort visuel devient central. Des verres adaptatifs augmentent la fréquence d’usage, donc la valeur de la technologie portable.

Quels points vérifier avant d’acheter pour éviter une mauvaise expérience ?

Il faut tester le confort (pression, chauffe), l’autonomie avec écran et caméra, la qualité des notifications, la stabilité de la connectivité avec le smartphone, et la clarté des réglages de confidentialité. Une interface utilisateur sobre et des commandes fiables font souvent la différence au quotidien.