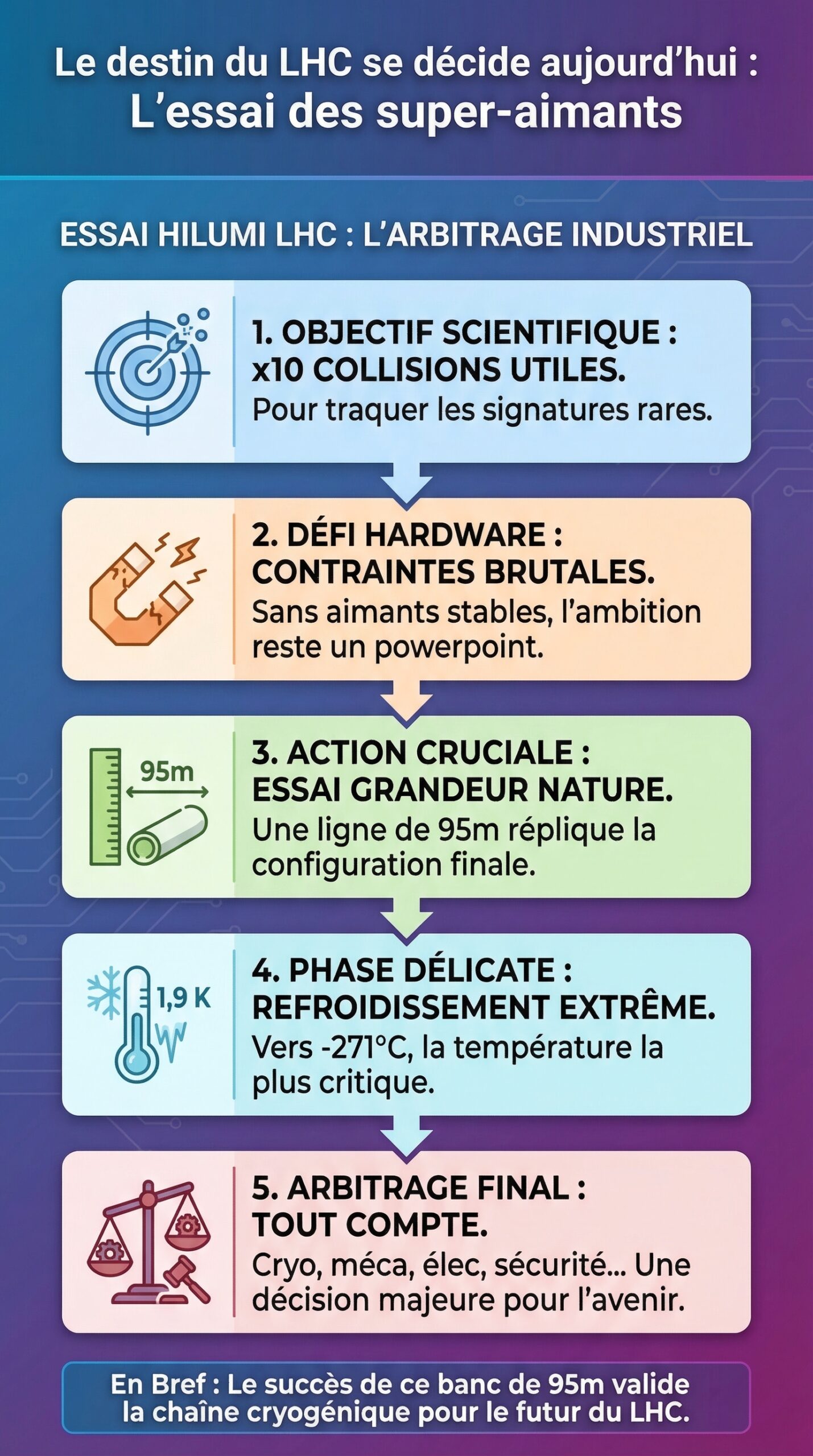

À la frontière franco-suisse, le LHC vit une journée charnière qui ressemble moins à un simple jalon qu’à un véritable arbitrage industriel. D’un côté, une promesse scientifique qui excite la physique des particules : obtenir dix fois plus de collisions utiles, donc dix fois plus de chances de traquer des signatures rares. De l’autre, une réalité hardware brutale : sans une chaîne cryogénique stable et des super-aimants capables d’encaisser les contraintes, l’ambition reste un powerpoint. C’est précisément pour réduire ce risque qu’un essai grandeur nature vient d’entrer dans sa phase la plus délicate : le refroidissement progressif d’une ligne de 95 mètres qui réplique la configuration finale. Et quand ce type d’expérience démarre, tout compte : la mécanique, l’électrique, la cryo, le contrôle-commande, mais aussi les procédures de sécurité.

Ce moment n’a rien d’abstrait. Il prépare la bascule vers HiLumi, la mise à niveau qui doit transformer l’accélérateur en une machine à données. Toutefois, il ne s’agit pas seulement d’ajouter de la puissance. Il faut aussi la dompter, car les nouveaux systèmes, plus compacts et plus intenses, tolèrent moins l’approximation. Par conséquent, l’enjeu dépasse la performance brute : il concerne le destin d’une infrastructure unique, maintenue au sommet grâce à une technologie qui emprunte autant au monde des aimants supraconducteurs qu’aux meilleures pratiques du hardware critique. Et si le public retient surtout les collisions, la partie la plus risquée se joue souvent loin des détecteurs, dans les lignes d’alimentation, les interfaces et les cycles thermiques.

En Bref

- Le CERN lance le refroidissement progressif d’un banc d’essai de 95 mètres, réplique du futur montage HiLumi près d’ATLAS et CMS.

- Objectif : valider l’intégration des super-aimants et des systèmes associés en conditions proches de l’exploitation réelle.

- La cryogénie vise 1,9 K afin d’activer la supraconductivité et sécuriser les procédures avant le grand arrêt technique LS3.

- Les nouveaux quadripôles en Nb3Sn promettent un champ plus intense, donc un faisceau mieux focalisé dans l’accélérateur.

- Des briques innovants comme les cavités-crabe et des liaisons d’alimentation supraconductrices HTS élargissent la boîte à outils de la science.

Essai HiLumi LHC : pourquoi le banc de 95 mètres décide du destin de l’accélérateur

Le point de départ est simple, mais décisif : un composant peut réussir en test unitaire et échouer en système. Donc, le CERN a construit l’Inner Triplet String, une ligne d’essai de 95 mètres installée en surface, afin de reproduire la future configuration souterraine. L’idée ressemble à ce que fait un intégrateur hardware sérieux avant un déploiement critique : valider l’ensemble, pas seulement les pièces. Ainsi, l’équipe vérifie les interfaces mécaniques, la distribution électrique, les capteurs, les interlocks et la coordination logicielle. Au final, ce n’est pas une démo, c’est un “dress rehearsal” complet.

Pour garder un fil conducteur concret, imaginons une ingénieure fictive, Nora, qui suit ce test comme elle suivrait un bring-up de serveur ou de baie HPC. D’abord, elle cherche les “points chauds” potentiels : les transitions entre modules, les connecteurs, les zones de contraintes. Ensuite, elle vérifie les comportements lors des changements d’état : refroidissement, stabilisation, montée en courant, déclenchement volontaire des protections. Or, dans un accélérateur, la logique est la même qu’en hardware extrême : la plupart des pannes apparaissent pendant les transitions, pas à régime établi. Voilà pourquoi cette réplication à l’échelle 1 est si précieuse.

Ce banc n’est pas là pour prouver que les aimants “fonctionnent”. Cela a déjà été documenté via des campagnes de qualification. En revanche, il doit prouver que la chaîne complète tient ses promesses : alignement, rigidité, qualité des signaux, et surtout tolérance aux variations. De plus, l’expérience sert à affiner des procédures, car une procédure gagnée en surface évite des semaines perdues sous terre. En pratique, chaque étape se traduit par des checklists, des signatures, des seuils de déclenchement et des scénarios d’arrêt. Ce sont des détails, pourtant ce sont eux qui font la différence entre performance et indisponibilité.

À ce stade, la question clé devient : que se passe-t-il si un sous-système se comporte “presque” bien ? Dans le monde des GPUs ou des cartes réseaux, un “presque” se corrige parfois par firmware. Ici, un “presque” peut coûter une campagne entière. Par conséquent, le banc sert aussi à cartographier les marges : marges thermiques, marges électriques, marges mécaniques. Et lorsque ces marges sont connues, les arbitrages deviennent rationnels. Ce cadrage conditionne la suite, car l’ombre du LS3 approche et la fenêtre d’intégration reste limitée. Une intégration réussie aujourd’hui, c’est du temps de faisceau gagné demain.

Refroidissement cryogénique à 1,9 K : la séquence la plus risquée de l’essai

Le refroidissement progressif vers 1,9 Kelvin ressemble à un overclock, sauf qu’il se fait à l’envers : on gagne la performance en descendant la température. Cependant, la difficulté ne tient pas uniquement au froid extrême. Elle vient des gradients : chaque matériau se contracte, chaque assemblage “travaille”, et chaque variation peut déplacer des tolérances. Donc, la séquence s’étale sur plusieurs semaines, avec des paliers, des validations et des retours d’instrumentation. En cryogénie, aller trop vite peut créer des contraintes mécaniques inutiles, et donc réduire la fiabilité à long terme.

Dans l’accélérateur, la supraconductivité n’est pas une option marketing. C’est la condition pour générer des champs intenses sans dissiper une puissance électrique démesurée. Néanmoins, cette supraconductivité impose aussi une discipline : il faut éviter les perturbations qui provoquent une transition résistive. Ainsi, les opérateurs surveillent la stabilité et testent la réaction des systèmes de protection. En d’autres termes, le banc valide autant la performance que la capacité à “encaisser” les écarts.

Un exemple parlant : lors d’une micro-perturbation, un aimant peut quitter l’état supraconducteur sur une zone limitée. Cette situation exige une réponse immédiate, sinon l’énergie stockée devient dangereuse. Voilà pourquoi les quench detectors, les déclencheurs et les circuits de décharge sont scrutés comme un VRM sur une carte mère haut de gamme. En parallèle, la qualité des données compte aussi, car un capteur bruité peut déclencher à tort et ruiner la disponibilité. Cette obsession de l’instrumentation est typiquement hardware, et pourtant elle sert la science directement.

Une fois la cryo stabilisée, la montée en courant permet d’évaluer les comportements en dynamique. Là encore, le test n’est pas seulement “ça marche”. Il cherche plutôt “ça marche toujours, et dans quelles limites”. Pour Nora, c’est une logique d’intégratrice : mesurer, comparer, documenter. En fin de séquence, ce sont des rapports d’écarts et des actions correctives qui tombent, pas des slogans. Et ce réalisme opérationnel prépare le terrain pour les aimants innovants qui arrivent au cœur du dispositif.

Super-aimants Nb3Sn : la technologie innovante qui change la focalisation des faisceaux au LHC

La pièce maîtresse de HiLumi se joue dans les quadripôles internes, là où le faisceau doit être focalisé juste avant la collision. Les nouveaux super-aimants utilisent un supraconducteur à base de niobium-étain (Nb3Sn). Ce choix n’est pas un caprice. Au contraire, il répond à un besoin clair : générer un champ plus intense dans un volume contraint. Ainsi, l’optique de faisceau devient plus agressive, et la probabilité de collision utile grimpe. À la clé, le nombre d’événements analysables explose, ce qui nourrit la physique des particules.

Le Nb3Sn impose pourtant une exigence de fabrication plus stricte que les technologies précédentes. Il est plus délicat à mettre en œuvre, car le matériau est sensible, et l’assemblage doit rester précis après les traitements thermiques. Donc, l’innovation n’est pas seulement dans la matière. Elle est aussi dans la chaîne de production, le contrôle qualité et l’acceptation. Pour rester concret, l’écosystème ressemble à celui d’un produit “enthusiast” : le potentiel est énorme, mais la variabilité doit être réduite par des process béton. C’est là que l’expérience accumulée par des partenaires internationaux, dont des équipes associées à Fermilab, devient un accélérateur de maturité.

Le lecteur hardware reconnaîtra un schéma classique : plus de densité, plus de contraintes. En augmentant le champ, on augmente aussi les forces électromagnétiques, donc les efforts mécaniques. Par conséquent, la tenue structurelle et la répétabilité deviennent aussi importantes que la performance. Ce point est souvent sous-estimé dans les récits grand public. Pourtant, un aimant ne se juge pas uniquement à son pic de champ, mais à sa capacité à tenir des cycles, des rampes, des micro-perturbations. En bref, il doit être “boring” en production, même s’il est spectaculaire en specs.

Pour visualiser l’intérêt, une analogie simple fonctionne : focaliser le faisceau, c’est comme réduire la taille d’un spot laser avant une mesure. Plus le spot est petit et stable, plus la mesure est précise. Ici, le “spot” correspond à la zone de collision dans ATLAS et CMS. Donc, ces quadripôles influencent directement la qualité des données. Et puisque HiLumi vise une collecte massive, la stabilité devient un multiplicateur. Le destin du programme se joue alors autant dans les teslas que dans les tolérances d’alignement.

Comparatif : Nb3Sn, NbTi et HTS dans un accélérateur de protons

Les lecteurs entendent souvent “supraconducteur” comme un bloc unique. Pourtant, les compromis varient beaucoup selon le matériau et l’usage. Par exemple, le NbTi reste une référence historique, car il est bien maîtrisé et robuste en production. Cependant, lorsque l’objectif devient “plus de champ dans le même espace”, le Nb3Sn prend l’avantage. Enfin, les supraconducteurs haute température (HTS) s’invitent dans certaines fonctions, notamment pour des liaisons d’alimentation où la marge thermique change la donne.

| Technologie | Atout clé | Défi principal | Usage typique dans HiLumi |

|---|---|---|---|

| NbTi | Procédés industrialisés, bonne fiabilité | Champ maximal plus limité | Éléments éprouvés et zones moins contraintes |

| Nb3Sn | Champ plus élevé, focalisation renforcée | Fabrication plus délicate, contraintes mécaniques | Quadripôles internes près des points d’interaction |

| HTS | Marge thermique utile, pertes réduites dans certaines liaisons | Coût, intégration et connectique complexe | Lignes de transfert et alimentation avancée |

Ce tableau ne dit pas “meilleur” ou “pire”. Il montre plutôt une architecture hybride, pensée comme un PC haut de gamme : on choisit chaque composant selon son rôle. Donc, HiLumi n’est pas un simple swap d’aimants. C’est une refonte de plateforme, où la technologie sert une stratégie de mesure. Et cette stratégie devient encore plus ambitieuse avec les cavités-crabe et les alimentations supraconductrices.

Cavités-crabe, alimentation HTS et intégration : l’expérience système qui valide les choix innovants

Au-delà des aimants, HiLumi introduit des briques rarement vues ensemble dans un accélérateur de protons. Les cavités-crabe supraconductrices en sont un bon exemple : elles “inclinent” les paquets de protons pour maximiser le recouvrement au point de collision. Dit autrement, elles améliorent l’efficacité géométrique, ce qui augmente la luminosité sans exiger uniquement plus d’intensité. Cependant, ces cavités ajoutent de la complexité RF, des contraintes de synchronisation et des exigences de stabilité. Donc, elles doivent être validées comme on valide un composant réseau critique : performances, tolérance aux perturbations, et comportement en mode dégradé.

Ensuite, les lignes de transfert électrique supraconductrices à haute température apportent une autre promesse : transporter de forts courants avec des pertes réduites et une gestion thermique plus flexible. Toutefois, la beauté du concept se heurte vite à l’intégration. Il faut gérer les interfaces entre environnements thermiques, les connecteurs, la protection, et la maintenance. C’est là que l’expérience système devient un juge de paix. Un système HTS peut être excellent sur le papier, puis capricieux s’il est mal instrumenté ou mal routé. Par conséquent, le banc d’essai et les validations associées servent d’assurance qualité à l’échelle installation.

Pour rester dans un angle hardware, il est utile de voir HiLumi comme une “plateforme” avec plusieurs bus : bus cryo, bus puissance, bus contrôle, bus RF. Chaque bus a ses propres exigences, et les interactions peuvent surprendre. Par exemple, un bruit électrique peut polluer une mesure sensible, tandis qu’une micro-vibration peut se transformer en instabilité RF. Ainsi, l’intégration doit être pensée comme un tout, et pas comme une somme de sous-projets. Cette approche explique pourquoi près de 50 instituts collaborent : l’expertise est distribuée, et la coordination devient un produit en soi.

Une liste aide à comprendre ce que valide réellement une campagne d’intégration, au-delà de l’effet d’annonce :

- Compatibilité cryogénique : rampes de température, paliers, stabilité, consommation d’hélium et marges.

- Chaîne de protection : détection de quench, logique d’interlock, décharge d’énergie et scénarios d’arrêt.

- Qualité d’instrumentation : bruit, dérive, étalonnage, redondance et traçabilité des mesures.

- Intégration mécanique : alignement, supports, tolérances après contraction, accessibilité maintenance.

- Interopérabilité logicielle : supervision, alarmes, historiques, et procédures opérateur reproductibles.

À la fin, l’objectif n’est pas de cocher des cases. Il s’agit plutôt de réduire l’incertitude avant le basculement opérationnel, surtout à l’approche du LS3. Et une fois la plateforme validée, la question suivante devient la plus excitante : que fera la science de cette pluie de données ?

Physique des particules : comment la haute luminosité change l’expérience et la science autour du boson de Higgs

Multiplier la luminosité par dix ne signifie pas seulement “plus de collisions”. Cela signifie surtout plus d’événements rares capturés, donc plus de leviers statistiques. Or, en physique des particules, la précision est souvent une bataille contre le bruit et la rareté. Ainsi, HiLumi vise un changement d’échelle : au lieu d’attendre longtemps pour accumuler des cas particuliers, les expériences pourront les observer plus souvent, et donc les comparer plus finement aux prédictions. Cette densité de données peut aussi révéler des écarts subtils, ceux qui passent sous le radar quand les barres d’erreur sont trop larges.

Le cas emblématique concerne le boson de Higgs, dont l’étude reste au centre du programme. Une des mesures les plus attendues touche à son auto-interaction, c’est-à-dire la façon dont il “se couple” à lui-même. Cette grandeur est liée au potentiel du champ de Higgs, et donc à la structure profonde du Modèle standard. Par conséquent, elle éclaire indirectement des questions cosmologiques, comme les conditions des premiers instants de l’Univers. Les lecteurs habitués aux benchmarks verront l’analogie : mesurer un paramètre rare, c’est comme caractériser un bug intermittent, sauf qu’ici il peut réécrire une partie de la théorie.

La haute luminosité a pourtant un coût opérationnel : plus de collisions signifie aussi plus d’empilement d’événements par croisement de faisceaux. Donc, les détecteurs et leurs pipelines de lecture doivent filtrer, trier et reconstruire avec une efficacité accrue. Là, le sujet rejoint le hardware grand public : capteurs plus rapides, électronique de front-end plus robuste, et surtout chaînes de calcul renforcées. En 2026, les infrastructures de calcul associées s’appuient sur des architectures hétérogènes, avec accélération GPU et optimisation logicielle. Ainsi, la frontière entre instrumentation et informatique se brouille, et l’expérience devient autant un défi data qu’un défi faisceau.

Pour garder une touche “terrain”, Nora suit aussi l’impact côté exploitation : plus de données impose une discipline de monitoring. On pense aux dérives lentes, aux variations de calibration, et aux changements d’environnement. De même, la reproductibilité devient essentielle, car une anomalie peut contaminer des semaines de prises de données. Par conséquent, les procédures testées sur l’IT String ont un effet domino : une meilleure stabilité côté aimants réduit les interruptions, donc stabilise la qualité des datasets. Ce lien direct entre super-aimants et publications scientifiques est souvent invisible, pourtant il structure le destin du programme.

Enfin, l’intérêt de HiLumi ne se limite pas à “confirmer” ce que l’on sait déjà. L’histoire des accélérateurs montre que pousser une machine dans ses retranchements ouvre parfois des portes inattendues. Donc, au-delà du Higgs, l’espoir est d’apercevoir des phénomènes rares, des désintégrations exotiques, ou des déviations qui forcent à repenser le cadre. Cette possibilité de surprise, c’est la raison pour laquelle le pari technologique mérite d’être tenté. Et lorsque le hardware tient, la science peut enfin poser les questions les plus risquées.

La prochaine étape logique consiste alors à relier ces objectifs aux choix concrets de validation et de calendrier, car l’alignement entre planning industriel et ambitions scientifiques reste l’art le plus difficile.

Pourquoi le refroidissement à 1,9 K est-il indispensable pour le LHC ?

À cette température, les matériaux supraconducteurs utilisés dans les aimants peuvent conduire des courants très élevés sans pertes résistives significatives. Ainsi, l’accélérateur obtient des champs magnétiques intenses tout en gardant une consommation et une dissipation thermiques compatibles avec l’exploitation.

En quoi l’essai de la ligne de 95 mètres est-il plus important qu’un test d’aimant isolé ?

Un test unitaire valide un composant, mais un essai système révèle les problèmes d’interfaces : cryogénie, alimentation, capteurs, protections et procédures opérateur. Donc, la ligne de 95 mètres réduit le risque d’échec lors de l’installation finale et sécurise le destin de l’intégration HiLumi.

Qu’apportent les super-aimants Nb3Sn par rapport aux aimants actuels ?

Le Nb3Sn permet d’atteindre des champs plus élevés dans un volume comparable, ce qui améliore la focalisation des faisceaux avant collision. Par conséquent, la luminosité augmente et les expériences collectent davantage de données utiles pour la physique des particules.

À quoi servent les cavités-crabe dans HiLumi LHC ?

Elles inclinent les paquets de particules au moment de la rencontre, ce qui augmente leur recouvrement effectif. Ainsi, plus de protons interagissent, et la luminosité progresse sans dépendre uniquement d’une hausse d’intensité.