Entre accélération de l’intelligence artificielle, contraintes énergétiques et regain de la souveraineté numérique, la technologie 2026 impose un tri lucide entre promesses et usages réels. Dans ce paysage, q-tec attire l’attention parce que ses choix techniques collent aux besoins concrets des industriels et des intégrateurs. La marque s’inscrit dans une tendance forte : rapprocher la puissance de calcul des capteurs, afin de réduire la latence, limiter les coûts de bande passante et renforcer la confidentialité. Ce déplacement vers l’Edge n’est pas un effet de mode, car il répond à des cybermenaces en hausse et à des contraintes opérationnelles plus strictes. Par ailleurs, les innovations du marché ne se jugent plus sur une démo, mais sur des déploiements reproductibles, audités et maintenables. L’enjeu devient donc double : disposer d’architectures modulaires, puis les intégrer sans réinventer l’existant. Enfin, la montée des agents autonomes et des modèles multimodaux change la nature des applications attendues, notamment dans l’industrie 4.0, la santé, la sûreté et la maison connectée. Dans ce contexte, q-tec sert de prisme utile pour comprendre comment les technologies émergentes s’assemblent, se testent, puis s’industrialisent vers le futur.

En Bref

- q-tec se positionne sur des plateformes caméra modulaires combinant CPU, GPU, FPGA et Edge AI, afin d’accélérer les traitements au plus près des capteurs.

- Les innovations 2026 se concentrent sur une IA plus fiable, des données mieux protégées (Zero Trust, informatique confidentielle) et des infrastructures plus performantes.

- Les meilleures applications se voient en production : contrôle qualité, logistique, inspection thermique, vision hyperspectrale, et domotique plus autonome.

- La recherche et développement se heurte à des contraintes matérielles (pénurie de RAM, énergie) qui favorisent l’optimisation et la modularité.

- La transformation digitale gagne en crédibilité quand elle s’appuie sur des tests, des métriques et une gouvernance IA claire.

q-tec en 2026 : plateformes de vision modulaire et Edge AI orientées terrain

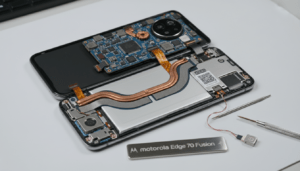

Le cœur de l’approche q-tec repose sur une idée simple : une caméra n’est plus un “capteur passif”, mais une plateforme de calcul. Ainsi, les systèmes s’appuient sur des blocs modulaires qui combinent CPU, GPU et FPGA, afin d’adapter la puissance à l’usage. Cette modularité compte, car une ligne d’assemblage n’a pas les mêmes contraintes qu’un drone d’inspection. De plus, l’Edge AI réduit la dépendance au cloud, ce qui diminue la latence et améliore la résilience.

Un exemple parlant se voit dans une usine fictive, “Atelier Nova”, spécialisée dans des pièces mécaniques de précision. Au départ, l’équipe utilise une caméra standard et un PC industriel pour le contrôle qualité. Cependant, la latence varie, et les faux rejets coûtent cher. En migrant vers une plateforme inspirée de q-tec, le prétraitement est déplacé dans la caméra, puis seuls les résultats et extraits utiles remontent. Résultat : le débit de la ligne reste stable, tandis que le taux de faux positifs baisse après une phase de calibration.

Compatibilité capteurs : du CMOS industriel à l’hyperspectral, un levier d’applications

La gamme de têtes capteurs compatibles est un facteur de différenciation, car elle ouvre des applications très variées. Les capteurs CCD et CMOS restent courants en inspection visuelle, alors que le scientific CMOS répond aux besoins faibles signaux. En parallèle, le thermique via microbolomètres sert pour la maintenance prédictive, car un échauffement anormal annonce souvent une panne. Enfin, l’imagerie multi- ou hyperspectrale devient un outil de tri matière, utile en agroalimentaire et recyclage.

Ce choix n’est pas neutre : un capteur hyperspectral produit beaucoup de données. Pourtant, l’Edge AI peut extraire des signatures utiles sans tout transporter. Par conséquent, la chaîne de traitement devient économiquement viable, même sur des sites éloignés. Cette logique soutient la transformation digitale des métiers terrain, car elle réduit les frictions d’intégration.

CPU, GPU, FPGA : pourquoi l’hybride gagne dans l’industrie 4.0

Dans l’industrie 4.0, un seul type de calcul ne suffit plus. Le CPU gère l’orchestration et les protocoles. Ensuite, le GPU accélère l’inférence IA, surtout en vision. Enfin, le FPGA apporte du déterminisme, utile pour des tâches temps réel comme l’alignement, l’encodage ou des filtres dédiés. Avec cet hybride, une même plateforme peut être ajustée à un poste, plutôt que remplacée.

Ce choix devient aussi un argument de sécurité. En effet, plus le traitement reste local, moins les données brutes circulent. Ce point prépare naturellement la discussion sur la protection des informations sensibles, thème central de la technologie 2026.

Technologie 2026 et q-tec : IA plus fiable, agents autonomes et gouvernance pragmatique

La technologie 2026 met la barre plus haut sur la confiance. Après les tensions liées aux deepfakes et aux manipulations observées en 2025, la pression s’exerce sur la traçabilité des modèles et la robustesse des pipelines. Dans ce cadre, q-tec s’intègre à une tendance : pousser l’intelligence artificielle vers des environnements maîtrisés, avec des datasets balisés, des métriques claires et des mises à jour contrôlées. Il ne s’agit pas de “faire de l’IA partout”, mais de l’appliquer là où elle apporte une preuve mesurable.

Dans “Atelier Nova”, un second cas illustre ce besoin. Un modèle de détection de défauts visuels fonctionnait très bien en laboratoire, puis chutait en production à cause des reflets. La correction ne vient pas d’un modèle plus gros, mais d’une stratégie : normaliser l’éclairage, enrichir le dataset avec des cas limites et verrouiller une procédure d’audit. Ainsi, la performance devient stable, et la maintenance du système est planifiée comme celle d’une machine-outil.

Agents autonomes : promesse réelle, à condition de repenser les processus

Les systèmes multi-agents progressent, car ils savent répartir des tâches : supervision, diagnostic, planification et interaction. Toutefois, leur adoption échoue souvent quand ils sont “ajoutés” à une organisation inchangée. À l’inverse, un déploiement pertinent redéfinit les rôles : l’agent propose, l’opérateur valide, puis le système apprend sur des retours structurés. Cette discipline évite l’automatisation aveugle, tout en accélérant l’exécution.

Dans un entrepôt, un agent peut corréler des images de quais de chargement, des données de capteurs et des horaires. Ensuite, il signale des anomalies, puis suggère une replanification. Cependant, il faut des garde-fous, sinon l’agent optimise une métrique locale au détriment du reste. Cette exigence donne une dimension “ingénierie” à l’IA, ce qui renforce la crédibilité des innovations.

Bonnes pratiques IA sur l’Edge : ce qui sépare la démo du produit

Plusieurs règles reviennent sur le terrain. D’abord, la latence doit être mesurée, pas supposée. Ensuite, la dérive des données doit être surveillée, car une caméra “voit” différemment selon la saison ou l’usure. Enfin, un plan de retour arrière est indispensable lors des mises à jour. Ces principes semblent simples, pourtant ils évitent des arrêts coûteux.

- Établir une baseline de précision et de temps de réponse avant toute optimisation.

- Tester en conditions extrêmes (lumière, poussière, vibrations) dès la phase pilote.

- Journaliser les décisions du modèle pour faciliter l’audit et le diagnostic.

- Segmenter les droits d’accès aux flux vidéo et aux modèles, surtout en multi-sites.

- Planifier la recalibration comme une opération de maintenance préventive.

À ce stade, la question suivante devient logique : comment protéger les données et les modèles quand les menaces augmentent et que le cloud n’est pas toujours souverain ?

Une démonstration vidéo d’inspection visuelle sur Edge AI aide à comprendre la différence entre traitement embarqué et traitement centralisé. Le sujet éclaire aussi les arbitrages entre débit, latence et qualité de détection, essentiels pour des applications en production.

Cybersécurité et souveraineté numérique : données protégées, Zero Trust et informatique confidentielle

Quand les cyberattaques se multiplient, la sécurité cesse d’être un “projet IT” isolé. Au contraire, elle devient une propriété de conception. La technologie 2026 consacre deux approches complémentaires : le Zero Trust, qui suppose qu’aucun acteur n’est implicitement fiable, et l’informatique confidentielle, qui chiffre les données même pendant leur traitement. Ensemble, ces méthodes réduisent la surface d’attaque, ce qui rassure autant les industriels que les secteurs régulés.

Dans une architecture inspirée de q-tec, la caméra intelligente traite localement et ne transmet que des informations nécessaires. Ce choix limite l’exposition des flux bruts. Toutefois, ce n’est pas suffisant : les identités, les clés et les mises à jour doivent être gérées proprement. Sinon, l’Edge devient un nouvel angle d’attaque. La sécurité réussit donc quand elle s’intègre au cycle de vie, de l’installation jusqu’au remplacement.

Cloud souverain : une réponse pragmatique aux contraintes géopolitiques et réglementaires

La souveraineté numérique progresse, car les organisations veulent réduire leur dépendance à des plateformes extra-territoriales. Ce mouvement touche les administrations, mais aussi l’industrie et la santé. Un cloud souverain n’est pas “meilleur” par nature, cependant il facilite la conformité et la maîtrise contractuelle. Par conséquent, les entreprises arbitrent : inférence sur l’Edge, archivage et supervision dans un cloud local ou souverain, et entraînement sur des environnements cloisonnés.

Dans “Atelier Nova”, les images de production ne sortent pas du site. En revanche, les métriques agrégées et les journaux d’événements remontent vers une plateforme d’observabilité hébergée localement. Ainsi, l’équipe améliore son modèle sans exposer de secrets industriels. Ce montage illustre une transformation digitale réaliste, car il respecte les contraintes métier.

Tableau comparatif : options de sécurité des données pour des applications q-tec

| Approche | Principe | Avantage concret | Limite typique | Usage recommandé |

|---|---|---|---|---|

| Zero Trust | Vérification systématique des identités et des accès | Réduction des mouvements latéraux en cas d’intrusion | Complexité d’administration si les rôles sont mal définis | Sites multi-ateliers, prestataires, accès distant |

| Informatique confidentielle | Chiffrement des données “en usage” via enclaves sécurisées | Protection même lors du traitement | Surcoût de configuration et compatibilités matérielles | Traitement de données sensibles, santé, R&D |

| Traitement Edge | Inférence proche du capteur, en local | Moins de données brutes exposées, latence faible | Mises à jour et parc matériel à gérer | Vision industrielle, sûreté, maintenance |

| Cloud souverain | Hébergement sous juridiction et contrôle local | Meilleure maîtrise contractuelle et conformité | Écosystème parfois moins riche que les hyperscalers | Archivage, supervision, analytics agrégés |

Une fois la sécurité cadrée, la question suivante se pose : quelles infrastructures et quels choix matériels rendent ces architectures soutenables, surtout quand la mémoire devient un goulot d’étranglement ?

Une analyse vidéo des modèles Zero Trust et des enclaves de calcul aide à visualiser les impacts réels sur les déploiements. Les retours d’expérience montrent aussi pourquoi la sécurité doit être pensée dès la conception, et non ajoutée après coup.

Infrastructures, supercalculateurs et mémoire : accélérer la recherche et développement malgré la pénurie de RAM

Les innovations ne dépendent pas uniquement des algorithmes. Elles reposent aussi sur des infrastructures capables d’entraîner, tester, puis déployer. Dans la technologie 2026, les supercalculateurs et les clusters accélérés raccourcissent les cycles de validation, notamment en santé et biotechnologies. Pourtant, un paradoxe demeure : même avec plus de puissance, la pénurie de RAM et les contraintes de coût limitent la montée en charge. L’optimisation redevient donc une compétence centrale.

Pour des applications de vision, la mémoire sert à la fois aux buffers vidéo, aux features, aux modèles et aux logs. Sur l’Edge, cette contrainte est encore plus forte. Ainsi, une plateforme de type q-tec gagne à combiner compression intelligente, quantification de modèles et pipelines plus sobres. Ce pragmatisme produit souvent plus de valeur qu’une course à la taille des modèles.

Tests matériels : critères de choix concrets pour une plateforme q-tec

Un test rigoureux commence par les contraintes du terrain. D’abord, la stabilité thermique compte, car une caméra embarquée peut être enfermée dans un boîtier. Ensuite, la tolérance aux vibrations protège la qualité d’image et la connectique. Enfin, la maintenabilité pèse lourd : accès aux journaux, mise à jour sécurisée, et diagnostic à distance. Ces critères se mesurent, donc ils doivent être définis avant l’achat.

Dans “Atelier Nova”, un pilote de quatre semaines sert de filtre. Une partie des caméras est montée près d’une presse, l’autre près d’une zone poussiéreuse. Les résultats montrent que le matériel n’échoue pas sur la précision, mais sur la dérive de calibration et la qualité des optiques. Cette observation change le budget : l’optique et l’éclairage reçoivent plus d’investissement, car ils stabilisent tout le système.

Photonic computing : l’option rupture face aux goulets d’étranglement IA

Un événement marquant du secteur en 2026 concerne une initiative de puce optique lancée par Q/C Technologies, visant à contourner certains goulets d’étranglement des GPU traditionnels. L’idée consiste à exploiter le calcul photonique sur silicium pour améliorer l’efficacité sur des charges spécifiques. Ce type de recherche n’aboutit pas du jour au lendemain, toutefois il indique une direction : réduire le coût énergétique et atténuer des limites de complexité sur certaines opérations.

Pourquoi ce point concerne-t-il q-tec et l’Edge ? Parce que les retombées finissent souvent par descendre vers des modules spécialisés. À terme, des accélérateurs plus sobres peuvent rendre des analyses avancées possibles hors datacenter. En attendant, la meilleure stratégie reste une recherche et développement structurée : mesurer, optimiser, puis standardiser.

De l’infrastructure au produit : une chaîne R&D qui tient la route

Une chaîne solide s’appuie sur des environnements séparés : entraînement, validation, puis production. Ensuite, des jeux de tests figés garantissent que chaque mise à jour n’introduit pas de régression. Enfin, un monitoring de dérive relie le monde réel au laboratoire. Cette discipline change la perception de l’IA, car elle la fait entrer dans l’ingénierie logicielle classique.

La transition naturelle conduit vers les usages visibles par le grand public : domotique et systèmes personnels, où la sobriété, la sécurité et la simplicité déterminent l’adoption.

Applications concrètes : maison connectée, Linux, et déploiements q-tec orientés futur

Le renouveau de la maison connectée ne vient pas d’une avalanche de gadgets. Il vient d’une meilleure intégration et d’une autonomie accrue. Dans la technologie 2026, les appareils coordonnent leurs actions, sans dépendre en permanence d’un cloud distant. Cette évolution rejoint la logique Edge déjà observée dans l’industrie. Ainsi, une caméra intelligente peut détecter un événement, classer l’alerte et ne transmettre qu’un résumé. Cette sobriété protège la vie privée, tout en améliorant l’expérience.

Dans un immeuble, un système de surveillance “raisonnable” illustre cette approche. Les flux restent locaux, l’IA détecte des comportements à risque, puis l’utilisateur reçoit une notification contextualisée. Cependant, l’éthique impose des limites : zones floutées, conservation réduite, et contrôle des accès. La confiance se construit autant sur l’interface que sur le chiffrement.

Linux en progression : opportunité après la fin de cycle de certains OS

La fin de support de Windows 10 pousse des organisations à reconsidérer leur parc. Dans ce contexte, Linux gagne du terrain, surtout sur des postes spécialisés et des systèmes embarqués. L’open-source séduit pour trois raisons : contrôle, auditabilité et flexibilité. De plus, des environnements conteneurisés simplifient le déploiement de modèles, ce qui réduit les écarts entre développement et production.

Ce mouvement a aussi une dimension économique. Quand la licence n’est plus le centre du débat, l’attention se déplace vers le support, l’intégration et la sécurité. Autrement dit, la valeur se situe dans l’industrialisation, pas dans l’icône sur le bureau. Cette logique correspond bien aux besoins de l’industrie 4.0.

Comparaison d’usages : où q-tec apporte le plus, et où éviter la surenchère

Les applications gagnantes sont celles qui exploitent la modularité sans complexifier l’exploitation. Le contrôle qualité, l’inspection thermique et la lecture de marquages sont des terrains favorables. À l’inverse, certaines équipes surinvestissent dans des capteurs avancés sans plan de calibration. Le résultat est prévisible : dérive, coûts et déceptions. Une règle tient : un bon système privilégie la stabilité et la mesure.

Une question rhétorique aide à cadrer : faut-il vraiment un modèle géant, ou une meilleure chaîne d’acquisition et un modèle robuste ? Dans la plupart des projets, la deuxième option gagne. C’est aussi là que les technologies émergentes deviennent utiles : elles servent un besoin, plutôt qu’une démonstration.

Checklist de déploiement : du pilote au multi-sites

Pour passer du prototype à la généralisation, quelques étapes reviennent. D’abord, un pilote instrumenté produit des métriques fiables. Ensuite, la documentation devient un livrable, pas un “bonus”. Enfin, le parc doit être gérable, sinon les mises à jour deviennent un risque. Ce fil conducteur prépare les décisions d’achat et sécurise le retour sur investissement.

L’insight final est clair : le futur appartient aux systèmes qui restent simples à opérer, même quand la technique est sophistiquée.

Que signifie q-tec dans le contexte des innovations 2026 ?

q-tec renvoie ici à une approche de plateformes de caméras intelligentes modulaires, combinant CPU, GPU, FPGA et Edge AI. L’intérêt, en technologie 2026, est d’exécuter plus de traitements près des capteurs pour réduire la latence, limiter les flux de données et renforcer la confidentialité.

Quelles applications q-tec sont les plus rentables en industrie 4.0 ?

Les cas les plus rentables concernent le contrôle qualité en vision, l’inspection de surface, la lecture de codes et marquages, ainsi que la maintenance prédictive via thermique. Ces applications profitent d’un traitement Edge stable, d’une latence faible et d’une intégration plus simple dans des processus existants.

Comment sécuriser des flux vidéo et des modèles IA avec Zero Trust et informatique confidentielle ?

Zero Trust impose une vérification stricte des identités, des appareils et des droits, y compris sur les accès internes. L’informatique confidentielle ajoute un chiffrement lors du traitement, via des environnements sécurisés. Ensemble, ces méthodes réduisent les risques de fuite, surtout quand des applications combinent Edge et cloud souverain.

La pénurie de RAM impacte-t-elle vraiment la transformation digitale ?

Oui, car la mémoire conditionne les buffers vidéo, les modèles et les logs, notamment sur l’Edge. Pour éviter les blocages, la recherche et développement privilégie l’optimisation : quantification, pipelines sobres, sélection d’images utiles, et monitoring de dérive. Cette discipline rend la transformation digitale plus durable et plus prévisible.