⚡En Bref

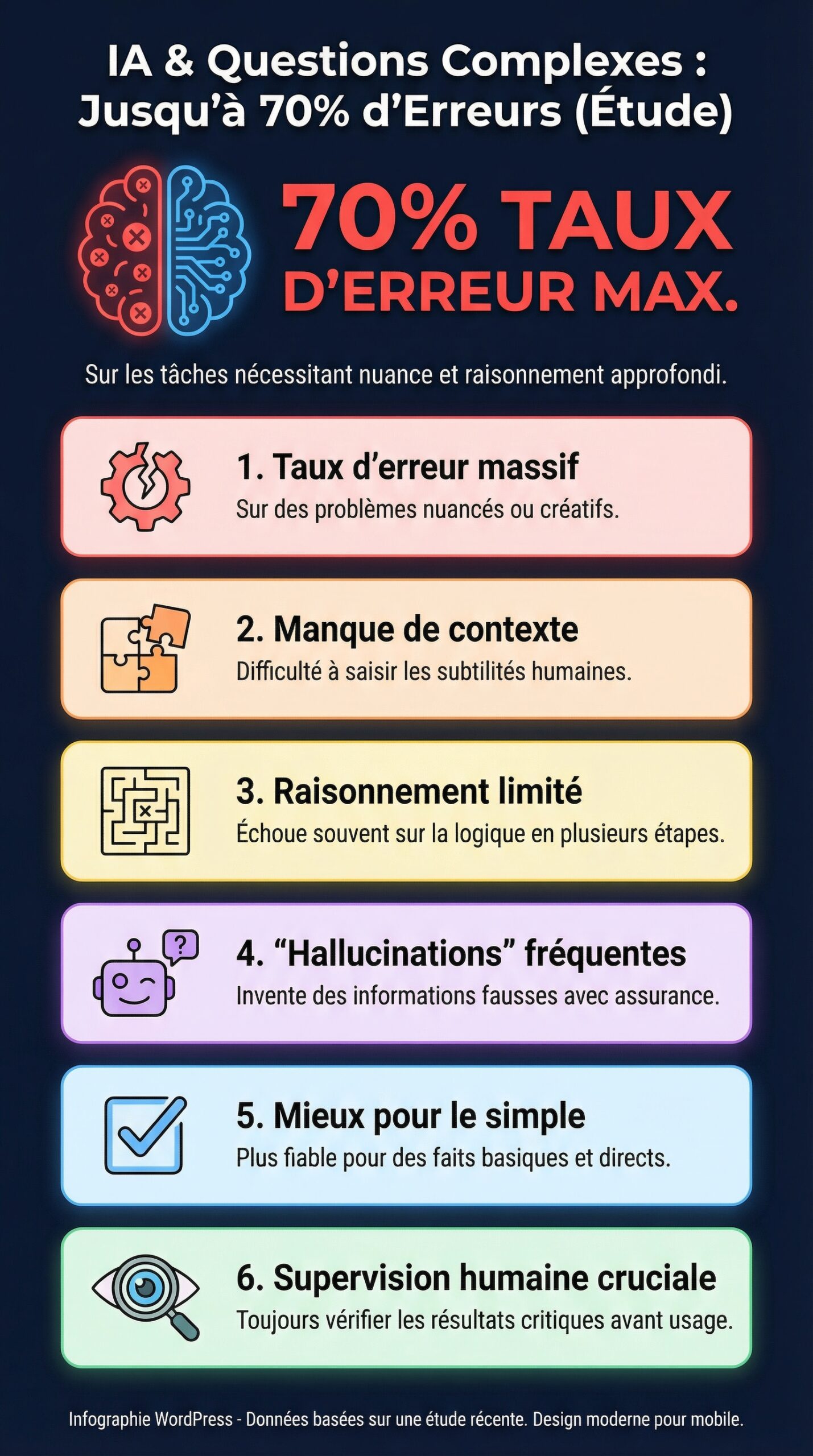

- 🧪 Une étude suisse met en évidence des erreurs fréquentes des IA sur des questions complexes, avec un taux d’erreur allant d’environ 30% à plus de 70% selon les modèles.

- 🔁 Les réponses qui suivent une première question semblent faire grimper les “hallucinations”, ce qui interroge la fiabilité en conversation longue.

- ⚖️ Les domaines médical, légal, recherche et programmation restent sensibles, car une erreur y coûte plus cher qu’un simple détail faux.

- 🧰 La meilleure défense combine analyse de données, vérification de sources, tests reproductibles et réglages côté produit (RAG, citations, garde-fous).

- ✅ L’enjeu ne consiste pas à “faire répondre”, mais à améliorer la précision et à accepter un “je ne sais pas” quand les signaux de confiance chutent.

Les assistants d’intelligence artificielle se sont imposés dans les usages quotidiens, du support technique au résumé de documents. Pourtant, une enquête menée par un collectif de chercheurs suisses relance un débat central : que valent réellement ces outils quand la demande sort des sentiers battus ? L’équipe a testé plusieurs IA génératives via un benchmark nourri de questions complexes et répétées, dans des domaines où l’approximation n’est pas un détail. Résultat : selon les modèles, le taux d’erreur grimpe fortement, allant d’environ 30% pour la meilleure solution jusqu’à plus de 70% pour la moins performante.

Cette photographie contraste avec l’image “magique” souvent associée aux chatbots. Car sur une requête simple, l’IA brille encore. En revanche, dès qu’il faut raisonner, citer un cadre légal, respecter un protocole médical, ou produire du code robuste, les erreurs deviennent plus fréquentes. Fait marquant : les questions de suivi, posées après une première réponse, augmenteraient nettement les hallucinations. Or une conversation en conditions réelles ressemble justement à une série d’itérations. Dans un contexte où, selon une enquête Ipsos publiée en février 2025, 40% des Français utilisent l’IA activement, la fiabilité et la précision ne peuvent plus rester des promesses marketing.

Étude suisse “Halluhard” : comprendre le taux d’erreur des IA sur des questions complexes

Le protocole mis en avant par les chercheurs repose sur une idée simple : évaluer des IA comme on teste un composant hardware, avec des charges réalistes et répétées. Ainsi, le benchmark a utilisé environ 950 questions posées à plusieurs reprises, réparties en quatre champs : droit, recherche, médecine et programmation. Ce choix est stratégique, car ces domaines combinent jargon, nuances et dépendance au contexte. Par conséquent, la moindre approximation peut basculer d’un conseil “acceptable” vers une recommandation dangereuse.

Le point le plus instructif concerne la dynamique de dialogue. Les chercheurs décrivent une séquence avec une question ouverte initiale, puis deux questions de suivi. Or, les hallucinations augmentent surtout après la première réponse. Autrement dit, l’IA peut démarrer “proprement”, puis dériver quand il faut maintenir une cohérence sur plusieurs tours. Ce comportement rappelle un overclocking mal stabilisé : un test court passe, mais une charge prolongée révèle les instabilités. Cette analogie parle aux lecteurs hardware, car elle montre que la performance perçue dépend du scénario de test.

Pourquoi les résultats varient autant entre modèles, de 30% à plus de 70%

Plusieurs facteurs expliquent ces écarts. D’abord, les modèles n’emploient pas les mêmes algorithmes d’alignement et de filtrage. Ensuite, la qualité des données d’entraînement et des étapes d’apprentissage automatique change selon les éditeurs. Enfin, l’accès à des outils annexes, comme la recherche web ou des bases de connaissances internes, influence la robustesse sur des faits pointus. Toutefois, même avec ces aides, une IA peut produire une réponse “bien écrite” mais fausse, ce qui trompe l’utilisateur pressé.

Un exemple concret illustre l’écueil. Dans une simulation de support IT, une PME fictive, “Atelier Nord”, demande une procédure de durcissement d’un serveur et enchaîne avec des contraintes réseau. La première réponse reste plausible. Pourtant, au second échange, le chatbot invente une option inexistante dans la version du système, puis justifie l’invention avec des termes crédibles. Dans un environnement réel, ce type d’erreur consomme du temps et peut créer une faille. La leçon est nette : la précision ne se juge pas sur un seul message, mais sur la tenue de route sur la durée.

Ce constat prépare naturellement la question suivante : d’où viennent ces dérives, et pourquoi la machine “préfère” répondre plutôt que d’admettre une limite ?

Hallucinations et fiabilité : ce que les erreurs révèlent sur l’apprentissage automatique et les algorithmes

Une IA générative vise d’abord à produire une suite de mots probable, pas à “dire vrai”. Ce point, souvent mal compris, explique beaucoup d’erreurs. Le modèle optimise une fonction de probabilité apprise via apprentissage automatique, puis applique des stratégies de décodage. Dès lors, quand une question manque de contexte ou exige une référence précise, l’algorithme comble les trous. Ainsi naît l’hallucination : une réponse cohérente en surface, mais infidèle sur le fond.

Ensuite, la fiabilité se dégrade quand la question impose plusieurs contraintes. Par exemple, “rédiger une clause de contrat conforme à un cadre national, tout en respectant une jurisprudence récente” mélange droit, temporalité, exceptions et style. Même si l’IA a vu des milliers de clauses, elle peut fusionner des éléments incompatibles. Or, le texte final semble crédible. C’est justement le piège : l’utilisateur voit de l’assurance, et confond assurance et exactitude.

Pourquoi les questions de suivi font grimper le taux d’erreur

Dans une conversation, chaque tour ajoute du contexte. Cependant, ce contexte peut aussi introduire des ambiguïtés. Si l’utilisateur corrige une partie, l’IA peut surcorriger ailleurs. De plus, certains modèles “perdent” des détails en contexte long, malgré de grandes fenêtres de contexte annoncées. Il en résulte un glissement progressif : un paramètre change sans que personne ne s’en rende compte. Par conséquent, la réponse du troisième tour peut contredire le premier, tout en restant grammaticalement parfaite.

Un cas fréquent apparaît en programmation. Un développeur demande un script, puis ajoute une contrainte de performance, puis exige une compatibilité avec une version de bibliothèque. À ce stade, l’IA peut mélanger des API de versions différentes. Le code compile parfois. Pourtant, il échoue sur des cas limites. Dans un pipeline CI, l’échec est visible. En production, la panne se déclenche plus tard, donc coûte plus cher. Voilà pourquoi le taux d’erreur doit être interprété comme un risque opérationnel, pas comme une simple statistique.

Analyse de données et métriques : ce que les benchmarks mesurent… et ce qu’ils ratent

Les benchmarks apportent une base de comparaison, car ils standardisent les entrées. Néanmoins, une métrique globale cache des différences. Une IA peut exceller en synthèse, mais échouer en calcul de doses médicales. À l’inverse, un modèle peut être bon en code, mais fragile en droit. Il faut donc des métriques par domaine, par niveau de complexité, et par type d’erreur. Par exemple : erreur factuelle, erreur de raisonnement, citation inventée, ou non-respect d’une contrainte.

Cette exigence ressemble aux tests hardware modernes : un score unique ne suffit plus. On veut des courbes, des scénarios, et des mesures reproductibles. La suite logique consiste donc à regarder comment ces résultats influencent les produits concrets, du PC “Copilot+” aux smartphones, et jusqu’aux stations de travail IA.

Impacts concrets en 2026 : du PC IA aux services cloud, quand la précision devient un critère produit

Les IA génératives ne vivent plus seulement dans un onglet de navigateur. Elles s’intègrent dans des systèmes d’exploitation, des suites bureautiques, et des services cloud. De plus, le marché pousse des PC “IA” avec NPU dédiés, tandis que les GPU accélèrent l’inférence côté serveur. Pourtant, une intégration profonde augmente l’enjeu : si une réponse erronée pilote une action, l’erreur ne reste pas théorique. Ainsi, la fiabilité devient un critère d’achat, au même titre que l’autonomie ou les performances.

Dans un service client, un agent augmenté par IA peut traiter plus de tickets. Cependant, une hallucination sur une procédure de retour, ou sur un diagnostic, crée un conflit. Dans un contexte médical, un résumé automatique peut omettre une allergie mentionnée plus haut. Dans un cadre légal, une clause générée peut ignorer une exception locale. Ces scénarios ne relèvent pas du sensationnel. Ils décrivent plutôt un risque banal, donc fréquent, qui s’accumule à l’échelle.

Comparaison terrain : modèles généralistes, modèles spécialisés et RAG

Les entreprises ont désormais trois approches. Premièrement, utiliser un modèle généraliste “tel quel”. C’est rapide, mais risqué sur des questions complexes. Deuxièmement, adopter un modèle spécialisé, entraîné sur un domaine. Cela améliore souvent la précision, mais réduit la polyvalence. Troisièmement, combiner un modèle avec du RAG (retrieval augmented generation), afin d’ancrer la réponse dans des documents internes. Cette troisième voie progresse vite, car elle s’appuie sur de l’analyse de données et sur des sources contrôlées.

Un exemple concret : “Atelier Nord” déploie un assistant interne branché sur sa base de procédures. Résultat, les réponses citent des extraits, et la variabilité baisse. Néanmoins, un piège subsiste : si la base est obsolète, l’IA propage une vieille recommandation. Par conséquent, la qualité documentaire devient un composant du produit IA. Cela ressemble à un firmware : une bonne puce ne compense pas une mauvaise version logicielle.

Liste de contrôles simples pour réduire les erreurs en usage quotidien

Pour limiter les dégâts, des gestes pratiques aident, même sans équipe ML. Ils ne rendent pas l’IA “vraie”, mais ils baissent le risque. De plus, ils rendent l’utilisateur acteur, ce qui est essentiel quand 40% d’une population active l’utilise déjà.

- ✅ Demander des sources vérifiables et refuser les citations sans lien 🔗

- 🧩 Imposer les contraintes dès la première question, afin d’éviter les corrections tardives

- 🧪 Tester la réponse avec un contre-exemple (“Et si le cas limite X arrive ?”) 🧯

- 📌 Exiger un format d’incertitude (“niveau de confiance”, hypothèses) pour repérer les zones floues

- 🛠️ Valider sur un environnement de test (sandbox, staging) avant production

À mesure que l’intégration matérielle s’étend, une autre question surgit : comment tester ces outils comme on teste un CPU, une carte graphique ou un SSD, avec des méthodes répétables et utiles ?

Tester une IA comme un composant hardware : protocoles, reproductibilité et analyse de données

Dans le hardware, un bon test sépare l’effet placebo des performances réelles. Il en va de même pour une intelligence artificielle. Or, la variabilité des réponses complique la mesure. Pour y répondre, il faut répéter les mêmes questions, contrôler les paramètres, et conserver les sorties. Ensuite, on calcule un taux d’erreur par catégorie. Cette approche rejoint l’esprit du benchmark suisse : un protocole qui force l’outil à montrer ses limites, au lieu de le laisser briller sur des tâches faciles.

La reproductibilité dépend aussi des réglages. Température, top-p, outils activés, contexte : tout compte. Par conséquent, un test publié sans ces paramètres ressemble à un bench GPU sans driver ni version de jeu. De plus, les mises à jour de modèles changent les résultats. Il faut donc dater les tests et suivre l’évolution, comme on le fait avec des BIOS et microcodes. Cette discipline devient cruciale à mesure que les IA s’installent dans les workflows métier.

Cas d’usage : programmation, scripts et assistants de diagnostic

La programmation offre un terrain idéal. D’un côté, on peut exécuter le code. De l’autre, on peut mesurer la performance et la couverture de tests. Un protocole utile consiste à demander une fonction, puis à générer des tests unitaires, puis à lancer la suite. Si l’IA échoue, on mesure l’écart. Ensuite, on relance avec une contrainte supplémentaire, pour simuler les questions de suivi. On observe alors si la dérive se produit, comme l’indique l’étude suisse.

En diagnostic matériel, un assistant peut proposer des étapes pour isoler une panne : mémoire, alimentation, pilotes, température. Pourtant, si l’IA invente un paramètre BIOS, l’utilisateur perd du temps. Ainsi, un bon assistant devrait fournir des chemins conditionnels, et signaler les points où la certitude manque. À défaut, l’assurance verbale masque les lacunes. Ce phénomène explique pourquoi la fiabilité ne doit pas être évaluée au “feeling”.

Mettre en place un scoring interne : précision, cohérence, et coût des erreurs

Un scoring utile ne se limite pas à “vrai/faux”. Il doit intégrer le coût. Une erreur sur une capitale coûte peu. Une erreur sur une posologie coûte cher. Par conséquent, les équipes peuvent attribuer un poids aux catégories, puis produire un score pondéré. Ensuite, elles suivent la tendance dans le temps, après chaque mise à jour de modèle ou de base documentaire. Cette logique rapproche l’IA du monde des SLO et des SLA : on mesure, on versionne, et on corrige.

Enfin, un bon protocole prévoit un test d’abstention : l’IA a-t-elle la capacité de dire “je ne sais pas” ? Quand cette option existe, le produit gagne en crédibilité. Cet enjeu mène directement au dernier axe : la gouvernance, les garde-fous, et les choix produit qui réduisent les hallucinations sans casser l’expérience.

Vers des IA qui savent dire “je ne sais pas” : garde-fous, gouvernance et choix produit

Les résultats de l’étude suisse mettent en lumière un dilemme : l’IA est conçue pour répondre, même quand la réponse manque. Pourtant, dans les domaines critiques, une abstention vaut mieux qu’une invention. Par conséquent, les éditeurs et les intégrateurs travaillent sur des mécanismes de refus, de prudence, et de citation. Cette évolution s’observe aussi dans les politiques internes des entreprises, qui encadrent l’usage des chatbots pour éviter la fuite de données ou la diffusion d’informations fausses.

Dans les produits grand public, l’équilibre reste délicat. Trop de refus frustrent. Trop de liberté augmente les erreurs. La solution passe souvent par des modes. Un mode “créatif” peut tolérer l’imagination. En revanche, un mode “expert” exige des références et un contrôle strict. Dans une suite bureautique, cela peut devenir un simple bouton. Dans un outil de développement, cela peut être un profil de génération. Quoi qu’il en soit, ce design doit être explicite, sinon l’utilisateur pense recevoir une vérité.

Alignement, filtres et vérification : ce qui marche vraiment

Les filtres de sécurité réduisent certains abus, mais ils ne garantissent pas la précision. Pour limiter les hallucinations, plusieurs leviers sont plus efficaces. D’abord, l’ancrage sur des documents via RAG, avec citations cliquables. Ensuite, la vérification croisée : demander à un second modèle de critiquer la réponse, ou appliquer des règles. Enfin, la structuration des sorties, qui force l’IA à séparer faits, hypothèses et recommandations. Cette séparation aide l’humain à repérer la partie fragile.

Dans le monde hardware, un parallèle existe avec l’ECC en mémoire : on ne supprime pas toutes les erreurs, mais on les détecte et on les corrige. De même, l’IA a besoin de mécanismes de détection. Sans cela, une phrase fluide gagne par défaut. Or, la fluidité ne constitue pas une preuve. Cette idée, simple mais souvent oubliée, peut guider les choix d’outils.

Culture d’équipe : former, documenter, et tracer les décisions

La gouvernance ne se résume pas à une charte. Elle passe par des habitudes. Par exemple, tracer quand une IA a contribué à une décision. Ou encore, conserver les prompts et les réponses dans les tickets. De plus, former les équipes aux limites des modèles évite l’illusion d’infaillibilité. Une entreprise qui documente ses procédures réduit aussi les risques, car un bon assistant a besoin de bonnes sources. En somme, la meilleure IA ne compense pas un SI documentaire en désordre.

À ce stade, les questions pratiques reviennent toujours : comment choisir un outil, comment l’utiliser sans se faire piéger, et comment interpréter un chiffre comme “70% d’erreurs” sans paniquer ni minimiser ?

Le chiffre de 70% d’erreurs signifie-t-il que toutes les IA sont inutilisables ?

Non. Le chiffre concerne des questions complexes dans un benchmark précis et sur certains modèles. Sur des requêtes simples, la précision reste souvent bonne. En revanche, pour le médical, le légal, la recherche ou la programmation critique, ce taux d’erreur indique un risque réel et impose une vérification systématique.

Pourquoi une IA répond au lieu de dire ‘je ne sais pas’ ?

Les modèles génératifs sont optimisés pour produire une réponse plausible à partir de probabilités apprises. Sans mécanisme d’abstention ou de vérification externe, ils comblent les zones floues. Des garde-fous (modes prudents, citations, RAG, scoring de confiance) améliorent ce point, mais ils demandent un design produit volontaire.

Comment réduire les erreurs sur des questions complexes en entreprise ?

Il faut combiner plusieurs couches : documents internes à jour (base de connaissances), RAG avec citations, tests reproductibles, et procédures de validation humaine sur les sujets à fort impact. En pratique, l’analyse de données (logs, catégories d’erreurs, coût des incidents) aide à prioriser les corrections.

Quelles métriques suivre au-delà du taux d’erreur global ?

Un score unique masque les faiblesses. Il est préférable de suivre des métriques par domaine (droit, code, médical), par type d’erreur (factuelle, raisonnement, citation inventée), et par étape de dialogue (question initiale vs questions de suivi). Une mesure de cohérence inter-tours et une mesure d’abstention (‘je ne sais pas’) apportent aussi une vue plus réaliste.