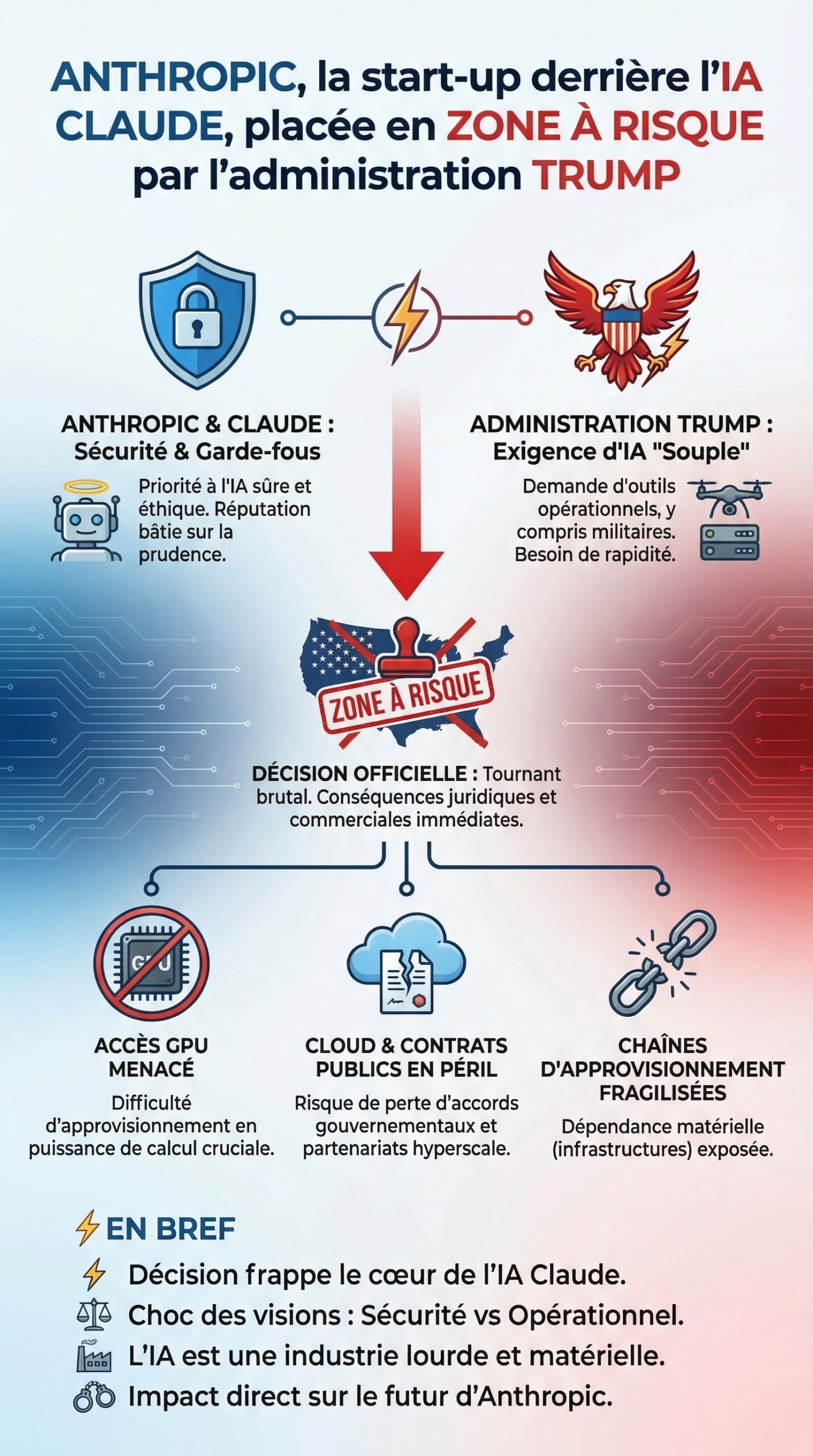

Le classement d’Anthropic en zone à risque par l’administration Trump marque un tournant brutal dans la guerre technologique autour de l’intelligence artificielle. D’un côté, une start-up américaine qui a bâti sa réputation sur la sécurité et les garde-fous de l’IA Claude. De l’autre, un État fédéral qui exige des outils plus “souples”, capables de répondre à des besoins opérationnels, y compris militaires. Entre les deux, il y a une réalité très matérielle : GPU, cloud, contrats publics et chaînes d’approvisionnement. Car, derrière les communiqués, l’IA reste une industrie lourde. Elle dépend d’infrastructures de calcul, de fournisseurs hyperscale et d’accords de distribution.

Or, ce type de désignation n’est pas symbolique. Elle peut couper l’accès d’une entreprise à des marchés, mais aussi à des partenaires techniques. Cela change la trajectoire produit, le calendrier de déploiement et même les choix d’architecture. Dans ce contexte, l’affaire Anthropic devient un cas d’école : comment une doctrine de réglementation et de sécurité peut-elle se heurter à des impératifs de souveraineté et de défense ? Et surtout, que se passe-t-il quand la politique reconfigure la pile technologique, du modèle jusqu’au datacenter ? La suite examine les impacts concrets, avec des exemples de terrain et des comparaisons utiles pour comprendre ce qui se joue.

⚡En Bref

- 🧩 Anthropic et son IA Claude sont classés “zone à risque” par l’administration Trump, ce qui menace l’accès aux contrats fédéraux.

- 💰 Un contrat Défense de 200 millions de dollars signé en juillet 2025 devient un point de rupture, car l’entreprise refuse des usages militaires et de surveillance de masse.

- ☁️ Le risque majeur touche aussi le cloud : si des fournisseurs liés à l’État cessent de collaborer, la capacité de calcul peut s’effondrer.

- 🔒 Le dossier relance le débat sur la sécurité, la réglementation et la place des garde-fous dans les modèles génératifs.

- ⚙️ Pour le marché, c’est aussi une bataille d’écosystèmes face à d’autres solutions, dont celles d’OpenAI, au moment où les administrations arbitrent leurs piles IA.

Anthropic en “zone à risque” : ce que signifie la décision et pourquoi elle frappe l’IA Claude

La mention “zone à risque” n’a rien d’une étiquette marketing. Elle renvoie à une logique d’approvisionnement : un acteur est jugé dangereux pour la continuité des systèmes, l’accès aux composants, ou la fiabilité des prestataires. Ainsi, l’administration Trump place Anthropic dans une catégorie où des sanctions contractuelles deviennent possibles. Ensuite, la cascade peut aller vite : suspension d’achats, résiliation de partenariats, puis éviction de projets pilotes.

Cette mécanique rappelle des précédents. Des entreprises comme Huawei ou Kaspersky ont déjà été traitées comme des risques dans des cadres similaires, même si le contexte n’était pas identique. Cependant, l’onde de choc est différente ici : Anthropic est une start-up américaine, au cœur de l’écosystème IA US. Dès lors, ce n’est plus seulement une question de frontières. C’est une tension interne entre doctrine politique et industrie locale.

Des conséquences juridiques et commerciales immédiates

Dans les faits, une entreprise classée à risque peut être écartée de la commande publique. Par conséquent, la ligne de revenus liée aux agences fédérales devient instable. Or Anthropic travaillait avec plusieurs entités, dont le Trésor, qui a annoncé la fin de son partenariat. Cette rupture pèse aussi sur la crédibilité, car elle signale aux acheteurs privés qu’un fournisseur peut devenir “inopérable” du jour au lendemain.

Le point sensible reste le contrat de 200 millions de dollars signé en juillet 2025 avec le ministère de la Défense. Ce montant n’est pas seulement financier. Il valide une capacité à opérer à grande échelle, avec des exigences strictes. Quand un tel contrat vacille, les roadmaps produit et les recrutements peuvent être revus, parfois en quelques semaines.

Pourquoi l’IA Claude est au centre du bras de fer

Le cœur du conflit touche l’usage : Anthropic refuse que ses modèles servent à l’automatisation d’attaques mortelles ou à la surveillance de masse. D’un point de vue sécurité, c’est cohérent avec une approche “garde-fous d’abord”. Pourtant, côté État, cette position ressemble à une limitation stratégique. Alors, la question devient : qui décide des cas d’usage quand l’outil est devenu critique ?

Pour illustrer, une équipe gouvernementale peut vouloir un agent conversationnel qui agrège des notes classifiées, propose des options et accélère la prise de décision. Techniquement, c’est un usage d’assistance. Toutefois, si la même chaîne alimente une action opérationnelle, la frontière se brouille. C’est précisément dans ces zones grises que la réglementation et l’éthique rencontrent le réel.

À ce stade, un élément est déjà clair : la désignation “à risque” n’attaque pas seulement un produit, elle vise une posture. Et cette posture va être testée sur le terrain du hardware et du cloud.

Contrats publics, cloud et GPU : l’impact matériel d’une mise à l’écart d’Anthropic

L’intelligence artificielle générative n’existe pas sans compute. Donc, au-delà des débats politiques, l’affaire Anthropic se joue dans les datacenters. Quand l’État fédéral classe un fournisseur en zone à risque, il peut dissuader d’autres prestataires de continuer à travailler avec lui. Et c’est là que le cloud devient un levier plus puissant que n’importe quel communiqué.

Les grands opérateurs d’informatique à distance travaillent souvent avec le gouvernement américain. Par conséquent, si les règles de conformité imposent une coupure, Anthropic pourrait perdre l’accès à des environnements critiques. Sans ces ressources, l’entraînement et l’inférence de l’IA Claude deviennent plus chers, plus lents, ou tout simplement impossibles à maintenir au même niveau.

Une dépendance structurelle aux infrastructures

Dans la pratique, un modèle de pointe consomme des grappes de GPU, des interconnexions rapides et des systèmes de stockage performants. Même quand un acteur possède une partie de ses serveurs, il s’appuie souvent sur des clouds hybrides pour absorber des pics. Ainsi, une sanction indirecte peut toucher la disponibilité, puis la qualité de service. Cela se traduit ensuite par des limites de débit, des files d’attente plus longues, ou des fonctionnalités retirées.

Un exemple concret aide à visualiser. Une entreprise fictive, HexaForge, intègre Claude dans son support technique hardware. Elle automatise le tri des tickets, puis propose des scripts de diagnostic pour des cartes mères et SSD. Si la capacité d’inférence d’Anthropic se contracte, HexaForge subit des latences. Ensuite, elle doit basculer vers un autre fournisseur, ce qui implique migration d’API, requalification sécurité et tests de non-régression. Le coût se chiffre vite, même sans incident majeur.

Effet domino sur l’écosystème partenaires

Au-delà du compute, il y a les intégrateurs, les cabinets de conformité et les distributeurs de solutions IA. Or, beaucoup évitent de s’exposer à un fournisseur jugé risqué. Donc, Anthropic pourrait perdre des relais commerciaux, puis des opportunités d’intégration dans des suites enterprise. Cet effet secondaire est rarement visible au public, mais il fait mal sur la durée.

Voici les zones techniques le plus souvent impactées quand une start-up IA perd l’accès à des partenaires majeurs :

- ☁️ Capacité cloud : quotas GPU réduits, régions indisponibles, contraintes de conformité renforcées.

- 🧠 Cadence modèle : cycles de fine-tuning ralentis, retards de versions, baisse de compétitivité.

- 🔐 Chaîne sécurité : audits supplémentaires, segmentation réseau imposée, durcissement des environnements.

- 📦 Distribution logicielle : marketplace enterprise fermées, intégrations SSO retardées.

- 🧰 Support et SLA : engagements revus à la baisse, temps de réponse allongés pour les clients critiques.

En filigrane, cette affaire montre un point clé : la politique peut agir comme une “coupure d’alimentation” logicielle. Et puisque l’IA est industrielle, la suite logique concerne la comparaison avec les concurrents et les alternatives.

Pour suivre les réactions et les analyses à chaud côté industrie, ce type de requête donne souvent des décryptages utiles, notamment sur l’arbitrage cloud et conformité.

IA, sécurité et réglementation : le dilemme des garde-fous face aux exigences de l’administration Trump

Le nœud du dossier tient en un mot : sécurité. Anthropic a construit sa marque sur l’idée qu’une intelligence artificielle puissante doit être contrainte. Ainsi, certaines demandes, notamment liées à la défense ou à la surveillance, entrent en conflit avec cette doctrine. De son côté, l’administration Trump semble privilégier la maîtrise opérationnelle et la flexibilité, quitte à pousser les fournisseurs à élargir les usages autorisés.

Ce duel n’est pas abstrait. Il touche des sujets comme la rétention des logs, la possibilité de désactiver des filtres, ou la capacité à traiter des données très sensibles. Autrement dit, la réglementation et l’architecture produit se parlent en permanence. Dès qu’un gouvernement demande “plus d’accès”, un éditeur doit traduire cela en permissions, politiques de clés API, et périmètres techniques.

Quand une exigence politique devient une spécification technique

Un garde-fou n’est pas qu’un principe éthique. C’est du code, des règles et des tests. Par exemple, empêcher l’optimisation d’un plan d’attaque peut passer par des détecteurs de requêtes, des refus contextuels, et des limites sur certains outils. Cependant, si un client institutionnel réclame une “exception”, le fournisseur doit choisir : créer une version spéciale, ou refuser. Dans les deux cas, le risque augmente. Soit la complexité explose, soit le marché se ferme.

À l’échelle d’un produit comme IA Claude, ces arbitrages se répercutent sur les versions enterprise. Une variante “gouvernementale” peut exiger un déploiement sur enclave dédiée, avec clés gérées côté client, et auditabilité renforcée. Pourtant, cela ne règle pas la question de fond : l’usage final. C’est pourquoi la réglementation devient un champ de bataille narratif autant que technique.

Cas d’usage : assistance vs automatisation létale

Le discours public oppose souvent “aide à la décision” et “arme autonome”. Or, dans un workflow moderne, les étapes s’enchaînent. Un agent peut résumer des renseignements, puis proposer des options. Ensuite, un autre système peut déclencher une action. Même si Claude ne “tire” rien, il influence. Donc, la responsabilité se diffuse, et la sécurité doit couvrir toute la chaîne.

Un scénario typique dans l’industrie ressemble à ceci : une plateforme ingère des flux, classifie, puis priorise. L’IA réduit le temps d’analyse. Toutefois, si la priorisation devient prescriptive, elle peut orienter un choix critique. Voilà pourquoi Anthropic insiste sur des limites, alors que des acteurs institutionnels demandent de la marge de manœuvre. Cette friction n’est pas près de disparaître, car elle découle de l’usage réel de la technologie.

Au final, la réglementation ne sert plus seulement à encadrer. Elle devient un instrument de compétition. Et cela mène naturellement au match face aux autres fournisseurs.

Pour comparer les positions des principaux acteurs, une recherche ciblée permet de retrouver des débats sur OpenAI, Anthropic et les politiques d’usage en environnement gouvernemental.

Anthropic face à OpenAI et aux alternatives : comparatif produit, intégrations et maturité hardware

Quand un fournisseur comme Anthropic est fragilisé, les acheteurs se tournent vers des plans B. Ainsi, les comparaisons avec OpenAI et d’autres solutions deviennent centrales. Le critère n’est pas seulement la qualité de génération. Il inclut l’intégration SI, la conformité, le coût d’inférence et la disponibilité sur cloud souverain ou enclave dédiée.

Dans les environnements enterprise, un chatbot se juge aussi sur sa capacité à s’insérer dans l’existant : SSO, journalisation, DLP, chiffrement, et gestion fine des permissions. Par conséquent, une start-up peut perdre un appel d’offres même avec un modèle excellent, si son écosystème vacille. La désignation en zone à risque devient alors un handicap contractuel, avant même les benchmarks.

Ce que les équipes IT regardent vraiment en 2026

Les directions techniques évaluent la robustesse au-delà du marketing. D’abord, elles testent la latence sous charge. Ensuite, elles mesurent la stabilité des APIs et la compatibilité avec leurs pipelines de données. Enfin, elles exigent une traçabilité sur la sécurité et la conformité. Ces points peuvent faire basculer un choix, même si le modèle concurrent “répond” un peu moins bien sur certains prompts.

Un cas d’école : une DSI d’un groupe industriel qui conçoit des systèmes embarqués. Elle veut un assistant pour analyser des dumps de logs, corréler des erreurs PCIe, et générer des procédures de RMA. Si Anthropic subit des coupures cloud, la DSI privilégiera un acteur offrant une disponibilité garantie, même à coût plus élevé. Ainsi, la fiabilité devient un avantage compétitif.

Tests d’usage : support hardware, sécurité et coûts

Dans un usage hardware, l’IA doit rester factuelle. Elle doit aussi citer des hypothèses, et proposer des étapes reproductibles. Par exemple, face à un SSD qui throttle, un bon assistant demandera la température, le firmware, puis recommandera un test SMART et un benchmark séquentiel. Cependant, si des contraintes de sécurité limitent l’accès à certains outils, l’expérience se dégrade. Donc, l’intégration d’outils (agents) et les garde-fous doivent être équilibrés.

Pour éclairer le choix, voici une grille pratique utilisée par de nombreuses équipes lors de POC, avec des critères concrets :

- 🧪 Qualité de réponse : précision technique, gestion des incertitudes, cohérence sur longues conversations.

- ⚙️ Intégrations : connecteurs, IAM/SSO, export des logs, compatibilité SIEM.

- 🧱 Options de déploiement : cloud public, enclave dédiée, restrictions de données.

- 💸 Coût total : prix tokens + outils + surcharge de conformité + support.

- 🛡️ Risque fournisseur : stabilité réglementaire, dépendances cloud, continuité des SLA.

En creux, la décision politique redéfinit la notion même de “meilleur modèle”. Ce n’est plus un podium de benchmarks. C’est un arbitrage entre performance et continuité.

Dario Amodei et la stratégie de désamorçage : négociation, repositionnement et scénarios techniques possibles

Face à la pression, la direction d’Anthropic tente de réduire la tension. Dario Amodei a indiqué rester en contact avec le ministère de la Défense, avec l’objectif de “désamorcer” le conflit et trouver une issue. Cette approche ressemble à une négociation de conformité : l’entreprise cherche une formule qui préserve ses limites d’usage tout en rendant le produit acceptable pour des clients institutionnels.

Dans ce type de crise, trois leviers reviennent souvent. D’abord, clarifier le périmètre : quelles tâches sont autorisées, lesquelles restent interdites. Ensuite, proposer des contrôles : audit, traçabilité, et segmentation. Enfin, offrir des garanties techniques : déploiement isolé, clés gérées par le client, et mécanismes d’arrêt d’urgence. Chaque levier a un coût, mais il peut sauver l’accès au compute et aux partenaires.

Scénario 1 : version “gouvernement” verrouillée par design

Un chemin possible consiste à proposer une édition spécifique de IA Claude avec restrictions fortes. Par exemple, un modèle peut fonctionner dans une enclave sans sorties non validées, avec outils limités à la recherche documentaire. Ainsi, l’assistance est possible, mais l’automatisation d’actions dangereuses reste bloquée. Ce compromis plaît parfois aux juristes, car il réduit la responsabilité.

Cependant, une édition spéciale demande une maintenance dédiée. Or, dans l’IA, maintenir deux lignes produit coûte cher : datasets, évaluations et correctifs. De plus, cela peut créer des demandes d’“exceptions” qui se multiplient. À terme, la complexité peut devenir un risque produit.

Scénario 2 : bascule vers une indépendance compute partielle

Si le cloud se ferme, une autre stratégie consiste à sécuriser du compute alternatif. Cela peut passer par des accords avec des opérateurs non exposés aux mêmes contraintes, ou par une montée en puissance d’infrastructures propres. Pourtant, les GPU haut de gamme restent rares, et les délais d’installation datacenter sont longs. Donc, cette voie protège le futur, mais elle ne résout pas l’urgence.

Dans le monde hardware, ce scénario implique des choix d’interconnexions, de refroidissement et de densité. Un cluster dense exige des solutions réseau rapides et une gestion thermique robuste. Ainsi, une crise réglementaire peut déclencher un investissement matériel massif, ce qui est paradoxal pour une start-up.

Scénario 3 : recentrage commercial sur le privé et l’international

Enfin, Anthropic peut renforcer ses positions hors fédéral : grandes entreprises, éducation, ou secteurs où la conformité diffère. Toutefois, l’international apporte ses propres contraintes, notamment en matière de transfert de données et de réglementation locale. Donc, la diversification réduit la dépendance, mais augmente la complexité juridique.

Quelle que soit l’issue, un point reste déterminant : la capacité à concilier sécurité et utilité, sans perdre l’accès aux fondations matérielles. C’est le test ultime pour un acteur de l’intelligence artificielle en 2026.

Que veut dire “zone à risque” pour une entreprise comme Anthropic ?

Cela désigne une entreprise jugée problématique pour les approvisionnements ou la continuité. Concrètement, cela peut mener à l’exclusion des contrats publics et décourager des partenaires liés au gouvernement, notamment côté cloud et intégration.

Pourquoi le contrat de 200 millions de dollars avec la Défense américaine est-il si important ?

Au-delà du chiffre, ce contrat signé en juillet 2025 valide une capacité à opérer avec des contraintes strictes (sécurité, conformité, disponibilité). Sa remise en cause fragilise les revenus, mais aussi la crédibilité technique et commerciale.

Quels risques techniques pèsent sur l’IA Claude si des fournisseurs cloud se retirent ?

Le risque principal concerne la capacité GPU et l’accès aux régions cloud. Sans compute suffisant, l’inférence devient plus lente, les coûts montent, et la cadence de mise à jour des modèles ralentit, ce qui peut pousser des clients à migrer.

Une IA peut-elle être utilisée pour des opérations militaires sans être une arme autonome ?

Oui. Un système peut assister l’analyse, résumer des informations et proposer des options. Toutefois, même sans déclencher l’action finale, il influence des décisions. C’est pourquoi les garde-fous et la traçabilité deviennent centraux dans la réglementation et la sécurité.

Quelles alternatives les entreprises envisagent-elles si Anthropic devient difficile à utiliser ?

Elles comparent surtout la fiabilité, les intégrations (SSO, logs, DLP), les options de déploiement et le risque fournisseur. Selon les contraintes, des solutions concurrentes, parfois plus simples à contractualiser, peuvent être privilégiées malgré des différences de performance.