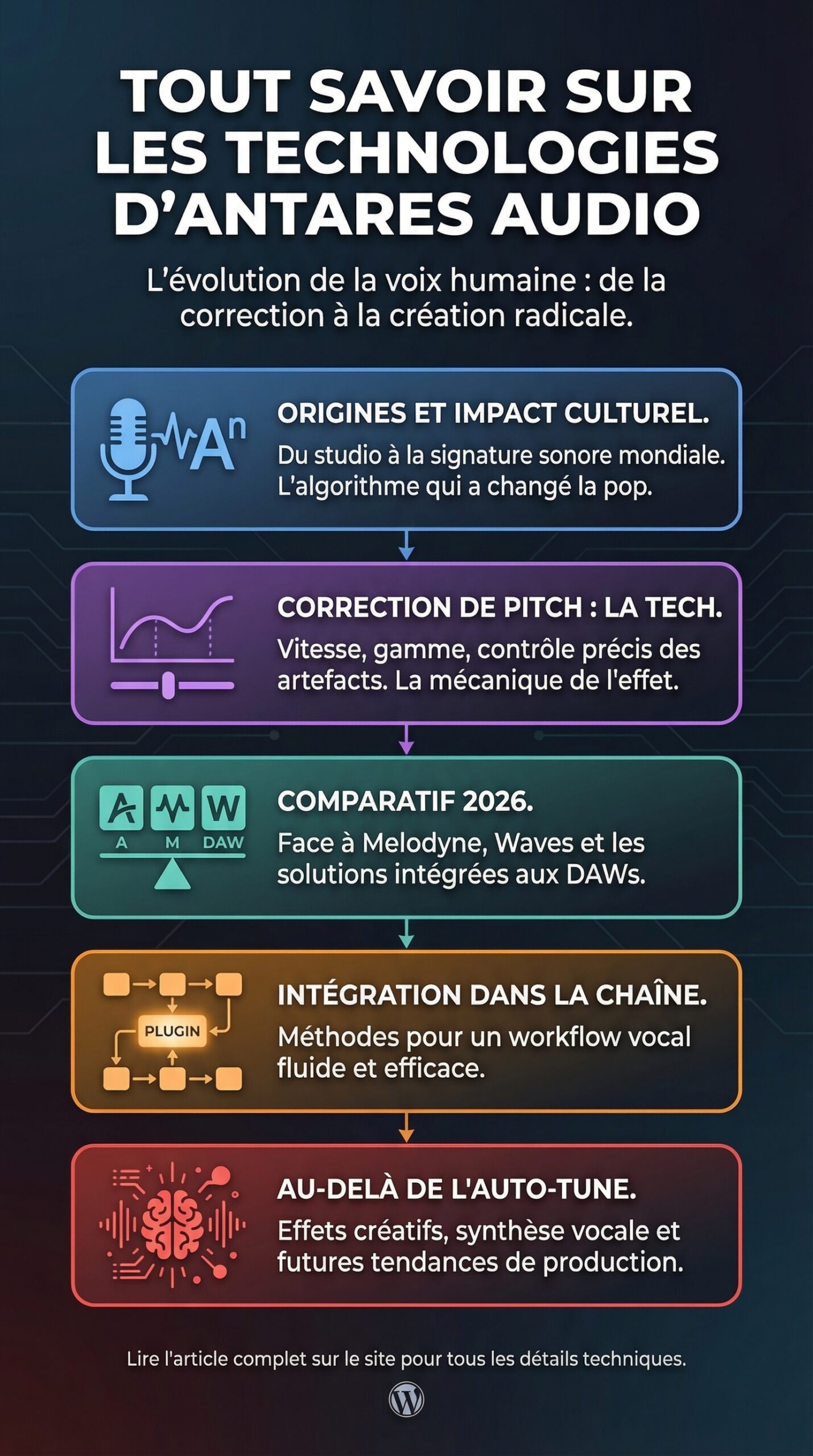

Dans l’univers du logiciel audio, peu d’éditeurs ont autant marqué la voix que Antares Audio. Leur nom reste indissociable de l’auto-tune, devenu à la fois outil discret de studio et signature sonore assumée. Pourtant, réduire Antares à un seul effet serait passer à côté d’une logique technologique plus large, centrée sur la captation, l’analyse et la transformation de la voix humaine. Au fil des mises à jour, la promesse a évolué : accélérer les sessions, sécuriser les prises, mais aussi ouvrir des voies créatives, parfois radicales, dans la production musicale.

Cette trajectoire s’explique par une combinaison rare : un socle algorithmique solide, une compréhension fine des contraintes de terrain et une capacité à suivre les tendances sans les subir. Ainsi, quand l’exigence de “propreté” s’est imposée dans les années 2010, la correction de pitch a été normalisée. Puis, quand l’esthétique robotique a envahi le rap et l’électro, les réglages extrêmes ont quitté le statut d’accident pour devenir un instrument. Désormais, l’enjeu se situe aussi dans l’intégration : latence, compatibilité, flux de travail, et articulation avec d’autres effets audio et chaînes de traitement du son.

En Bref

- Antares Audio a popularisé l’auto-tune, mais ses technologies audio couvrent aussi la création et la production vocale au sens large.

- La correction de pitch repose sur l’analyse de la hauteur et sur des réglages clés, dont la vitesse de retargeting, qui influence le rendu naturel ou robotique.

- En studio, le plugin vocal sert à sécuriser la justesse et à gagner du temps, tandis que sur scène il répond surtout aux contraintes de latence.

- Les alternatives (Melodyne, Waves, solutions intégrées aux DAW) se distinguent par l’édition note-à-note, l’ergonomie et la stabilité en temps réel.

- Les tendances récentes renforcent l’hybridation avec la synthèse vocale et des workflows plus rapides, orientés créateurs.

Antares Audio : origines, algorithmes et bascule culturelle de l’auto-tune

L’histoire d’Antares Audio s’ancre dans un détour inattendu par la science appliquée. Andy Hildebrand, ingénieur formé à l’électronique, a travaillé sur des méthodes d’analyse pour interpréter des signaux acoustiques, notamment via des techniques proches de l’autocorrélation. Ensuite, une question lancée lors d’un dîner a servi d’étincelle : et si un système pouvait aider à chanter juste ? À partir de là, les briques mathématiques utilisées pour “lire” des signaux se sont transposées à la voix, ce qui a abouti à un outil de correction, né à la fin des années 1990 dans sa forme commercialisée.

Très vite, le plugin vocal a répondu à un problème concret : la justesse coûte du temps en studio. Avant ces outils, les séances s’allongeaient, car les prises se répétaient jusqu’à obtenir une performance sans notes “à côté”. Or, quand une voix est proche mais imparfaite, la correction ciblée permet de conserver l’énergie d’une prise. Ainsi, la production musicale gagne en efficacité, et les budgets suivent la même trajectoire. Cette logique a installé les correcteurs de hauteur dans les pratiques quotidiennes, bien au-delà des seuls genres populaires.

Cependant, un autre phénomène a fait basculer l’outil vers la culture grand public : l’effet audible, assumé, presque métallique. Sur “Believe” de Cher, sorti en 1998, des réglages extrêmes ont donné une signature immédiatement reconnaissable. Ensuite, à la fin des années 2000, T-Pain a contribué à populariser une esthétique plus robotique, surtout dans le rap. Dès lors, l’auto-tune n’était plus seulement un correcteur : il devenait un instrument. Cette transformation a aussi influencé la manière d’écrire des mélodies, car la voix pouvait “glisser” autrement, et les transitions pouvaient être volontairement cassées.

En France, la trajectoire a suivi une chronologie comparable, avec une adoption marquée dans le rap à partir de la fin des années 2000, puis une généralisation. Pourtant, le débat n’a jamais disparu. Certains y voient une normalisation de la perfection, tandis que d’autres défendent un choix esthétique, comme un filtre photo appliqué au son. D’ailleurs, la Commission d’enrichissement de la langue française a proposé une alternative terminologique : “ajustement automatique d’intonation”. Ce détail montre un point clé : quand un outil devient un fait social, son vocabulaire se politise. Et c’est précisément ce statut d’objet culturel qui prépare la question suivante : comment la technologie produit-elle ce rendu, concrètement ?

Technologies audio derrière la correction de pitch : vitesse, gamme, artefacts et contrôle

La correction de pitch s’appuie sur une idée simple en apparence : détecter la hauteur d’une voix, puis la rapprocher d’une cible musicale. Pourtant, la mise en œuvre est délicate, car la voix n’est pas une onde pure. Elle change de timbre, elle comporte du vibrato, et elle mélange des transitoires et des consonnes. Ainsi, les technologies audio d’Antares doivent arbitrer entre précision et naturel. Un réglage trop agressif peut écraser les transitions, tandis qu’un réglage trop doux laisse passer des écarts.

Un paramètre reste central : la vitesse d’ajustement. Historiquement, l’idée de régler une fenêtre allant jusqu’à plusieurs centaines de millisecondes illustre ce compromis. Plus la correction se fait vite, plus la note “se verrouille” sans glissement, ce qui produit l’effet robotique. À l’inverse, une correction plus lente respecte davantage le portamento naturel, surtout sur une voix expressive. En studio, ce curseur devient un outil de mise en scène : sur un couplet, un réglage discret peut suffire, tandis que sur un refrain, un verrouillage rapide peut devenir une texture.

Ensuite, la définition de la gamme influe sur la musicalité. Si la voix est recadrée sur une tonalité mal choisie, le résultat sonne faux, même si la justesse “mathématique” est respectée. Par conséquent, les workflows efficaces commencent par l’harmonie : identifier la tonalité, verrouiller certaines notes, puis ajuster les corrections. Un exemple courant vient d’un home-studio fictif, “Studio Mirador”, qui produit des artistes rap et pop. Quand un chanteur pose une topline sur une prod encore incomplète, la tonalité peut changer après coup. Dans ce cas, un réglage rapide au départ devient contre-productif, car il fige une direction harmonique qui n’est pas finalisée.

Il faut aussi distinguer ce traitement d’un vocodeur. Un vocodeur fonctionne avec un porteur et un modulateur, et il s’appuie sur une logique de re-synthèse liée aux formants. À l’inverse, l’auto-tune agit principalement sur la hauteur de la forme d’onde, sans reconstruire la voix de la même manière. Cette nuance explique pourquoi un rendu “métallique” n’est pas synonyme de vocoding. De la même façon, la talkbox relève encore d’un autre principe, plus acoustique et mécanique. Résultat : comprendre ces différences évite de choisir un outil inadapté au rendu visé.

Pour rendre ces options plus lisibles, de nombreux éditeurs ont adopté une interface qui ressemble à un éditeur MIDI : notes sur une grille, temps en abscisse, hauteur en ordonnée. Cette approche facilite la retouche chirurgicale après enregistrement. Pourtant, les solutions “temps réel” privilégient souvent une ergonomie plus directe, avec peu de paramètres et une latence minimale. Ce clivage studio/scène prépare naturellement le prochain sujet : quel produit choisir selon l’usage, et comment comparer Antares aux alternatives du marché ?

Comparatif 2026 : Antares face à Melodyne, Waves et solutions intégrées aux DAW

En 2026, le marché de la correction vocale est mature, donc le choix se joue sur l’ergonomie, la stabilité et la philosophie de retouche. Antares Audio conserve un avantage historique sur le temps réel, notamment pour les usages scéniques, car la simplicité de réglage et la réactivité restent des critères décisifs. Toutefois, en studio, beaucoup de producteurs apprécient des outils capables d’éditer la performance note par note, avec une granularité quasi chirurgicale. Dans cette catégorie, Melodyne s’est imposé comme référence, car l’édition détaillée donne un contrôle très fin sur la musicalité.

Waves, de son côté, a longtemps proposé une approche hybride, avec des déclinaisons pensées pour le studio et d’autres orientées temps réel. Cette segmentation répond à une contrainte simple : sur scène, chaque milliseconde compte. En revanche, en post-production, l’édition peut être plus lourde, puisqu’elle se fait hors temps réel. De nombreux DAW intègrent aussi des modules de correction de hauteur. Cela convient pour des besoins rapides, mais ces modules restent parfois limités sur les réglages avancés ou sur la robustesse dans des sessions complexes.

| Solution | Point fort typique | Usage fréquent | Limite courante |

|---|---|---|---|

| Antares Auto-Tune | Réactivité et contrôle direct de la vitesse | Temps réel, enregistrement, effets assumés | Édition ultra fine parfois moins “graphique” selon version |

| Celemony Melodyne | Édition note-à-note très détaillée | Studio, post-production, arrangement vocal | Workflow moins immédiat pour la scène |

| Waves (WaveTune, etc.) | Écosystème d’effets et intégration | Studio, chaînes d’effets audio complètes | Variabilité selon versions et configurations |

| Outils DAW intégrés | Rapidité, aucune installation additionnelle | Maquettes, correction légère | Moins d’options avancées sur certains environnements |

Pour comparer efficacement, il est utile de suivre une grille simple, orientée résultats. D’abord, la nature du projet compte : pop radio, rap, électro, voix off, podcast. Ensuite, le niveau d’intervention varie : correction invisible ou effet audible. Enfin, la compatibilité avec la session est décisive, car un plugin vocal instable peut ruiner une séance. C’est aussi là que les tests “terrain” font la différence, car un rendu propre en solo peut se dégrader dans un mix dense.

Voici une liste de critères concrets, utilisée par “Studio Mirador” pour choisir un outil selon les artistes et les délais :

- Latence mesurée sur la chaîne d’entrée, surtout si un chanteur demande un monitoring direct.

- Qualité de détection sur des voix breathy, des consonnes agressives et des lignes rapides.

- Contrôle de la tonalité et gestion des notes “hors gamme” pour éviter les corrections absurdes.

- Gestion du vibrato, car un vibrato écrasé sonne souvent plus “faux” qu’une note légèrement basse.

- Robustesse de session avec d’autres effets audio : compression, saturation, reverb, delays synchronisés.

Cette méthode évite les choix dictés par la mode. En pratique, une production rapide privilégiera souvent l’immédiateté, tandis qu’une sortie premium misera sur la retouche fine. Et comme l’optimisation ne s’arrête pas au choix du plugin, il faut maintenant regarder comment intégrer ces outils dans une chaîne cohérente, du studio à la scène.

Tests et méthodes : intégrer un plugin vocal Antares dans une chaîne de traitement du son

Un plugin vocal n’existe jamais seul. Il s’insère dans une chaîne de traitement du son, avec des choix qui influencent directement le rendu. D’abord, la question du placement se pose : correction avant ou après compression ? En général, corriger avant une compression agressive aide, car la compression amplifie les défauts. Toutefois, si la prise est très dynamique, une légère compression en amont peut stabiliser la détection de hauteur. Donc, un test A/B rapide reste la meilleure approche, surtout quand le chanteur passe du murmure au belting.

“Studio Mirador” a mis en place un protocole simple pour évaluer la stabilité. Une même voix est enregistrée sur trois phrases : une phrase legato, une phrase staccato, puis une phrase avec vibrato appuyé. Ensuite, plusieurs vitesses de correction sont essayées, de la plus naturelle à la plus extrême. L’équipe vérifie deux points : l’absence de “warble” (oscillation étrange) et la cohérence des attaques. Si les consonnes se déforment, le réglage est trop agressif, ou la détection se trompe sur des transitoires.

Ensuite, il faut penser au mix. Une correction très rapide donne un contour net, donc elle se perçoit davantage. Cela peut être recherché dans un refrain électro, car la voix traverse le mur de synthés. À l’inverse, sur une ballade, une correction plus lente préserve le naturel. L’erreur classique consiste à corriger “par principe”, puis à compenser avec de la reverb. Or, une reverb masque les défauts, mais elle masque aussi l’articulation. Ainsi, un réglage juste en amont évite des couches inutiles en aval.

Sur scène, l’équation change, car la latence et les retours dominent. Un chanteur qui s’entend en retard perd son placement rythmique. Par conséquent, la configuration doit rester légère : interface stable, tampon audio réduit, et monitoring bien géré. Dans ce contexte, l’auto-tune devient parfois un élément de performance, car l’artiste “joue” avec la correction. Cependant, il faut prévoir un plan B. Une panne au milieu d’un morceau a déjà créé des moments gênants, surtout dans des concerts rap où l’effet est central au style. Un bypass clair et une scène de secours dans le logiciel évitent une catastrophe.

Enfin, l’intégration avec d’autres technologies audio ouvre des usages hybrides. Par exemple, une voix corrigée peut alimenter un harmonizer, puis une saturation douce, et enfin une reverb courte. Ce type de chaîne produit une voix moderne, dense, sans perdre trop de diction. Le point d’équilibre se trouve dans la dose, car une correction extrême + une saturation forte peut rendre le haut-médium agressif. Quand ces choix sont maîtrisés, la technologie sert la musique, au lieu de la contraindre. Et c’est précisément là que la discussion glisse vers les outils créatifs autour de la voix, dont la synthèse vocale et les traitements de formants.

Au-delà de l’auto-tune : effets audio, synthèse vocale et tendances de production musicale

La perception publique associe souvent Antares à l’auto-tune, pourtant l’écosystème vocal moderne dépasse la seule justesse. Dans un mix actuel, la voix est fréquemment “designée” comme un lead de synthé : elle doit être stable, large, et immédiatement lisible sur smartphone. Par conséquent, la correction de hauteur n’est qu’un étage. Ensuite viennent l’égalisation dynamique, la compression multibande, la spatialisation et parfois la modulation. Cette accumulation n’a rien d’exceptionnel, car la production musicale vise un standard de densité très élevé.

Dans ce paysage, la synthèse vocale et les traitements de type resynthèse ont pris une place plus visible. Même si la correction de pitch n’est pas un vocodeur, des workflows hybrides se multiplient : une voix réelle est corrigée, puis elle est doublée par une couche synthétique, ou encore elle pilote un instrument via MIDI. L’objectif n’est pas de “tricher”, mais de créer un timbre composite. Dans l’électro, ce principe sert à obtenir des refrains massifs. Dans le rap, il sert à uniformiser la couleur sur un album, même avec des prises faites dans des environnements variés.

Les tendances récentes montrent aussi un retour du “front and center”. Autrement dit, l’effet est souvent assumé, au lieu d’être caché. Ce choix va avec une esthétique de sincérité déclarée : la performance brute n’est plus l’unique valeur. Ainsi, une voix traitée peut être considérée comme une direction artistique, au même titre qu’un grain de pellicule en vidéo. Cette évolution rejoint d’ailleurs des propos récurrents d’artistes de la scène alternative depuis la fin des années 2010, qui défendent l’idée que l’émotion se joue ailleurs que dans la perfection technique.

Pour suivre l’actualité produit, il faut aussi regarder la manière dont les éditeurs empaquettent leurs outils. Les suites vocales tendent à se regrouper, car les créateurs veulent des chaînes prêtes à l’emploi. De plus, les interfaces cherchent à réduire la friction : presets contextualisés, détection automatique de tonalité, et modes “live” simplifiés. Cela ne remplace pas l’oreille, mais cela accélère les maquettes. Dans une économie où un titre peut être publié rapidement, ce gain de temps devient stratégique, surtout pour des équipes petites.

Enfin, un aspect moins glamour persiste : la relation client et les pratiques commerciales. Certains utilisateurs ont déjà signalé des expériences problématiques auprès d’organismes de protection des consommateurs en Amérique du Nord. Même si ces sujets varient selon les périodes, ils rappellent qu’un achat logiciel n’est pas seulement un son. Il s’agit aussi d’un support, d’une politique de licence, et d’une fiabilité sur plusieurs années. L’insight à retenir est simple : une chaîne vocale moderne se construit autant avec des choix techniques qu’avec des choix d’écosystème.

Quelle différence entre auto-tune, vocodeur et talkbox ?

L’auto-tune sert surtout à la correction de pitch en agissant sur la hauteur de la voix. Un vocodeur repose sur une logique de re-synthèse avec un porteur et un modulateur, souvent un synthé et une voix. La talkbox, elle, est un dispositif physique qui façonne le son via la bouche et un tube, ce qui produit un rendu très distinct.

Comment obtenir une correction de pitch naturelle avec un plugin vocal Antares ?

Le rendu naturel vient d’une vitesse d’ajustement modérée, d’une tonalité correctement définie et d’une gestion prudente du vibrato. Ensuite, une correction légère sur les passages sensibles suffit souvent, au lieu de corriger tout uniformément. Enfin, il est utile de tester dans le mix, car une voix solo peut tromper l’oreille.

Pourquoi l’effet robotique apparaît-il si vite sur certains réglages ?

Quand la vitesse de correction est très rapide, la transition entre deux notes est supprimée. La voix “saute” alors vers la note cible, ce qui crée un contour artificiel et métallique. Cet effet est recherché dans certains styles, car il renforce l’identité sonore et la lisibilité dans un mix dense.

Faut-il choisir Antares ou une alternative comme Melodyne en studio ?

Antares est souvent privilégié pour le temps réel et les réglages directs, notamment quand la latence doit rester très basse. Melodyne est fréquemment choisi pour l’édition détaillée note par note en post-production. Le bon choix dépend du workflow : prise rapide avec monitoring, ou retouche fine et reconstruction de passages.

La synthèse vocale remplace-t-elle la voix traitée en production musicale ?

La synthèse vocale complète plus souvent qu’elle ne remplace. Une voix réelle corrigée peut servir de base, puis des couches synthétiques ajoutent texture, largeur ou harmonies. Cette approche hybride est devenue courante, car elle combine l’expressivité humaine et la précision des technologies audio modernes.