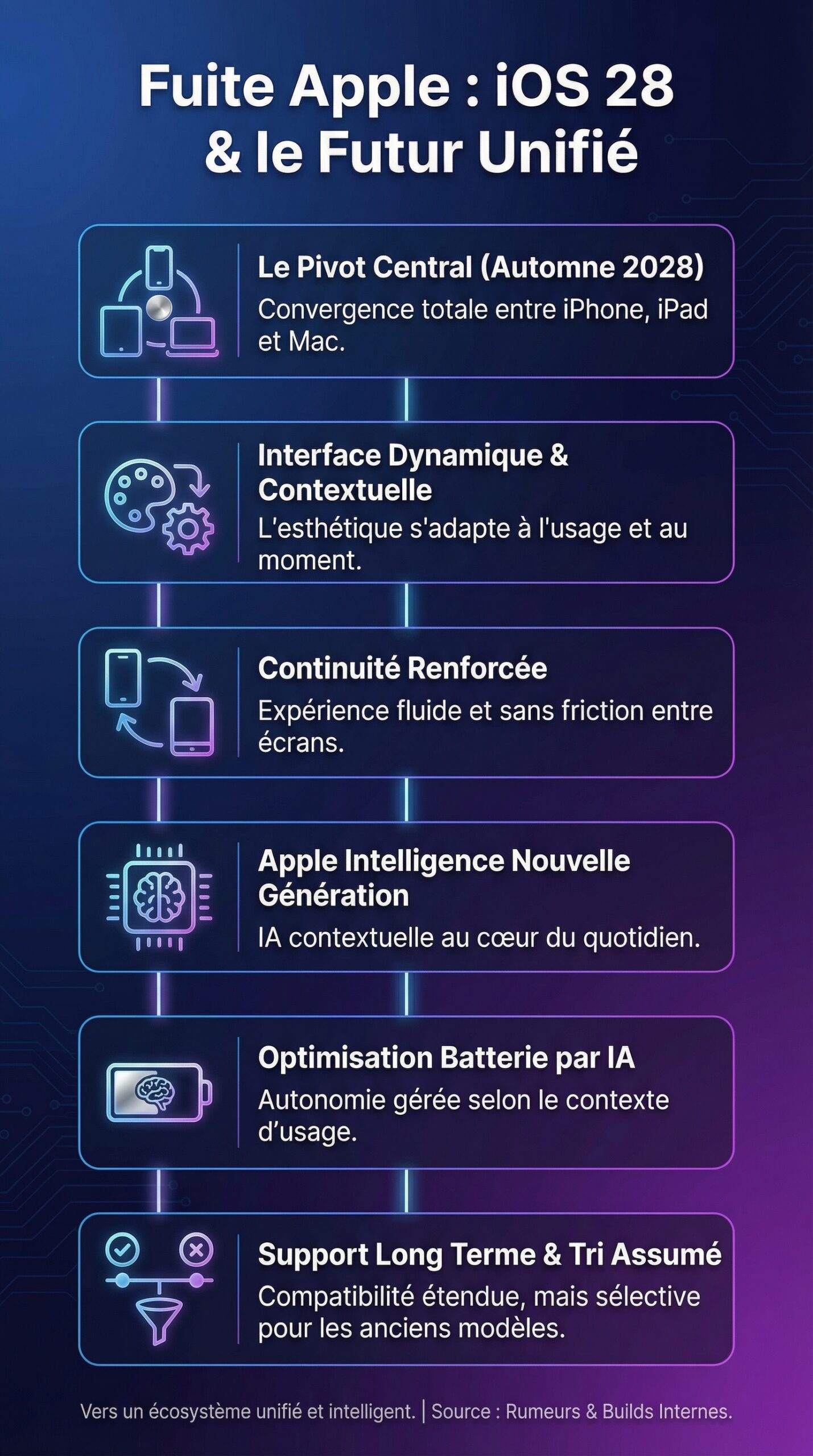

Une fuite Apple relance déjà la spéculation autour de la prochaine grande bascule chez Cupertino. D’après des éléments associés à une build interne, iOS 28 viserait une sortie à l’automne 2028 et servirait de point de convergence entre iPhone, iPad et Mac. L’idée centrale ne tient pas à une simple liste de nouveautés, mais à un changement de logique : une interface unifiée, une personnalisation dynamique à l’échelle du système et une continuité renforcée entre appareils. Dans le même temps, la feuille de route évoquée place l’IA au cœur du quotidien, avec une nouvelle étape d’Apple Intelligence et des optimisations de batterie pilotées par le contexte d’usage.

Ces indices, recoupés avec d’autres signaux produits, dessinent un Apple futur très concret : un iPhone plus “spatial”, des apps pensées pour un écosystème mixte (mobile, desktop, XR), et des innovations matérielles qui accompagnent la refonte logicielle. Au-delà des promesses, l’enjeu est simple : comment garder une expérience fluide tout en ajoutant des couches d’intelligence, de sécurité et de rendu 3D ? Et, surtout, quels compromis sur la compatibilité des anciens modèles ? Les réponses se jouent autant dans le code que dans les capteurs, et c’est précisément ce que cette fuite du logiciel Apple met en lumière.

En Bref

- iOS 28 viserait l’automne 2028 et une interface unifiée type Liquid Retina OS entre iPhone, iPad et Mac.

- La fuite Apple évoque des fonctionnalités iOS de thème dynamique et de personnalisation contextuelle à l’échelle du système.

- Compatibilité et IA : l’iPhone 11 serait écarté, et un SoC A13 ou plus récent serait requis pour les fonctions avancées d’Apple Intelligence.

- Cap sur le spatial : intégration visionOS 4, apps “visionOS-native”, Safari 3D et gestes/eye-tracking.

- Volet matériel : Face ID sous l’écran sur modèles Pro, watchOS 13 et suivi glycémique non invasif, tvOS 20 et upscaling 8K Dolby Vision.

Feuille de route iOS avancé : iOS 28 comme pivot entre iPhone, iPad et Mac

Cette fuite du logiciel Apple présente iOS 28 comme un jalon de convergence, et non comme une simple mise à jour iOS. Le marqueur le plus parlant reste la mention d’un socle d’interface unifié, souvent résumé par le terme Liquid Retina OS. Concrètement, cela signifierait une cohérence visuelle plus stricte entre iPhone, iPad et Mac, avec des composants d’interface partageant les mêmes règles d’espacement, de typographie et d’animation. Ainsi, l’utilisateur passerait d’un écran à l’autre sans “réapprendre” les gestes ou les menus.

Pour le grand public, la valeur se mesure vite : moins de friction, moins d’options cachées, et une continuité plus fiable. Pour les équipes IT, le bénéfice est aussi tangible, car un parc mixte devient plus simple à administrer. Cependant, une unification apporte aussi des tensions : l’iPhone favorise l’instantané, alors que le Mac privilégie la densité d’information. Dès lors, l’enjeu consiste à garder des interfaces adaptées, tout en conservant un langage commun.

Thème dynamique et interface contextuelle : l’esthétique devient fonctionnelle

Parmi les nouvelles fonctionnalités les plus structurantes, la personnalisation dynamique attirerait l’attention. D’après la fuite Apple, le système pourrait adapter ses visuels selon l’heure, l’orientation, ou le contexte d’usage. Un exemple simple : le matin, les contrastes favoriseraient la lisibilité, tandis que le soir, les teintes basculeraient vers une palette plus douce. Ensuite, en mode paysage, certains panneaux deviendraient latéraux pour libérer la zone centrale. Enfin, selon une activité (navigation, sport, travail), des raccourcis s’ajusteraient automatiquement.

Ce type d’adaptation peut sembler cosmétique, pourtant il modifie la productivité. Dans un scénario concret, une PME de design gère des retours clients sur iPhone pendant les déplacements, puis finalise sur iPad au bureau. Si l’interface conserve les mêmes repères, l’équipe perd moins de temps, et les erreurs diminuent. De plus, une esthétique cohérente réduit la fatigue cognitive, car l’attention reste sur le contenu.

Compatibilité et support long terme : un tri assumé côté iPhone

La même fuite du logiciel Apple souligne un point sensible : le support matériel. iOS 28 écarterait l’iPhone 11, tout en conservant un support étendu au-delà de ce seuil pour certains usages. En pratique, le message est double. D’un côté, Apple maintient une politique de suivi long, car les appareils restent utilisables. De l’autre, les fonctions les plus lourdes, notamment liées à Apple Intelligence 3.0, exigeraient un A13 ou plus récent.

Ce choix s’explique par la charge de calcul et par la sécurité. L’IA embarquée implique des traitements locaux, donc des contraintes sur le NPU, la mémoire et la bande passante. De plus, si l’objectif est de réduire les dépendances cloud, il faut renforcer le calcul sur appareil. Résultat : la stratégie semble viser moins de modèles, mais mieux optimisés. La section suivante éclaire justement l’axe IA, car il redéfinit déjà les fonctionnalités iOS attendues.

Apple Intelligence et personnalisation : les nouvelles fonctionnalités iOS guidées par le contexte

Dans cette fuite Apple, l’IA ne se résume pas à un chatbot. Au contraire, elle devient un moteur d’orchestration du système : suggestions, priorisation, et réglages automatiques. On retrouve ici la promesse d’un iOS avancé capable d’adapter l’expérience sans multiplier les menus. Cependant, le point clé reste la mesure : une IA utile doit rester prévisible. Sinon, elle devient une source de frustration.

L’approche décrite met l’accent sur l’optimisation globale : batterie, notifications, et continuité entre appareils. Ainsi, un usage intensif de photo ou de navigation pourrait déclencher un profil énergétique spécifique. Ensuite, le système réduirait certains traitements en arrière-plan. Enfin, les tâches non urgentes seraient repoussées à un moment opportun, par exemple lorsque l’iPhone est en charge.

Optimisation de batterie par “intelligence système” : gains visibles au quotidien

L’optimisation énergétique évoquée fonctionnerait comme un régisseur. D’abord, elle identifie les apps qui consomment sans apporter de valeur immédiate. Ensuite, elle limite leur activité en arrière-plan. Enfin, elle priorise les processus liés à l’usage en cours, comme la caméra ou le GPS. Cette logique convient à un public large, car elle évite les réglages manuels.

Un cas d’usage illustre l’intérêt : un livreur utilise CarPlay et la navigation pendant des heures. Or la batterie chute vite si plusieurs apps tentent de synchroniser en parallèle. Avec une optimisation plus agressive, l’autonomie se stabilise. De plus, la chauffe diminue, ce qui protège les performances à long terme. L’objectif n’est pas un record de laboratoire, mais une journée plus fiable.

Continuité iCloud et flux inter-appareils : productivité et confort

Le logiciel Apple s’appuie déjà sur iCloud et Continuity, toutefois la fuite suggère un renforcement. Par exemple, une tâche commencée sur iPhone passerait sur Mac avec l’état exact, y compris les champs, les sélections et les fichiers temporaires. Ensuite, un iPad prendrait le relais pour annoter au Pencil. Cette chaîne n’a rien de spectaculaire, mais elle a un impact direct sur la productivité.

Pour illustrer, une équipe commerciale prépare une proposition sur Mac, capture un document sur iPhone, puis annote sur iPad avant envoi. Si le transfert échoue, le processus casse. À l’inverse, si la continuité devient robuste, l’écosystème gagne une crédibilité “pro”. C’est aussi un levier de rétention, car sortir de cette fluidité coûte du temps.

Liste de points de contrôle avant d’attendre iOS 28

Pour éviter la déception, certains critères méritent d’être vérifiés dès maintenant, surtout si un renouvellement matériel est envisagé. Cette liste aide à relier technologie Apple et besoins réels, plutôt que de suivre la rumeur.

- Compatibilité : vérifier si l’iPhone actuel est au minimum sur une base A13 pour viser l’IA avancée.

- Stockage : anticiper des médias plus lourds (vidéos 4K générées, captures spatiales, caches AR).

- Usages : identifier les apps clés (photo, santé, auto, maison) qui profiteront des nouveautés.

- Sécurité : préparer la transition vers passkeys et l’abandon progressif des mots de passe.

- Écosystème : mesurer l’intérêt si un Mac, un iPad, une Apple Watch ou Apple TV est déjà utilisé.

Après l’IA, le second moteur de différenciation concerne le matériel. Les indices parlent d’un design plus épuré et de capteurs plus ambitieux, ce qui change la perception du produit au quotidien.

Innovations matérielles : Face ID sous l’écran, watchOS 13 santé, tvOS 20 et 8K

La fuite du logiciel Apple ne se limite pas au code, car elle décrit aussi des innovations matérielles qui accompagnent iOS 28. Cette logique est cohérente : une refonte d’interface et un virage vers le spatial exigent des capteurs, des écrans et des accélérateurs adaptés. Ainsi, la feuille de route mélange esthétique, santé et divertissement, tout en cherchant une cohérence d’expérience.

Le premier sujet, très attendu, concerne l’iPhone Pro. Un Face ID sous l’écran supprimerait l’encoche, tandis que la Dynamic Island évoluerait vers un module en forme de pilule, plus discret. L’objectif est double : gagner de la surface utile et clarifier l’identité visuelle. En parallèle, la sécurité biométrique resterait centrale, car Apple pousse vers un futur sans mots de passe.

iPhone Pro : Face ID sous dalle et “sensor hub” plus compact

Le Face ID sous l’écran implique une chaîne optique complexe. Il faut gérer la diffusion de la lumière, la lecture en faible transparence et la calibration. Pourtant, si Apple verrouille le rendu, le gain d’usage est immédiat : plus d’espace pour le contenu, et moins d’éléments intrusifs en vidéo ou en jeu. De plus, une Dynamic Island resserrée peut devenir un véritable sensor hub, affichant des états critiques (appel, navigation, enregistrement) avec moins de bruit visuel.

Dans un test concret, une app de montage mobile profite d’un affichage plein écran. Les contrôles deviennent plus accessibles, et l’aperçu gagne en précision. Certes, l’impact varie selon les usages, toutefois l’effet “produit premium” reste fort. Pour Apple, c’est aussi un argument clair face aux concurrents Android déjà passés à des caméras sous écran, souvent avec des compromis visibles.

watchOS 13 : suivi glycémique non invasif et santé préventive

Autre annonce majeure associée : watchOS 13 intégrerait un suivi du glucose sans piqûre, via spectroscopie optique. Le sujet est sensible, car l’exactitude et la responsabilité médicale comptent. Néanmoins, même une approche de tendance, et non de diagnostic, change l’usage. L’Apple Watch deviendrait un outil de prévention plus proactif, en croisant activité, sommeil et variations glycémiques.

Dans un exemple plausible, une personne qui ajuste son alimentation suit les variations après repas. Ensuite, l’app Santé propose des corrélations avec le sommeil ou le stress. Ce type d’insight peut motiver, car il s’appuie sur des données concrètes. Par ailleurs, l’intégration avec HealthKit facilite l’export vers un professionnel de santé, ce qui ancre l’écosystème dans le suivi réel.

tvOS 20 : upscaling 8K Dolby Vision et Apple TV comme lecteur premium

Côté salon, tvOS 20 mentionne un upscaling 8K Dolby Vision basé sur une matrice de traitement. L’enjeu, ici, est de rivaliser avec des lecteurs haut de gamme sans ajouter de boîtier. L’amélioration se voit surtout sur des contenus 4K bien encodés, car l’algorithme reconstruit les détails et limite les artefacts.

Pour un foyer équipé d’un téléviseur 8K, la différence n’est pas seulement la netteté. La fluidité perçue et la gestion du contraste comptent tout autant. En pratique, l’Apple TV gagnerait un rôle de “hub” de qualité d’image, surtout si le traitement est stable et réglable. Cette progression prépare aussi le terrain aux contenus immersifs, thème central de la section suivante.

VisionOS 4, apps spatiales et CarPlay Ultra : iOS 28 prépare le virage AR

Le volet spatial constitue le fil rouge le plus stratégique pour l’Apple futur. D’après la fuite Apple, iOS 28 intégrerait des éléments de visionOS 4 et poserait les bases d’une compatibilité avec des lunettes AR à l’horizon 2029. L’idée n’est pas de transformer l’iPhone en casque, mais de faire de l’iPhone un “contrôleur” et un point d’accès aux expériences 3D. Cette évolution peut paraître lointaine, pourtant elle s’inscrit dans une continuité : Apple prépare un langage d’interaction commun.

Dans ce cadre, des apps iPhone “visionOS-native” seraient évoquées. Le principe : une application garde sa logique métier, mais elle s’affiche et se contrôle en environnement spatial, avec des gestes et le regard. Ainsi, l’app n’est pas juste “portée”, elle est adaptée. C’est un changement important, car il impose une réflexion UX plus profonde.

Spatial Safari : web 3D, regard et gestes, et nouveaux usages

Un des exemples les plus parlants concerne Safari. Un Spatial Safari rendrait des pages en 3D, contrôlées par eye tracking et gestes. Le risque, bien sûr, est le gadget. Pourtant, certains domaines y gagnent vraiment : immobilier, formation technique, e-commerce d’objets complexes, et visites de musées.

Imaginez une page produit de vélo. Au lieu de faire défiler des photos, l’utilisateur manipule un modèle 3D, ouvre les composants, et compare des tailles. Ensuite, il bascule sur iPhone pour finaliser l’achat, sans perdre le contexte. Cette continuité renforce l’efficacité, car elle réduit le nombre d’étapes. De même, en formation, une page de maintenance industrielle peut afficher une vue éclatée d’un moteur, avec des annotations interactives.

CarPlay Ultra et affichage autonomie niveau 3 : la route comme interface mixte

CarPlay Ultra serait aussi concerné, avec un aperçu de tableaux de bord pour une autonomie de niveau 3. La fuite mentionne une intégration 180° de type fisheye, fusionnant voies réelles et voies virtuelles. Le sujet impose une prudence évidente : la voiture est un environnement critique. Néanmoins, un affichage plus riche peut améliorer la compréhension, à condition de rester lisible.

Un cas concret : sur voie rapide, l’écran combine caméras et schéma de voie simplifié. Ensuite, il met en surbrillance les trajectoires et les zones de danger. Enfin, il affiche des états de conduite assistée de façon standardisée. Cette standardisation compte, car elle réduit les surprises. C’est aussi un champ où Apple peut imposer ses règles d’interface, comme elle l’a fait sur mobile.

HomeKit Secure Video à 50 caméras : edge AI et confidentialité

La maison connectée progresse aussi, avec un HomeKit Secure Video capable de monter jusqu’à 50 caméras, en s’appuyant sur un NPU “M5” pour traiter en local. Le bénéfice est direct : moins de dépendance au cloud et une latence plus faible. La confidentialité y gagne, car les analyses restent sur l’appareil. De plus, le coût d’abonnement devient moins central si le cloud n’est plus un passage obligé.

Pour une petite entreprise ou un domicile équipé, l’exemple est simple : 12 caméras aujourd’hui, 25 demain, sans changer de plateforme. Les alertes deviennent plus fiables, car l’IA locale distingue mieux une livraison d’un intrus. Ainsi, le smart home bascule d’un gadget vers un outil, ce qui renforce l’attrait des fonctionnalités iOS liées au quotidien.

Sécurité, passkeys et outils développeurs : la face cachée du logiciel Apple jusqu’à iOS 28

Une fuite Apple crédible ne parle pas seulement d’écrans. Elle évoque aussi ce qui rend un système durable : sécurité, API, et outils. Sur ce point, iOS 28 insisterait sur un basculement vers des passkeys “universels”, avec une mise à l’écart progressive des mots de passe. Le choix est logique : les fuites de credentials restent un problème massif, et les entreprises veulent réduire le phishing. Avec un login biométrique et des clés liées au matériel, la surface d’attaque baisse.

Ce changement a un coût opérationnel, car il oblige les organisations à adapter leurs procédures. Pourtant, le bénéfice est mesurable. Un service IT passe moins de temps à réinitialiser des mots de passe. Un utilisateur subit moins de compromissions. Et, surtout, l’expérience devient plus fluide, ce qui améliore l’adhésion.

Passkeys en entreprise : du confort à la gouvernance

Dans un environnement professionnel, le défi n’est pas l’activation, mais la gouvernance. Il faut gérer le départ d’un employé, le remplacement d’un appareil et les accès temporaires. Si le logiciel Apple fournit des mécanismes d’admin clairs, l’adoption s’accélère. Sinon, les équipes contournent.

Un scénario courant aide à comprendre : une agence avec 80 employés utilise des apps SaaS. En mode mot de passe, les fuites arrivent via phishing, puis les comptes sont réutilisés. Avec des passkeys, l’attaque devient plus difficile, car l’authentification dépend du dispositif et du domaine. En parallèle, les logs de connexion deviennent plus exploitables. Le résultat est pragmatique : moins d’incidents, plus de temps pour le vrai travail.

SwiftUI unifié et RealityKit 4 : accélérer le multi-plateforme

La fuite mentionne des outils développeurs unifiés, avec SwiftUI pensé pour un rendu cohérent entre plateformes. L’objectif est clair : écrire une app, puis la décliner sur iPhone, iPad, Mac et environnement spatial. Cela ne veut pas dire “une seule UI partout”. En revanche, cela encourage une base commune, avec des adaptations locales.

RealityKit 4 irait plus loin en accélérant le développement AR, notamment via un rendu plus performant associé à Metal 5 et au raytracing. La promesse “10x” doit être comprise comme un gain de pipeline, car les outils réduisent le temps de prototypage. Pour un studio, cela change la rentabilité : tester une expérience 3D coûte moins cher, donc on itère davantage. Cette dynamique nourrit l’écosystème, car plus d’apps spatiales arrivent plus vite.

Un dernier repère sur la transition : iOS 27 et la créativité automatisée

Avant iOS 28, la feuille de route évoque iOS 27 avec des “Live Compositions” capables de créer des vidéos 4K à partir d’une consigne vocale, en mixant Photos et Musique. Ce point sert de pont : l’IA générative devient un outil créatif grand public. Ainsi, iOS 28 ne tomberait pas du ciel, car il capitalise sur des usages déjà installés.

Dans la pratique, une famille produit un montage de vacances en quelques secondes, puis l’affine. Un créateur publie un teaser en mobilité. Et une entreprise fabrique une capsule interne pour former une équipe. Ces micro-usages créent une habitude, et cette habitude justifie ensuite un système plus “spatial” et plus intégré. Quand le logiciel devient une matière vivante, le matériel suit, et l’écosystème prend de l’avance.

Quels iPhone seraient compatibles avec iOS 28 selon la fuite Apple ?

Les éléments évoquent l’abandon de la série iPhone 11. En pratique, un iPhone 12 et plus récent aurait plus de chances d’être supporté, tandis qu’un SoC A13 ou plus récent serait requis pour activer les fonctions avancées d’Apple Intelligence et certaines expériences d’interface unifiée.

Quelles fonctionnalités iOS seraient les plus visibles dans iOS 28 ?

La fuite du logiciel Apple met en avant une interface unifiée type Liquid Retina OS, un thème dynamique qui s’adapte au contexte (heure, orientation, usage) et une continuité renforcée entre iPhone, iPad et Mac. L’objectif vise une expérience plus cohérente et plus fluide au quotidien.

Les innovations matérielles liées à iOS 28 concernent-elles seulement l’iPhone ?

Non. La feuille de route évoque aussi watchOS 13 avec un suivi glycémique non invasif par spectroscopie optique, ainsi que tvOS 20 avec un upscaling 8K Dolby Vision. L’iPhone Pro, de son côté, viserait un Face ID sous l’écran et une Dynamic Island plus compacte.

Que change l’intégration visionOS 4 dans l’Apple futur ?

Elle prépare des usages spatiaux sur l’ensemble de l’écosystème : apps iPhone adaptées à l’environnement visionOS, Safari 3D contrôlé par le regard et les gestes, et une base technique compatible avec de futures lunettes AR. Cette trajectoire renforce l’idée d’un iOS avancé qui ne se limite plus à l’écran du téléphone.

Pourquoi la sécurité avec passkeys devient centrale dans iOS 28 ?

La généralisation des passkeys réduit les risques de phishing et de réutilisation de mots de passe. Pour les entreprises, cela diminue les incidents et la charge de support. Pour le grand public, cela rend l’authentification plus rapide, tout en renforçant la protection des comptes.