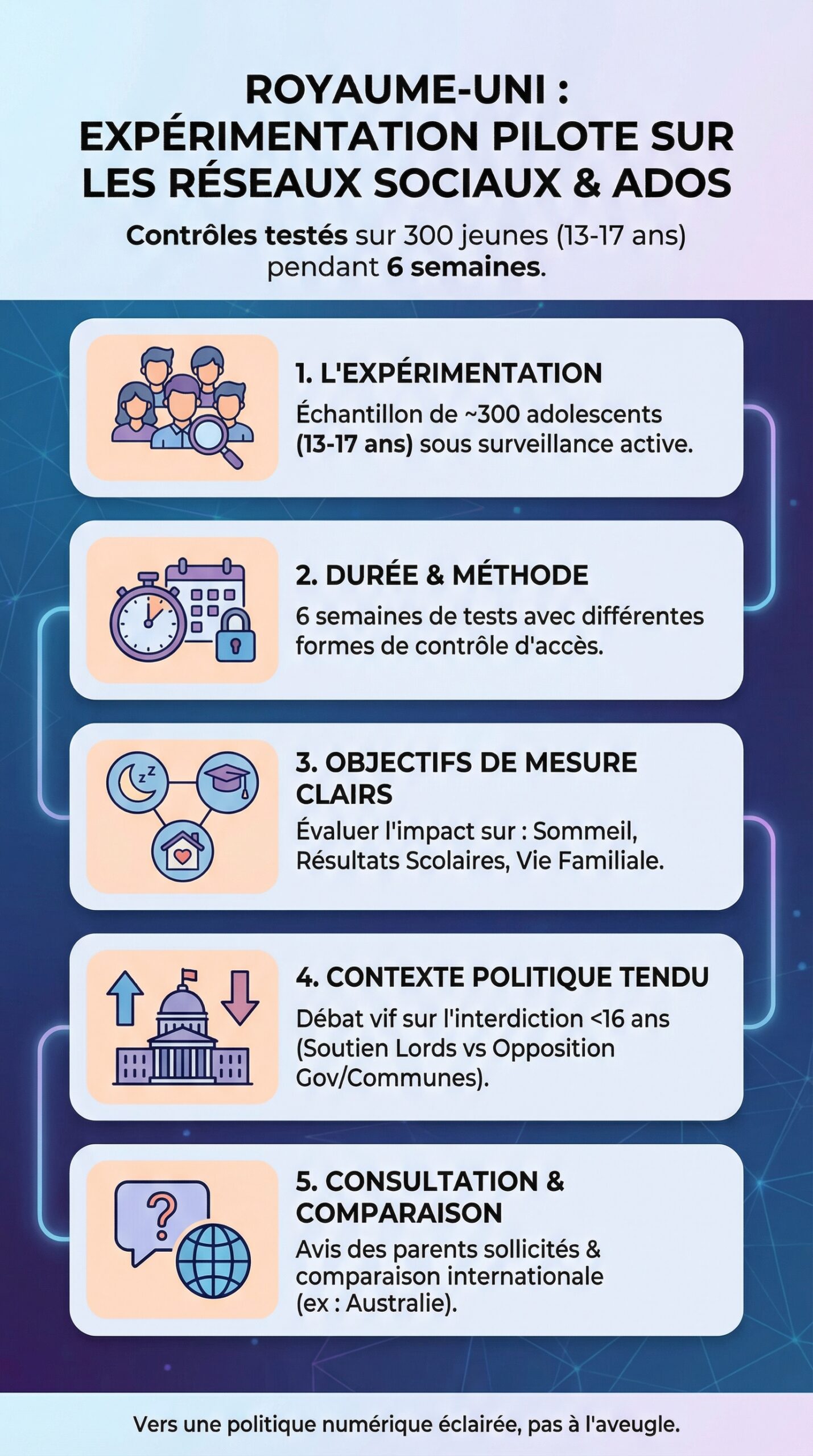

Au Royaume-Uni, un projet pilote très surveillé remet un vieux débat au centre de la politique numérique : faut-il limiter l’accès des jeunes adolescents aux réseaux sociaux, et si oui, comment le faire sans agir à l’aveugle ? Plutôt que d’annoncer une interdiction générale, le gouvernement a choisi une approche expérimentale sur un échantillon d’environ 300 adolescents âgés de 13 à 17 ans. Pendant six semaines, plusieurs formes de contrôles seront testées, avec un objectif clair : mesurer l’impact sur le sommeil, les résultats scolaires et la vie familiale. Le calendrier n’est pas neutre. Cette expérimentation arrive alors que la Chambre des Lords a, une nouvelle fois, soutenu l’idée d’une interdiction des réseaux sociaux aux moins de 16 ans, malgré l’opposition du gouvernement et le rejet par la Chambre des communes. En parallèle, la consultation publique sollicite les parents, et compare explicitement l’option britannique à des décisions prises ailleurs, comme l’Australie. Dans l’ombre de ce débat, une question technique devient centrale : quelles technologies de contrôle, de vérification d’âge et de limitation d’usage peuvent tenir face aux contournements, tout en garantissant la sécurité en ligne et la protection des mineurs sur internet ?

Le plus intéressant, côté technologie, tient au fait que ce test transforme des intuitions en métriques. Des restrictions nocturnes au blocage complet, en passant par une limite d’une heure par jour sur des applications phares, l’expérimentation promet des données comparables à un protocole de laboratoire, mais déployées dans la vraie vie. Or, dès que le contrôle sort des discours, il se frotte au hardware du quotidien : smartphones, routeurs, OS, applis et systèmes de gestion du temps d’écran. C’est aussi là que se joue la crédibilité d’une future loi : si le dispositif est trop simple, il sera contourné ; s’il est trop intrusif, il sera rejeté. Cette tension structure le débat, et elle annonce une nouvelle génération de contrôles numériques, plus “mesurés”, mais aussi plus sophistiqués.

En Bref

- Environ 300 jeunes adolescents (13-17 ans) participent à une expérimentation de restrictions pendant six semaines.

- Trois régimes sont testés : blocage total, couvre-feu nocturne ou limite d’une heure par jour, comparés à un groupe témoin en accès libre.

- Le gouvernement vise des données sur sommeil, école et vie familiale, dans un contexte de pression parlementaire sur l’interdiction.

- Le débat porte aussi sur des mécaniques comme le scrolling infini et sur la sécurité en ligne au sens large.

- Sur le plan tech, tout repose sur la vérification d’âge, la résistance aux contournements et la protection des mineurs sur internet.

Royaume-Uni : comment l’expérimentation du gouvernement structure les contrôles des réseaux sociaux

Le protocole britannique se distingue par une idée simple : au lieu d’imposer une règle unique, le gouvernement découpe l’usage en scénarios concrets, puis compare des effets. Ainsi, les 300 participants sont répartis en plusieurs groupes, afin d’isoler ce qui change réellement quand les réseaux sociaux deviennent moins accessibles. Cette approche rappelle les tests A/B utilisés en logiciel, sauf qu’ici l’objet est sociétal. Pourtant, la logique reste la même : sans groupe témoin, toute conclusion se dissout dans des impressions.

Le premier scénario est radical : désactivation complète de certaines applications. Ce choix force une question rarement posée : les adolescents remplacent-ils TikTok ou Snapchat par d’autres services, ou bien réduisent-ils vraiment leur temps d’écran ? Ensuite, un second scénario installe un accès coupé la nuit. Ce “couvre-feu” vise un point précis, car les troubles du sommeil sont souvent liés au défilement tardif. Enfin, un troisième groupe se voit imposer une limite d’une heure quotidienne sur des applis très utilisées par les jeunes adolescents, dont Instagram, TikTok et Snapchat.

Pour rendre ces contrôles crédibles, l’expérimentation doit s’appuyer sur les mécanismes natifs des systèmes d’exploitation mobiles. Sur iOS, Screen Time peut gérer des limites par app, alors que sur Android, Digital Wellbeing propose des timers et des modes “sommeil”. Toutefois, ces fonctions ne se valent pas. Certaines limites se contournent via un second compte, ou via un reset de téléphone. Par conséquent, le dispositif de test devra probablement ajouter une couche de supervision, sans transformer les appareils en machines sous surveillance permanente.

Un fil conducteur aide à comprendre les dilemmes : “Noah”, 15 ans, utilise un smartphone milieu de gamme et une tablette familiale. Si les contrôles ne sont appliqués que sur le téléphone, le temps d’écran peut migrer sur la tablette. À l’inverse, si tout est verrouillé, un effet boomerang peut surgir : l’adolescent se rabat sur des contenus web non modérés, via un navigateur. Dès lors, l’enjeu dépasse l’app. Il touche l’écosystème complet de l’internet domestique.

Cette méthode “par groupes” a un autre avantage : elle permet de relier des indicateurs, comme les notes ou les horaires de coucher, à un type de restriction. Cependant, les mesures doivent rester comparables. Si un foyer utilise un routeur avec contrôle parental avancé, tandis qu’un autre n’a rien, la qualité de l’application des contrôles varie. L’expérimentation devra donc documenter l’équipement, ce qui ouvre une piste passionnante : la politique numérique se met à dépendre du hardware réel des familles. Une loi future devra tenir compte de cette diversité, sinon elle produira des inégalités d’exécution.

À mesure que le débat avance, la section suivante élargit le zoom : qu’observe-t-on réellement sur le sommeil, l’école et la vie familiale quand les réseaux sociaux deviennent moins présents ?

Contrôles, sommeil et école : ce que le test sur 300 jeunes adolescents peut mesurer sur internet

La promesse politique du projet pilote est de produire des résultats lisibles : sommeil plus long, concentration accrue, conflits familiaux en baisse. Pourtant, ces indicateurs sont délicats, car ils varient avec la période scolaire, l’anxiété, ou même la météo. Pour limiter ces biais, l’expérimentation sur six semaines devra suivre des routines stables, et surtout comparer chaque groupe au groupe témoin. Sans cela, toute “amélioration” peut venir d’un simple changement de rythme.

Le sommeil est un terrain concret. D’un côté, la lumière bleue tardive perturbe l’endormissement. De l’autre, l’excitation cognitive liée au scrolling maintient le cerveau en alerte. Un couvre-feu nocturne peut donc agir sur deux leviers. Cependant, si l’adolescent remplace TikTok par YouTube, l’effet se dilue. C’est pourquoi un suivi par catégories d’usage, et pas seulement par application, devient essentiel pour évaluer l’impact réel sur internet.

Sur la réussite scolaire, la mécanique est différente. Une limite d’une heure par jour peut réduire la procrastination, surtout avant les devoirs. Néanmoins, des réseaux sociaux servent aussi à partager des cours, ou à organiser un travail de groupe. Ainsi, la restriction peut avoir des effets opposés selon les profils. Prenons “Maya”, 16 ans, qui suit une option sciences. Elle utilise des groupes Snapchat pour échanger des exercices. Si l’accès est coupé trop tôt, elle perd une coordination utile. À l’inverse, si l’usage déborde, la soirée s’évapore. L’expérimentation doit donc distinguer usage social récréatif et usage de coordination.

La vie familiale, elle, se mesure moins facilement, mais elle se ressent vite. Lorsque les contrôles sont imposés sans explication, ils déclenchent un jeu du chat et de la souris. En revanche, quand la règle est coconstruite, le climat s’apaise souvent. Ici, la consultation parentale prévue par le gouvernement compte autant que le test. Elle peut documenter le ressenti, les disputes, ou au contraire le regain d’activités hors écran. Cela dit, un protocole sérieux doit aussi noter les effets secondaires, comme l’augmentation du temps de jeu vidéo, ou la migration vers des messageries chiffrées.

Pour éviter de se perdre, un cadre d’observation simple aide. Voici des points typiques que des familles peuvent relever pendant l’expérimentation, afin de lier ressenti et données :

- Heure de coucher et durée estimée d’endormissement, avant et après les contrôles.

- Temps d’écran total par catégorie (réseaux sociaux, vidéo, jeux, navigation web).

- Qualité des devoirs : devoirs rendus à l’heure, révisions, distractions.

- Moments de tension : négociations, contournements, sanctions, dialogues.

- Activités de remplacement : sport, lecture, sorties, musique, sommeil récupéré.

Au fond, ce test peut surtout répondre à une question pragmatique : quel type de contrôle produit un bénéfice net sans déclencher une guerre domestique ? La suite du sujet bascule alors vers le champ législatif : quand l’expérimentation nourrit la loi, quels arbitrages politiques deviennent possibles au Royaume-Uni ?

Cette séquence vidéo aide à comprendre pourquoi les votes répétés à la Chambre des Lords renforcent la pression, même quand le gouvernement temporise. Elle met aussi en perspective le rôle de la consultation et du calendrier parlementaire.

Politique numérique au Royaume-Uni : consultation, pression parlementaire et protection des mineurs

Le contexte politique explique la forme du test. La Chambre des Lords a soutenu, à deux reprises, un amendement visant l’interdiction des réseaux sociaux aux moins de 16 ans. Pourtant, la Chambre des communes, dominée par les travaillistes, a rejeté l’amendement à un moment clé. Ce va-et-vient, souvent décrit comme un ping-pong parlementaire, place le gouvernement face à un dilemme : agir vite, ou produire d’abord des preuves. En choisissant une expérimentation, l’exécutif tente de gagner du temps tout en renforçant sa légitimité.

La consultation parentale joue un rôle stratégique. D’abord, elle mesure l’acceptabilité sociale d’une interdiction “à l’australienne”. Ensuite, elle identifie les attentes concrètes : interdiction totale, limites d’âge, ou encadrement des fonctionnalités addictives. Ce dernier point compte, car il sort du débat binaire. Interdire une plateforme est une chose. Forcer la modification du scrolling infini, de l’autoplay, ou des notifications en est une autre, souvent plus technique, mais potentiellement plus efficace.

En toile de fond, la sécurité en ligne ne se limite pas au temps passé. Elle couvre aussi l’exposition à des contenus inadaptés, le harcèlement, ou les contacts avec des inconnus. Or, une interdiction d’âge ne règle pas tout, car des comptes “adultes” peuvent être créés facilement. Ainsi, la protection des mineurs dépend d’une chaîne complète : vérification d’âge, modération, et dispositifs de signalement réactifs. Si l’un des maillons casse, la loi devient symbolique.

Il devient donc utile de comparer les options de politique numérique, non pas en slogans, mais en impacts et contraintes. Le tableau ci-dessous synthétise les modèles souvent évoqués dans le débat, en les ramenant à des critères concrets pour internet et les familles.

| Option de régulation | Principe | Avantages attendus | Risques et contournements |

|---|---|---|---|

| Interdiction par âge (ex. -16) | Accès bloqué aux réseaux sociaux sous un seuil | Signal politique fort, simplicité du message | Faux âges, comptes empruntés, migration vers services moins visibles |

| Contrôles de temps (quota quotidien) | Limite d’usage par application ou catégorie | Réduit l’excès sans couper totalement | Multi-appareils, second téléphone, resets et VPN selon les systèmes |

| Couvre-feu nocturne | Blocage sur une plage horaire | Vise le sommeil et les usages tardifs | Visionnage via web, plateformes vidéo, Wi-Fi voisin |

| Régulation des fonctionnalités | Limiter autoplay, notifications, scrolling infini | Moins d’addiction, bénéfices transverses | Définition légale complexe, mesures hétérogènes par plateforme |

À ce stade, la pression publique se nourrit aussi de voix médiatiques, y compris d’acteurs et de personnalités, qui affirment que les parents ne peuvent pas lutter seuls. Toutefois, des experts rappellent que des restrictions se contournent, surtout si les plateformes ne renforcent pas le contrôle du contenu. La question qui suit devient alors très “tech” : quelles briques matérielles et logicielles rendent les contrôles réellement applicables au quotidien ?

Hardware, apps et vérification d’âge : la face technique des contrôles des réseaux sociaux

Dès qu’une règle sort du Parlement, elle doit vivre sur des appareils. Or, la majorité des jeunes adolescents naviguent entre smartphone, tablette, PC de l’école, et parfois une console. Par conséquent, un contrôle centré sur une seule application manque sa cible. L’expérimentation britannique, si elle veut produire des conclusions utiles, doit analyser les architectures de contrôle existantes, et leurs limites très concrètes.

Premier étage : les outils du système. Sur mobile, les “time limits” fonctionnent bien tant que l’adolescent ne contrôle pas le compte administrateur. Cependant, l’hétérogénéité Android complique tout. Des surcouches constructeur peuvent casser certaines options, ou les rendre plus faciles à désactiver. Sur ordinateur, Windows et macOS offrent des comptes enfants, mais beaucoup de familles n’activent pas ces profils. En pratique, la facilité d’usage décide du taux d’adoption, donc de l’efficacité moyenne.

Deuxième étage : le réseau domestique. Un routeur moderne peut bloquer des domaines, imposer des horaires, ou forcer un DNS filtrant. Pourtant, ces mesures ont un angle mort : la 4G/5G. Dès que le smartphone bascule sur le réseau cellulaire, le contrôle Wi‑Fi disparaît. Ainsi, un dispositif sérieux combine souvent réseau + appareil, ce qui augmente la complexité. Les familles équipées d’un routeur avancé et d’un forfait data généreux ne vivent pas la même réalité que celles avec un Wi‑Fi unique et des mobiles d’entrée de gamme.

Troisième étage : la vérification d’âge. C’est le point le plus sensible pour la protection des mineurs, car il touche à l’identité. Plusieurs méthodes existent : estimation d’âge par document, confirmation par banque, ou analyse biométrique. Toutefois, chacune a un coût social et technique. L’analyse faciale, par exemple, pose des questions de stockage et de biais. À l’inverse, le contrôle par document peut exclure des familles sans papiers faciles à fournir. Ainsi, la politique numérique doit arbitrer entre robustesse et proportionnalité.

Dans le test britannique, les contournements seront un signal précieux. Si beaucoup d’adolescents utilisent un VPN, cela indique un problème de conception, pas seulement de discipline. De même, si l’usage migre vers des plateformes moins connues, le débat change : le risque n’est plus “Instagram”, mais l’ombre d’un internet plus difficile à modérer. C’est là qu’un gouvernement peut décider de réguler des mécanismes (notifications, recommandations) plutôt que des marques.

Pour rendre ce débat tangible, un exemple d’atelier familial fonctionne bien. Le parent active un quota d’une heure. L’adolescent accepte, mais demande un “joker” pour les jours d’examen. Techniquement, cela implique une règle dynamique, et donc une UI claire. Si l’interface est opaque, la négociation se transforme en conflit. À l’inverse, un contrôle bien conçu devient un outil de dialogue. Cette nuance est souvent absente des débats publics, alors qu’elle conditionne la réussite sur le terrain.

Le prochain angle complète le tableau : au-delà des contrôles, quelles obligations pèsent sur les plateformes, et quels signaux techniques peuvent réellement améliorer la sécurité en ligne ?

Cette vidéo permet de situer les technologies de vérification d’âge, leurs promesses et leurs limites. Elle éclaire aussi pourquoi une interdiction théorique peut échouer si les mécanismes de preuve d’âge restent fragiles.

Sécurité en ligne et plateformes : du scrolling infini aux obligations de modération sur internet

Limiter le temps passé ne suffit pas toujours, car l’architecture des réseaux sociaux vise l’engagement maximal. Le scrolling infini en est l’exemple le plus visible : il supprime les points d’arrêt naturels, donc il retarde la décision de fermer l’app. Dans une optique de sécurité en ligne, le problème ne tient pas seulement au contenu, mais à la manière dont il est servi. Ainsi, réguler des fonctionnalités peut produire des effets plus larges qu’une interdiction par âge, surtout si les adolescents migrent d’une app à l’autre.

Un autre levier est la conception des notifications. Quand une plateforme envoie des alertes fréquentes, elle capte l’attention même hors de l’application. De plus, les boucles de récompense (likes, streaks, suggestions) renforcent une présence continue. Si l’expérimentation britannique observe que la limite d’une heure provoque une forte anxiété, il faudra regarder ces mécaniques. Sinon, la politique numérique s’attaque aux symptômes, pas aux causes.

La modération, elle, reste le pilier de la protection des mineurs. Même avec des contrôles stricts, un adolescent peut être exposé à du contenu violent, sexualisé, ou à des défis dangereux, dès qu’il a accès. Les obligations imposées aux plateformes incluent souvent des délais de retrait, des outils de signalement, et des paramètres par défaut plus protecteurs. Cependant, la modération à grande échelle repose sur des systèmes hybrides : IA de tri, équipes humaines, et règles internes. Or, les erreurs existent, et les faux positifs frustrent les utilisateurs.

Pour relier technologie et politique, il est utile de raisonner en “frottements” : chaque étape qui ralentit un comportement à risque peut réduire l’exposition. Par exemple, imposer un compte privé par défaut pour les jeunes adolescents diminue les contacts inconnus. De même, réduire la viralité des messages provenant de comptes non suivis peut limiter le harcèlement opportuniste. Enfin, afficher des pauses obligatoires après un certain temps de défilement peut créer un point d’arrêt. Ces mesures ne remplacent pas les contrôles, mais elles les rendent moins indispensables.

Un cas d’école illustre l’idée. “Noah” reçoit un message d’un inconnu après avoir commenté une vidéo. Si la plateforme impose un filtre “inconnu” et un avertissement clair, l’échange peut s’arrêter là. À l’inverse, si l’interface pousse à répondre, le risque grimpe. La sécurité en ligne dépend donc autant des choix d’UX que des lois. D’où l’intérêt d’une expérimentation : elle peut montrer si le bénéfice provient du temps réduit, ou du simple fait de rompre la compulsion.

À mesure que les résultats arriveront, le débat britannique devra trancher : renforcer les contrôles côté famille, ou déplacer la responsabilité vers les plateformes. Quoi qu’il en soit, les données issues de six semaines peuvent servir de boussole, à condition d’être transparentes et comparables. Le dernier bloc ci-dessous répond aux questions pratiques qui reviennent le plus souvent, surtout chez les parents et les équipes IT scolaires.

Quels types de contrôles sont testés par le gouvernement au Royaume-Uni sur les réseaux sociaux ?

L’expérimentation répartit environ 300 jeunes adolescents (13-17 ans) en plusieurs groupes pendant six semaines : certains subissent un blocage complet des applications de réseaux sociaux, d’autres un accès interdit la nuit, et un autre groupe une limite d’environ une heure par jour sur des apps populaires. Un groupe témoin conserve un accès illimité pour comparer les effets.

Pourquoi un couvre-feu nocturne peut avoir plus d’effet qu’une simple limite de temps ?

Le couvre-feu cible les usages tardifs, souvent associés au scrolling infini, aux notifications et à la perte de sommeil. Même si une limite quotidienne réduit l’excès, elle peut être consommée le soir. En revanche, une coupure sur une plage horaire vise directement l’endormissement et la récupération, ce qui influe aussi sur l’école et l’humeur.

Ces restrictions sont-elles faciles à contourner sur internet ?

Oui, certains contournements existent : utilisation de plusieurs appareils, passage du Wi‑Fi à la 4G/5G, création de comptes avec un âge fictif, ou usage d’un VPN selon le contexte. Justement, l’intérêt du test est d’observer ces stratégies, afin d’évaluer quels contrôles résistent vraiment dans la vie quotidienne.

Quelle différence entre interdiction par âge et régulation des fonctionnalités comme le scrolling ?

L’interdiction par âge vise l’accès aux plateformes, donc elle dépend fortement d’une vérification d’âge robuste. La régulation des fonctionnalités agit sur les mécanismes addictifs (défilement infini, autoplay, notifications), ce qui peut réduire l’usage excessif même chez les utilisateurs autorisés. Les deux approches peuvent se compléter dans une politique numérique centrée sur la protection des mineurs.

Quelles mesures simples peuvent améliorer la sécurité en ligne sans tout interdire ?

Des réglages par défaut plus protecteurs aident beaucoup : compte privé pour les mineurs, limitation des messages d’inconnus, outils de signalement visibles, et pauses après une longue session. Côté matériel, des profils enfants sur iOS/Android et un contrôle parental cohérent sur tous les appareils réduisent l’écart entre la règle et la réalité.