En Bref

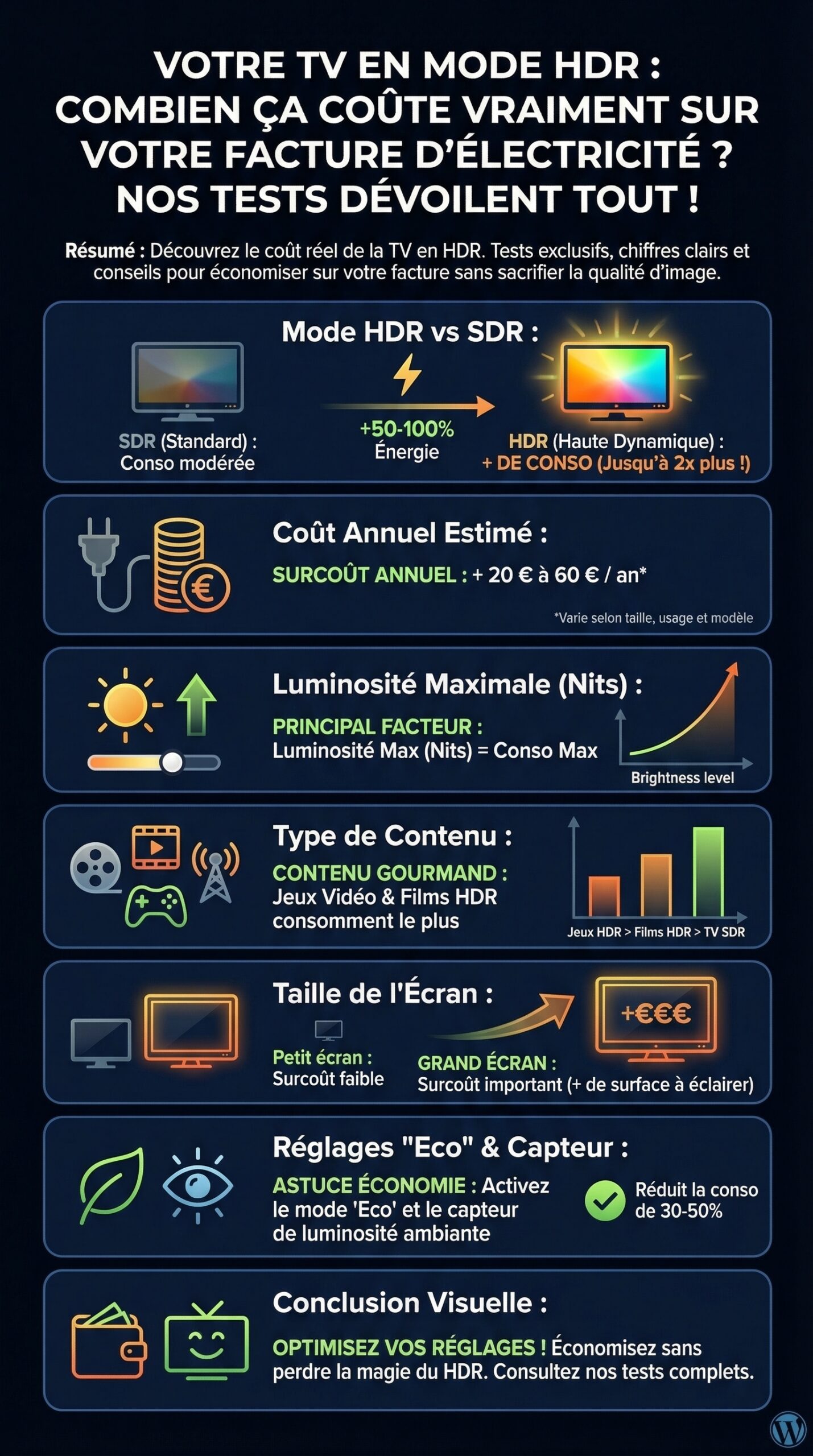

- Le mode HDR augmente souvent la luminosité et peut donc faire grimper la consommation énergétique, mais l’impact réel dépend surtout de la technologie d’écran.

- Sur un test TV HDR en conditions proches du quotidien, un Mini-Led peut consommer plus du double d’un Oled sur le même film HDR.

- À l’année, l’écart sur la facture d’électricité reste souvent modeste (quelques euros à une vingtaine d’euros), même si l’usage est intensif.

- Les réglages (Dolby Vision lumineux, capteur de lumière, rétroéclairage) pèsent presque autant que la dalle sur le coût électrique.

- Des gestes simples d’économie d’énergie réduisent la dépense sans “casser” l’expérience HDR, surtout sur les appareils électroniques connectés au salon.

Le HDR a changé la perception du “beau” sur une TV. Les reflets dans une scène nocturne, les flammes d’une explosion, ou la lumière d’un soleil rasant gagnent en relief, parfois au point d’éclipser la différence entre une bonne et une excellente calibration. Pourtant, derrière cette claque visuelle, une question revient avec insistance dans les salons: combien coûte réellement ce supplément de dynamique sur la facture d’électricité, une fois les soirées Netflix et les week-ends cinéma additionnés?

Pour sortir des idées reçues, des mesures concrètes aident à remettre les compteurs à l’heure. Deux téléviseurs 65 pouces récents, l’un en Oled et l’autre en Mini-Led, ont été mis face à un scénario identique, avec un film HDR connu et des réglages comparables. Les chiffres obtenus donnent un ordre de grandeur crédible du coût électrique d’un usage HDR. Ils montrent aussi, et c’est plus intéressant encore, que la technologie d’affichage et la stratégie de luminosité font toute la différence dans la consommation énergétique.

Test TV HDR en conditions réelles : protocole de mesure, réglages et pièges à éviter

Mesurer la consommation énergétique d’une TV en mode HDR n’a rien d’un exercice académique. Les scènes varient, les algorithmes adaptent l’image, et même la luminosité d’une pièce peut influencer le rendu. Pour obtenir un résultat utile, un protocole réaliste doit cadrer les variables, tout en restant proche d’un usage domestique. C’est exactement l’idée d’un test TV HDR basé sur un long-métrage HDR diffusé en streaming.

Dans un scénario représentatif, un film de 1 h 55 sert de “banc d’essai”. Le choix d’un titre populaire, avec des passages sombres et des pics lumineux, permet d’exposer la TV aux cas difficiles du HDR. Ensuite, le réglage “Dolby Vision lumineux” est appliqué sur les deux écrans. Ainsi, l’image reste flatteuse, ce qui correspond aux habitudes de nombreux utilisateurs. Toutefois, les aides automatiques liées à la lumière ambiante sont désactivées. Sinon, la TV réduirait sa luminance en soirée et gonflerait en journée, ce qui brouillerait la mesure.

Pourquoi rejouer le même film HDR deux fois change tout

Un film HDR ne sollicite pas la TV de façon stable. Or, un compteur de consommation peut réagir à des micro-variations, notamment lors des changements de scènes et des transitions. En rejouant le même contenu deux fois, la cohérence des valeurs devient vérifiable. Si les deux passages produisent des résultats proches, le protocole gagne en crédibilité. Dans le cas contraire, il faut traquer un facteur caché, comme une mise à jour, un économiseur ou une adaptation dynamique.

Un exemple concret illustre bien ce point. Dans certains salons, une TV détecte un contenu “statique” et baisse la luminosité au bout de quelques minutes. En HDR, cette baisse peut être subtile à l’œil, mais nette sur le compteur. Par conséquent, un second passage permet de repérer ces comportements et d’éviter de conclure trop vite sur le coût électrique.

Éléments qui faussent la consommation : Ambilight, capteurs et options “boost”

Certains modèles ajoutent des systèmes annexes. Un éclairage d’ambiance intégré, par exemple, consomme de l’énergie en plus. Ainsi, pour comparer Oled et Mini-Led, mieux vaut neutraliser ces fonctions. La comparaison reste alors centrée sur la dalle et sur la gestion de la lumière. De même, les options “contraste dynamique”, “boost HDR” ou “luminosité maximale” peuvent changer la donne. Elles poussent les pics lumineux, donc elles augmentent la consommation énergétique.

Pour garder une logique simple, il est utile de noter noir sur blanc les réglages. Ensuite, une règle pratique s’impose: si un paramètre existe sur une seule marque, il doit être désactivé. On obtient alors un test plus “universel”. Cette discipline évite aussi une frustration fréquente: découvrir après coup que la facture d’électricité a été impactée par un gadget, pas par le HDR lui-même. Le point clé, ici, est clair: un test TV HDR fiable commence par une configuration reproductible.

Oled vs Mini-Led en mode HDR : ce que les mesures révèlent sur la consommation énergétique

Deux technologies dominent le haut de gamme grand public: l’Oled et le Mini-Led. Sur le papier, les deux promettent des pics lumineux élevés en HDR, une gestion fine des contrastes, et une expérience cinéma. Pourtant, leur façon de produire la lumière diffère radicalement. Et cette différence se traduit souvent, assez directement, sur le compteur d’énergie.

Côté Oled, chaque pixel émet sa propre lumière. Donc, une zone sombre peut littéralement s’éteindre. Résultat: la consommation énergétique baisse fortement dès que l’image contient beaucoup de noir. Côté Mini-Led, la lumière vient d’un rétroéclairage puissant, découpé en zones. Même si le local dimming est performant, des zones doivent rester actives pour éclairer l’image. En HDR, lorsqu’un film alterne scènes sombres et éclats lumineux, le rétroéclairage peut monter haut et souvent.

Chiffres de test : un film HDR, deux TV 65 pouces, deux mondes

Sur un long-métrage HDR de 1 h 55, une TV Mini-Led 65 pouces a mesuré environ 438 Wh consommés, tandis qu’une TV Oled 65 pouces s’est située autour de 180 Wh, avec des réglages proches en Dolby Vision lumineux. L’écart est massif sur ce scénario précis. De plus, il donne une intuition simple: le HDR coûte plus cher quand la TV doit produire beaucoup de lumière “de fond”.

Un détail technique aide à comprendre. Une dalle Oled récente, avec une architecture orientée rendement, peut dépasser les 2000 cd/m² sur certains pics HDR, tout en gardant un contrôle pixel par pixel. En face, un Mini-Led peut grimper au-delà de 3200 cd/m² lors des pics. Cependant, ces records se payent. Plus la crête lumineuse est haute, plus l’alimentation et le rétroéclairage doivent travailler. Et donc, plus l’énergie part en chaleur.

Ce que ces résultats ne disent pas, et ce qu’ils suggèrent quand même

Un test, même sérieux, ne transforme pas une tendance en loi universelle. Les fabricants optimisent différemment leurs blocs d’alimentation, leurs algorithmes, et leurs modes d’image. Ainsi, un Mini-Led bien réglé peut se montrer moins gourmand qu’un Mini-Led “débridé”. De la même façon, un Oled en mode Vif peut grimper. Néanmoins, l’architecture de base reste déterminante.

Pour rendre la comparaison plus exploitable, un tableau synthétise les mesures du scénario “film HDR identique”. Il ne remplace pas une base de données, mais il fixe une référence claire. Et surtout, il aide à relier le HDR à une notion concrète: le coût électrique par séance.

| Élément mesuré | TV Oled 65″ (type Philips OLED haut de gamme) | TV Mini-Led 65″ (type TCL C89K) |

|---|---|---|

| Mode d’image | Dolby Vision lumineux | Dolby Vision lumineux |

| Durée du film HDR | 1 h 55 | 1 h 55 |

| Énergie consommée sur le film | 180 Wh | 438 Wh |

| Lecture répétée pour contrôle | 2 passages, valeurs cohérentes | 2 passages, valeurs cohérentes |

| Pic lumineux HDR (ordre de grandeur) | > 2000 cd/m² | > 3200 cd/m² |

La suite logique consiste à transformer ces Wh en euros. Après tout, la facture d’électricité ne parle pas en luminance, mais en kWh. Et c’est là que les surprises arrivent, car l’écart technique ne se traduit pas toujours par une catastrophe budgétaire. Le prochain volet met donc des prix sur ces mesures, sans perdre de vue l’usage réel.

Facture d’électricité : calcul du coût électrique annuel du HDR selon l’usage (2 h/jour vs 4 h/semaine)

Le passage des Wh au coût électrique est simple, mais il faut poser des hypothèses. Le tarif du kWh varie selon le contrat, les options heures pleines/creuses, et la région. Pour rester concret, un prix autour de 0,194 €/kWh donne une base cohérente avec des offres résidentielles courantes. Ensuite, l’usage doit être défini, car personne ne regarde “un test” toute l’année. Deux scénarios parlent à presque tout le monde: le rythme quotidien et le rythme week-end.

Premier scénario: environ 2 h de HDR par jour, soit l’équivalent d’un film ou de deux épisodes premium. Avec les mesures précédentes, une TV Mini-Led dans ce profil approche 160 kWh/an, ce qui représente environ 31 €/an. De son côté, une TV Oled tourne autour de 66 kWh/an, soit environ 13 €/an. L’écart dépasse donc la vingtaine d’euros. Pourtant, ce n’est pas un gouffre, surtout face au prix d’achat d’une TV premium.

Deuxième scénario: 4 h de HDR par semaine, par exemple deux films le week-end. Dans ce cas, la TV Mini-Led arrive à environ 14 kWh/an, soit un peu moins de 3 €. L’Oled descend vers 5,8 kWh/an, donc un peu plus d’1 €. La différence existe, cependant elle devient presque symbolique à l’échelle d’un an. Alors, faut-il arrêter le HDR pour faire des économies d’énergie? La réponse est rarement oui, car l’usage réel amortit l’écart.

Cas pratique : un foyer qui alterne streaming HDR, sport et console

Pour illustrer, imaginons un foyer “typique” avec une TV principale au salon. La semaine, le streaming HDR tourne surtout le soir, mais le reste du temps, il y a du sport en SDR, des infos, et une console. Dans ce mix, la part HDR n’est pas de 100%. Donc, le coût électrique réel sera inférieur au scénario “2 h de HDR par jour” si la consommation HDR n’est pas permanente.

En revanche, un gamer qui active le HDR systématiquement sur console peut se rapprocher du scénario intensif. De plus, certains jeux affichent de grandes zones lumineuses et des interfaces très claires. Or, ces images poussent la luminosité globale. Ainsi, la consommation énergétique peut grimper, surtout sur Mini-Led. Ce point compte, car le jeu s’étire souvent au-delà d’un film.

Repères utiles pour convertir une séance HDR en euros

Le cerveau retient mieux un coût “par séance” qu’un coût annuel. Il est donc utile d’avoir des ordres de grandeur. Avec un film de 1 h 55, on parle d’environ 0,18 kWh sur une TV Oled et 0,438 kWh sur une TV Mini-Led, dans les conditions du test. Multipliés par le prix du kWh, cela donne quelques centimes à moins de dix centimes, selon la TV et le tarif.

Cette conversion aide à remettre en perspective une peur courante: “le HDR va exploser la facture d’électricité”. En réalité, la hausse existe, mais elle reste souvent contenue. En revanche, sur plusieurs appareils électroniques cumulés, les centimes deviennent des euros. Il faut donc regarder le salon comme un système complet, pas comme un seul écran. C’est justement le terrain du prochain angle: comment réduire la dépense sans renoncer à l’image HDR.

Réglages et bonnes pratiques d’économie d’énergie sans sacrifier l’expérience HDR

Le HDR n’est pas un interrupteur binaire entre “beau” et “économe”. Il existe une zone de réglages intelligents où l’image reste spectaculaire, tandis que la consommation énergétique recule. Le plus important consiste à comprendre quels paramètres coûtent réellement de l’énergie. Ensuite, des ajustements simples permettent de réduire le coût électrique, surtout sur les TV très lumineuses.

Le premier levier est le mode d’image. Un profil “Vif” ou “Dynamique” pousse souvent la luminosité moyenne, pas seulement les pics HDR. Or, c’est la luminosité moyenne qui fait tourner le compteur sur la durée. À la place, un mode cinéma bien calibré conserve les pics quand ils sont utiles, tout en évitant de sur-éclairer les scènes normales. De plus, certains modes “Filmmaker” ou “Cinéma maison” limitent les traitements énergivores.

Checklist réglages : réduire la conso en mode HDR, étape par étape

- Réduire la luminosité OLED ou le niveau de rétroéclairage Mini-Led d’un cran ou deux, puis vérifier si les pics HDR restent satisfaisants.

- Activer une limitation de luminance automatique quand elle est bien implémentée, surtout en journée, car elle évite les excès inutiles.

- Désactiver les options “contraste dynamique extrême” et les “boost” qui gonflent l’APL, donc la consommation énergétique.

- Couper les fonctions décoratives gourmandes si elles existent, comme certains éclairages d’ambiance, afin de garder l’énergie pour l’écran.

- Régler une mise en veille rapide et éviter les modes “veille réseau” trop permissifs, car une TV connectée reste un appareil électronique actif.

Ces actions fonctionnent parce qu’elles ciblent la source de dépense: la production de lumière. Et comme le HDR repose sur le contraste perçu, un petit recul de luminance peut rester invisible. En clair, l’œil s’adapte vite, mais le compteur, lui, ne s’adapte jamais.

Pourquoi la pièce compte autant que la technologie de la dalle

Un salon très lumineux pousse naturellement à monter la luminance. À l’inverse, une pièce tamisée permet de profiter du HDR avec une luminosité moyenne plus basse. Ainsi, un simple rideau occultant ou un éclairage indirect peut contribuer à une économie d’énergie, sans toucher aux réglages. Cela paraît trivial, pourtant l’impact est immédiat, car le besoin de “pousser” l’écran diminue.

Une anecdote revient souvent dans les tests terrain. Une TV réglée en magasin paraît fade à la maison si la pièce est plus sombre, car le mode démo était agressif. Après quelques jours, un ajustement vers un mode cinéma rend l’image plus naturelle. Et, au passage, la consommation énergétique baisse. Cet effet “double gain” est rare en tech, donc il vaut la peine d’être exploité.

Le HDR et les autres appareils électroniques : la somme des petits postes

Une TV n’est pas seule. Une barre de son, une box, une console, un ampli, et parfois un lecteur Blu-ray s’additionnent. Or, ces appareils électroniques consomment souvent en veille, surtout s’ils restent connectés pour des mises à jour. Par conséquent, optimiser la TV tout en laissant cinq boîtiers en veille permanente limite l’intérêt. Une multiprise à interrupteur, ou des réglages de veille profonds, peuvent alors faire plus que le choix Oled vs Mini-Led sur certains profils.

À ce stade, une question s’impose: comment choisir une TV en 2026 en tenant compte du HDR, du budget et de l’énergie, sans tomber dans le marketing? La section suivante explore les critères d’achat, les tendances du marché et les signaux à surveiller dans les fiches techniques.

Choisir une TV HDR en 2026 : tendances, comparatifs et signaux concrets sur la consommation énergétique

Le marché des TV évolue vite. Les dalles gagnent en luminosité, les processeurs d’image deviennent plus agressifs, et les plateformes de streaming poussent le HDR comme standard premium. Dans ce contexte, acheter une TV ne se résume plus à “Oled ou LCD”. Il faut aussi regarder la gestion d’énergie, car la course aux nits peut avoir un coût électrique. Heureusement, plusieurs indicateurs permettent d’éviter les mauvaises surprises.

En magasin, les comparatifs mettent souvent en avant le pic lumineux maximal. Pourtant, ce chiffre ne dit pas tout. Une TV peut afficher 3000 cd/m² sur une petite fenêtre, tout en maintenant une luminosité moyenne raisonnable sur un film. À l’inverse, un mode d’image trop flatteur peut maintenir une luminance élevée en continu, ce qui gonfle la consommation énergétique. Donc, l’important est la politique de gestion de la lumière, pas seulement le record.

Mini-Led : zones, algorithmes et risque de surconsommation “invisible”

Le Mini-Led a pour lui la puissance. Il brille dans les pièces lumineuses, sur le sport, et sur certains contenus HDR très “spectacle”. Toutefois, la dépense d’énergie dépend du nombre de zones, mais aussi de la façon dont le rétroéclairage est piloté. Un local dimming réactif peut réduire l’activation des zones, tandis qu’un algorithme conservateur garde plus de zones allumées pour éviter le blooming. Or, éviter le blooming peut coûter du courant.

Dans un comparatif, il est utile de rechercher des tests qui mesurent la consommation en lecture réelle. Sinon, les étiquettes énergétiques donnent une tendance, mais elles ne reflètent pas toujours un film Dolby Vision lumineux. D’ailleurs, certains modèles sont calibrés pour obtenir une bonne note, puis offrent un mode “débridé” très consommateur. Il faut donc lire entre les lignes.

Oled : efficacité sur les scènes sombres, vigilance sur les interfaces et le plein écran lumineux

L’Oled garde souvent un avantage dès que l’image comporte de grandes zones noires. C’est typique du cinéma, donc l’usage HDR “film” lui est favorable. En revanche, une interface très claire, un menu, ou un jeu lumineux peuvent augmenter la luminance moyenne. Dans ces cas, la consommation énergétique remonte. De plus, les systèmes de protection (ABL) peuvent réduire la luminosité sur plein écran blanc. Cela limite la dépense, mais cela peut surprendre visuellement.

Pour une personne qui consomme beaucoup de films et séries HDR, l’Oled combine souvent contraste et sobriété. Pour un usage plein jour, sport, et contenus très lumineux, un Mini-Led peut rester plus confortable, même si le coût électrique grimpe. Le choix devient donc un arbitrage entre confort visuel et économie d’énergie.

Prix, tailles et modèles : pourquoi 65 pouces reste le vrai point d’équilibre

La taille influence la consommation, car une surface plus grande demande plus de lumière pour une luminance donnée. Le 65 pouces reste un format très répandu, donc les tests et retours sont plus nombreux. De plus, il existe une concurrence forte sur les prix. À titre d’exemple, un Mini-Led 65 pouces de série récente peut se trouver autour de la barre des 1000 euros selon les vendeurs, ce qui attire des profils qui hésitent face à l’Oled.

Pourtant, le coût total ne s’arrête pas à l’achat. Entre deux TV proches en prix, une différence de 15 à 25 euros par an sur la facture d’électricité peut compter sur plusieurs années, surtout si le HDR est quotidien. Ce n’est pas décisif pour tout le monde, mais c’est un paramètre rationnel. En somme, le meilleur choix est celui qui aligne usage réel, qualité HDR et coût électrique sur la durée.

Le mode HDR consomme-t-il toujours plus qu’un mode standard (SDR) ?

Souvent oui, car le HDR pousse la luminosité et les pics, donc la consommation énergétique monte. Cependant, l’écart dépend du contenu (sombre ou lumineux), du mode d’image, et de la technologie (Oled vs Mini-Led). Un film très sombre en HDR sur Oled peut rester relativement sobre, tandis qu’un contenu très lumineux peut coûter plus cher.

Combien coûte un film HDR sur la facture d’électricité ?

Avec des mesures typiques sur un film d’environ 1 h 55, on peut observer autour de 0,18 kWh sur une TV Oled et environ 0,44 kWh sur une TV Mini-Led, selon les réglages. En multipliant par le prix du kWh, cela représente quelques centimes par séance. Le coût électrique exact varie toutefois avec le tarif et le mode HDR choisi.

Quels réglages donnent le meilleur compromis HDR et économie d’énergie ?

Un mode cinéma ou Filmmaker bien réglé, une baisse légère de la luminosité/rétroéclairage, et la désactivation des options de “boost” agressives sont les leviers les plus efficaces. Il est aussi utile d’activer une veille profonde et de limiter les fonctions réseau inutiles, car une TV reste un appareil électronique connecté même hors lecture.

Mini-Led ou Oled : lequel choisir si l’objectif est de réduire la consommation énergétique en HDR ?

Sur des films HDR, l’Oled est souvent avantagé grâce à l’extinction pixel par pixel, surtout dans les scènes sombres. En revanche, pour une pièce très lumineuse, un Mini-Led peut offrir un confort supérieur, mais il risque d’augmenter le coût électrique. Le meilleur choix dépend donc du nombre d’heures HDR, de la luminosité de la pièce et du type de contenus regardés.