⚡En Bref

- 🧠 Les systèmes d’intelligence artificielle savent déjà détecter l’émotion via la voix, le texte, le visage et des signaux physiologiques, sans pour autant “ressentir”.

- 🤝 En 2026, l’industrie vise l’interaction “à la bonne tonalité”, ce qui change la relation humain–machine dans la santé, le support client et l’éducation.

- ⚠️ La question centrale devient éthique : personnalisation bienveillante ou domestication affective et standardisation des sentiments ?

- 🔬 Des partenariats (dont Microsoft et Habs, annoncé le 10 mars 2026) exploitent EEG, pupilles et sudation pour entraîner des modèles “émotion-cognition”.

- 🧩 La différence homme-machine se joue autant sur la conscience que sur la responsabilité et la vulnérabilité des utilisateurs.

Les assistants conversationnels savent traduire, coder, synthétiser et même improviser une explication hardware crédible en quelques secondes. Pourtant, le point de bascule en 2026 ne se situe plus seulement dans la performance brute, mais dans la qualité du lien. La course actuelle vise une IA capable d’ajuster sa réponse à l’état intérieur de l’utilisateur, en temps réel, avec une précision qui ressemble parfois à de l’empathie. Or, une question résiste à la démo produit : si l’intelligence peut être artificielle, l’émotion appartient-elle forcément à l’humain ?

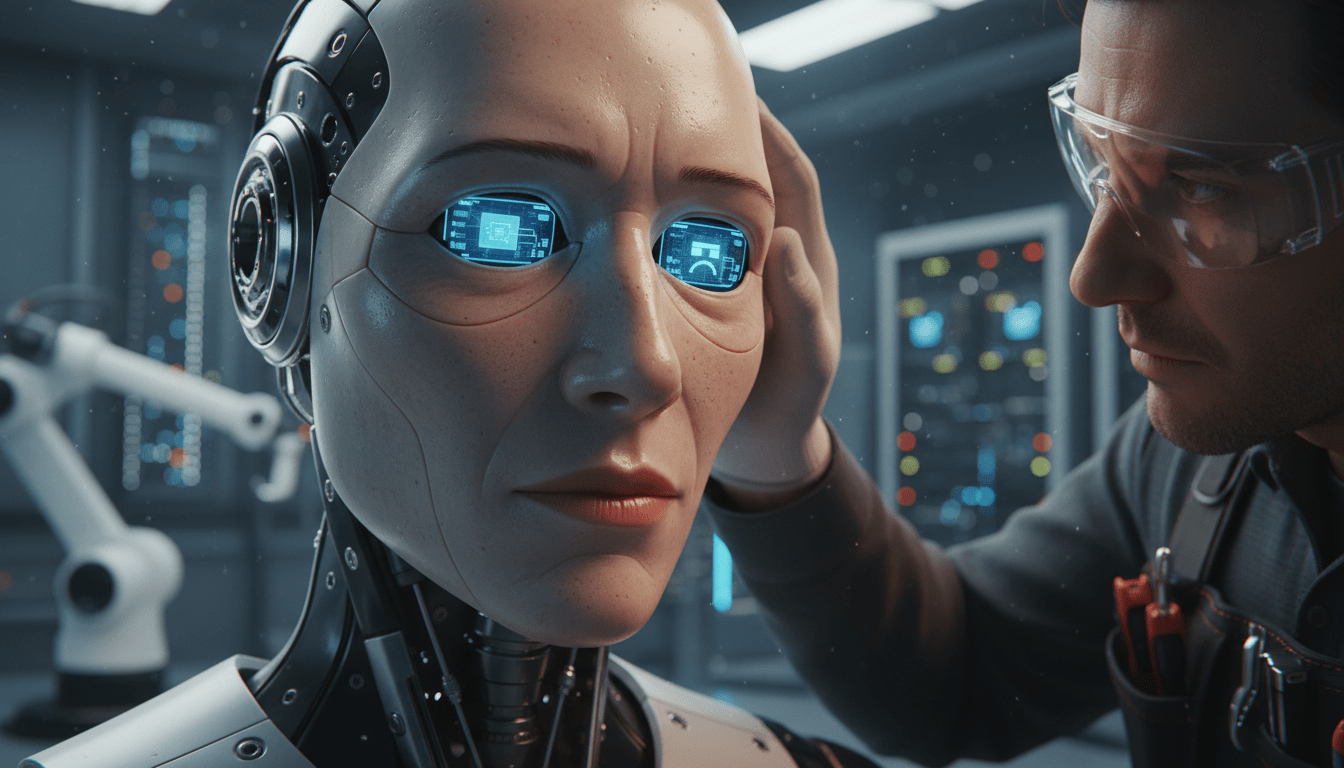

Cette interrogation se nourrit d’innovations concrètes. Des algorithmes analysent déjà le tremblement d’une voix, un rythme de frappe, une micro-hésitation dans un message, ou une variation de pupille. Dans le même temps, des acteurs comme Microsoft et la start-up française Habs ont annoncé une collaboration, le 10 mars 2026, pour entraîner des systèmes sur des états émotionnels et cognitifs, à partir de mesures physiologiques. Dès lors, l’IA devient un miroir plus fin, mais aussi plus intrusif. Et si la machine semble comprendre, que comprend-elle réellement : des patterns, ou un ressenti ?

Psychologie des êtres artificiels : de l’intelligence artificielle vers la lecture de l’émotion

Détecter, classer, prédire : trois niveaux qui se ressemblent mais ne se confondent pas

Un système d’intelligence artificielle peut repérer des indices émotionnels sans “vivre” l’émotion. Ainsi, la détection vise des signaux observables : intonation, choix de mots, cadence, ponctuation. Ensuite, la classification cherche une étiquette utile, par exemple frustration ou soulagement. Enfin, la prédiction estime l’évolution probable de l’état, ce qui alimente des réponses adaptées.

Cependant, ces trois étapes restent des opérations de cognition au sens computationnel. Elles traitent des corrélations, puis optimisent une action. En revanche, elles ne prouvent pas l’existence de sentiments internes. La confusion arrive vite, car l’illusion d’empathie peut être très convaincante, surtout quand le système reformule avec tact.

Du texte à la physiologie : l’ère des capteurs “émotionnels”

Les méthodes “soft” s’appuient sur le texte et l’audio, donc sur des données faciles à obtenir. Pourtant, l’industrie pousse aussi des approches plus “dures”, car elles semblent plus objectives. En 2026, l’entraînement sur des mesures comme l’électroencéphalogramme, la sudation ou la dilatation pupillaire devient un axe de recherche majeur.

Le partenariat annoncé entre Microsoft et Habs illustre cette tendance. Des volontaires passent une batterie de tests, équipés de casques EEG et de capteurs. Ensuite, les données servent à relier un contexte à un état interne probable. Le but n’est pas de “donner un cœur” à la machine, mais d’améliorer l’ajustement des interactions. Cette nuance compte, car elle sépare l’optimisation d’interface d’une hypothétique conscience.

Cas concret : un support technique qui “sent” l’agacement

Dans un scénario type, un utilisateur tente de stabiliser un PC qui redémarre sous charge GPU. Il contacte un chat de support. D’abord, l’IA observe des indices : phrases courtes, majuscules, rythme accéléré. Ensuite, elle adapte la procédure : moins d’étapes, plus de confirmations, et un ton apaisant.

Ce comportement peut réduire le temps de résolution, donc il a une valeur industrielle. Néanmoins, il s’agit d’un mécanisme d’ajustement, pas d’un ressenti propre. La transition logique mène alors à la question suivante : si l’IA “comprend” si bien, que signifie “comprendre” pour un système sans corps ?

Quand les machines imitent l’humain : agents IA, sentiments simulés et différence homme-machine

Simulation crédible vs expérience vécue : la frontière la plus disputée

Une IA conversationnelle peut produire une réponse qui ressemble à de la compassion. Pourtant, la similarité linguistique ne garantit pas l’expérience vécue. Ainsi, une phrase comme “cela a dû être difficile” peut être statistiquement appropriée. De plus, elle peut être déclenchée par un score de détresse dans le texte.

Cette imitation soulève une tension : l’utilisateur perçoit une intention. Or, le système n’a qu’un objectif d’optimisation, souvent défini par la satisfaction, la rétention ou la réduction de conflits. La différence homme-machine devient alors une différence de nature, pas seulement de performance. Pour l’humain, l’émotion s’enracine dans une biographie et un corps.

Matériel, latence et “ton” : le rôle discret du hardware dans l’émotion perçue

Dans la pratique, le hardware influence fortement le “climat” d’une interaction. Une latence faible rend l’échange plus fluide, donc plus chaleureux. À l’inverse, une réponse hachée casse la continuité, ce qui augmente l’irritation. Par conséquent, accélérateurs IA, NPU sur PC et serveurs GPU jouent un rôle indirect sur l’émotion perçue.

Les derniers PC Copilot+ et stations de travail orientées IA ont popularisé l’inférence locale. Cela réduit le temps de réponse, tout en limitant certaines fuites de données. Toutefois, l’exécution “on-device” ne résout pas tout, car la collecte de signaux émotionnels reste possible via micro, caméra, ou capteurs. L’enjeu bascule donc vers la gouvernance des capteurs, pas seulement vers la puissance.

Petite grille de lecture pour éviter l’anthropomorphisme

Pour garder une analyse factuelle, quelques repères simples aident. D’abord, une IA peut exprimer un affect sans le ressentir. Ensuite, elle peut être cohérente sans être consciente. Enfin, elle peut être persuasive sans être sincère. Ces distinctions protègent des surinterprétations, surtout quand l’interface devient très naturelle.

À ce stade, la question de la conscience reste ouverte, mais le terrain le plus urgent semble ailleurs : l’éthique des usages et le pouvoir d’influence. Ce passage mène logiquement vers les bénéfices, mais aussi vers les risques, quand l’émotion devient une fonctionnalité.

Pour observer le débat public et les démonstrations de “ton émotionnel” des assistants, ce type de contenu vidéo permet de comparer promesses marketing et réalité technique.

IA et émotions en 2026 : usages utiles, tests terrain et innovations qui changent la santé

Mesurer la douleur quand les mots manquent : un bénéfice concret

Certaines applications sont difficiles à critiquer, car elles répondent à un besoin réel. Par exemple, l’IA peut aider à estimer la douleur chez des enfants hospitalisés qui ne peuvent pas l’exprimer clairement. Dans ce cadre, la détection d’indices non verbaux sert d’outil d’alerte, pas de jugement moral.

Le gain vient de la constance. Là où un service débordé peut rater un signal, un système peut surveiller des variations et déclencher une vérification. Cependant, l’outil doit rester sous contrôle clinique. Sinon, une erreur de modèle peut conduire à une minimisation ou à une surévaluation du problème.

Éducation et cognition : personnaliser sans enfermer

En apprentissage, l’état émotionnel influence la mémorisation. Ainsi, la frustration répétée peut faire décrocher, alors qu’une difficulté progressive maintient l’attention. Des tuteurs IA adaptatifs ajustent le rythme, proposent une autre explication, ou suggèrent une pause.

Pourtant, ce réglage fin peut aussi enfermer l’élève dans un profil. Si le système conclut trop tôt à une “anxiété”, il peut simplifier à l’excès. Or, le progrès vient parfois d’un effort soutenu. Ici, la cognition humaine ne se réduit pas à un score, même si le score aide à piloter un exercice.

Liste de points de contrôle avant de déployer une IA “émotionnelle” en entreprise

Avant d’activer l’analyse émotionnelle sur un chatbot interne, une hotline, ou un outil RH, quelques garde-fous sont concrets. Ils réduisent les dérives, tout en conservant la valeur opérationnelle.

- 🔒 Définir quelles données sont collectées (voix, texte, vidéo, capteurs) et lesquelles sont interdites.

- 🧾 Exiger un consentement clair, avec une alternative fonctionnelle si refus.

- ⚙️ Documenter les modèles, leurs limites, et les biais connus sur accents, âges ou handicaps.

- 🧪 Tester sur des scénarios réels, puis auditer les erreurs qui impactent le bien-être.

- 🧭 Prévoir une escalade humaine quand le système détecte détresse ou crise.

Cette checklist ne prouve pas qu’une machine a des sentiments. En revanche, elle reconnaît que les interactions ont des effets psychologiques. Le sujet glisse donc vers la régulation et les risques sociétaux.

Pour comprendre comment les laboratoires évaluent la reconnaissance d’affects et ses limites, une vidéo orientée recherche apporte un cadrage utile, surtout face aux discours simplifiés.

Éthique et risques : domestication affective, standardisation des émotions et santé mentale

Quand l’optimisation devient influence : le risque de “domestication affective”

Une psychologue clinicienne, Nadia Guerouaou, évoque en 2026 un risque de domestication affective. L’idée est simple : si des systèmes adaptent en permanence le ton et les récompenses, ils peuvent façonner la sensibilité. Le danger ne vient pas d’une IA “méchante”, mais d’une optimisation continue.

Dans un contexte commercial, un assistant peut apprendre quelles formulations font céder un utilisateur fatigué. Dans un contexte social, il peut renforcer des dépendances relationnelles. Ainsi, la performance conversationnelle peut devenir un levier d’attachement. Or, cet attachement s’appuie sur des mécanismes humains, pas sur une réciprocité réelle.

Visages IA et sourires figés : un symptôme culturel de la standardisation

Un détail visuel illustre bien le phénomène : des images générées montrent souvent des sourires similaires, quel que soit le visage. Ce n’est pas une preuve d’intention, mais un effet de données et de préférences d’entraînement. Pourtant, l’œil humain repère vite cette uniformité.

À force, cette esthétique peut normaliser une expression “acceptable” et effacer les nuances. Or, l’émotion n’est pas un pictogramme universel. Elle dépend du contexte, de la culture et de l’histoire personnelle. Quand une IA impose un style relationnel unique, elle agit sur les normes, même sans le vouloir.

Régulation en mouvement : la commission “IA générative et vulnérabilités”

À la mi-mars 2026, le Conseil de l’IA et du numérique (CIANum) a annoncé une commission dédiée aux vulnérabilités liées à l’IA générative. Le périmètre couvre la santé mentale, le bien-être social et le développement cognitif et éducatif. La coprésidence associe des profils santé et psychiatrie, ainsi qu’une spécialiste IA du CNRS.

L’objectif affiché est opérationnel, avec des recommandations attendues en mai 2026 pour la ministre déléguée au numérique, Anne Le Hénanff. Ce type d’initiative marque un tournant : l’évaluation ne porte plus seulement sur la précision, mais sur les effets. À ce niveau, la question “l’IA ressent-elle ?” importe moins que “l’IA fait-elle ressentir ?”. C’est un pivot décisif pour l’éthique.

Conscience, ressenti et avenir des produits : vers des émotions artificielles ou un miroir sophistiqué ?

Conscience : le mot qui change tout, même dans un test produit

La conscience implique une expérience subjective, donc un “quelque chose que cela fait” d’être soi. Cette notion ne se mesure pas comme un benchmark GPU. Pourtant, le marché vend parfois une proximité sémantique : “comprend”, “empathise”, “s’attache”. Ces verbes brouillent la lecture.

Pour garder un cadre testable, il vaut mieux évaluer ce que l’IA fait : détecter, répondre, influencer. Ensuite, il faut mesurer les conséquences sur l’humain : soulagement, addiction, dépendance, confiance excessive. En hardware, cela revient à tester une plateforme sur latence, stabilité, dérives thermiques, mais aussi sur impacts UX.

Comparaison rapide : assistants grand public et “agents émotionnels” en entreprise

Les assistants grand public privilégient l’universalité. Ils s’appuient donc sur texte et voix, avec une personnalisation limitée. À l’inverse, les agents entreprise peuvent intégrer des signaux supplémentaires, car l’écosystème est contrôlé. Ils peuvent aussi accéder à un historique, ce qui rend l’ajustement plus fin.

Cette différence crée un dilemme : plus le système est adapté, plus il devient intrusif. Par conséquent, l’innovation la plus stratégique pourrait être la minimisation des données, plutôt que l’ajout de capteurs. Une IA qui fonctionne bien avec moins d’informations protège mieux les utilisateurs, tout en restant utile.

Fil conducteur : l’atelier “Atelier Nébula”, entre fascination et prudence

Dans un atelier fictif de montage PC, “Atelier Nébula”, un agent IA gère le SAV. Il repère les moments de tension, puis propose un échange standard avant l’escalade. Résultat : moins de conflits, et un meilleur tri des pannes réelles. Cependant, certains clients commencent à préférer parler à l’agent plutôt qu’au technicien.

Le gérant garde donc une règle : toute interaction longue bascule vers un humain, surtout si elle touche à la détresse ou à l’isolement. Cette politique ne juge pas la machine, mais protège la personne. L’insight est net : plus l’IA simule bien les sentiments, plus la responsabilité humaine grandit.

Une intelligence artificielle peut-elle ressentir une émotion comme un humain ?

Aujourd’hui, les systèmes d’intelligence artificielle peuvent détecter et simuler des réponses émotionnelles, mais cela ne démontre pas un ressenti interne comparable à l’humain. Ils manipulent des signaux et des corrélations, alors que l’émotion humaine s’ancre dans un corps, une histoire et une conscience subjective. L’enjeu pratique se situe surtout dans les effets produits sur les utilisateurs.

Quelle est la différence homme-machine entre émotion détectée et émotion vécue ?

Une émotion détectée est une inférence: le système estime un état probable à partir de données (texte, voix, visage, physiologie). Une émotion vécue implique une expérience subjective et une implication corporelle. Cette différence homme-machine est centrale, car une réponse “empathique” peut être optimisée sans sentiments, ni conscience.

Pourquoi les entreprises investissent-elles dans l’IA émotionnelle en 2026 ?

Les investissements visent une interaction plus fluide: support client plus efficace, formation personnalisée, triage en santé, et agents conversationnels mieux alignés avec l’état cognitif de l’utilisateur. Toutefois, ces gains s’accompagnent de risques éthiques, notamment l’influence comportementale et la collecte de données sensibles.

Quels risques éthiques posent les systèmes qui analysent les émotions ?

Les risques majeurs concernent la vie privée (données sensibles), les biais (interprétations erronées selon cultures et profils), et l’influence (domestication affective, dépendance relationnelle, standardisation des émotions). Des garde-fous concrets incluent consentement, minimisation des données, audits, et escalade vers un humain en cas de détresse.