⚡En Bref

- 🧭 Les robots autonomes progressent vite, cependant l’autonomie totale sur champs de bataille reste rare hors scénarios contrôlés.

- 🤖 Les humanoïdes très médiatisés (dont certains modèles d’Unitree) montrent une mobilité bluffante, mais l’enjeu clé demeure l’intelligence artificielle embarquée et la perception.

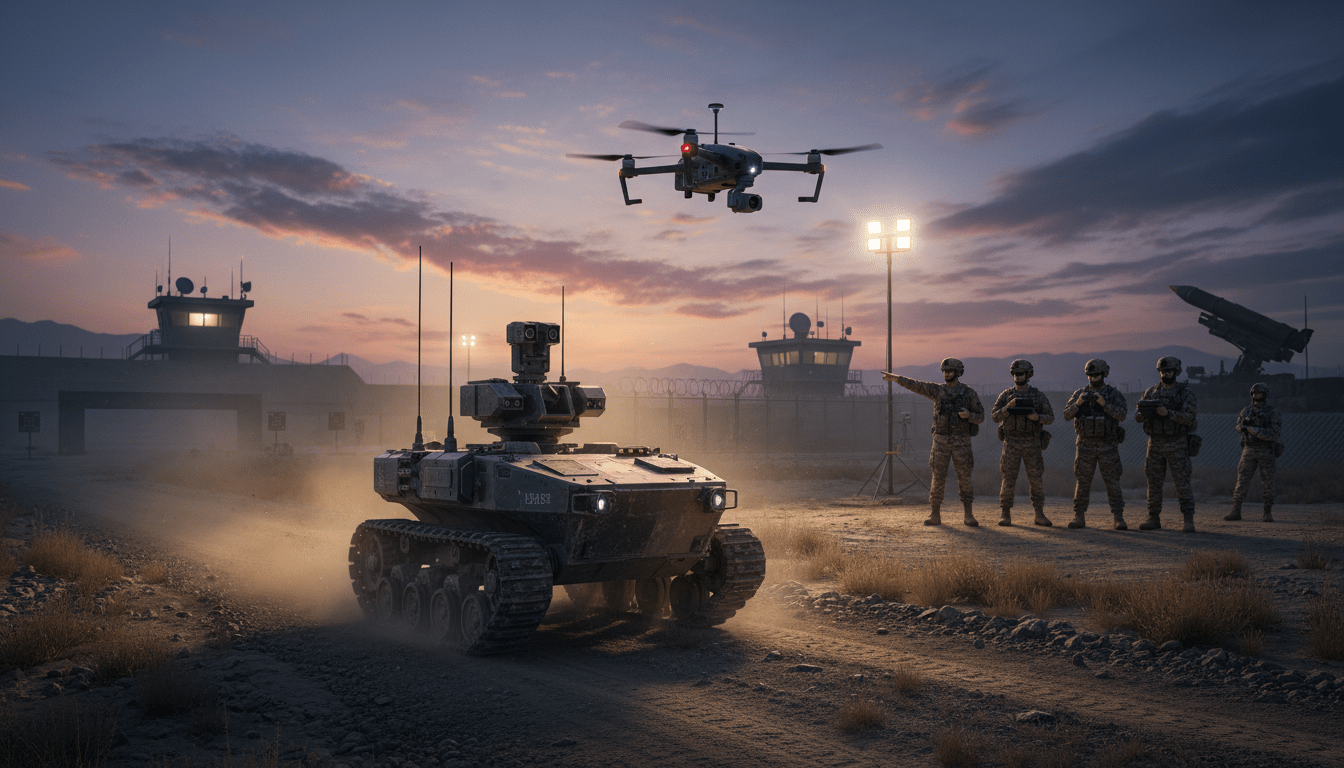

- 🛰️ Les drones et robots terrestres (chenillés, quadrupèdes) s’intègrent plus facilement au militaire car ils répondent déjà à des besoins concrets.

- 🛡️ La cyberdéfense devient un pivot: un robot compromis peut devenir un capteur pour l’ennemi, voire une arme retournée.

- ⚖️ Les débats sur l’armement autonome et le contrôle humain s’intensifient, tandis que la sécurité et l’identification de cibles restent les verrous majeurs.

Entre vidéos spectaculaires, démonstrations de salon et réalités du terrain, l’idée de robots autonomes opérant sur les champs de bataille intrigue autant qu’elle inquiète. Les armées observent, testent et intègrent déjà des systèmes robotisés, notamment des drones et des plateformes terrestres, car la valeur opérationnelle est immédiate: reconnaissance, logistique, déminage, appui. Pourtant, le pas vers une autonomie complète, capable de fonctionner dans un environnement chaotique sans équipe d’ingénieurs à proximité, reste difficile. Les capteurs se trompent, les communications se dégradent, et le terrain change sans prévenir.

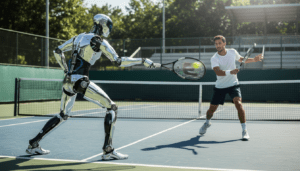

Le contraste est frappant: d’un côté, des humanoïdes agiles et photogéniques, souvent utilisés comme vitrine de technologie; de l’autre, des robots plus discrets, robustes et spécialisés, déjà utiles au militaire. La question centrale n’est donc pas “si” des robots seront présents, mais “comment” ils seront intégrés à la stratégie militaire et sous quel niveau de contrôle humain. Et au milieu, un enjeu transversal s’impose: la cyberdéfense, car tout système connecté est aussi une cible.

Robots autonomes sur les champs de bataille : de la démonstration virale à la réalité opérationnelle

Quand une vidéo “trop parfaite” révèle l’état du débat

Des séquences circulent régulièrement, montrant des robots humanoïdes armés patrouiller ou “combattre” sur des champs de bataille. Or, certaines de ces vidéos se révèlent générées par intelligence artificielle, ce qui brouille la perception publique. Pourtant, elles s’appuient souvent sur des plateformes bien réelles, comme des humanoïdes conçus par des acteurs chinois très visibles. Ainsi, l’imaginaire du “robot-soldat” se nourrit d’images plausibles, alors même que la scène est truquée.

Ce décalage a un effet concret: il pousse les décideurs à demander des preuves, des métriques et des essais répétables. En parallèle, il incite les industriels à accélérer leur communication. Cependant, une démo de mobilité ne valide pas un usage militaire en zone contestée. Un robot qui marche bien sur un sol propre n’est pas forcément stable dans la boue, sous fumigènes, ni sous brouillage.

Le vrai verrou: perception, décision et “bon sens” machine

La mobilité hardware progresse vite, car moteurs, réducteurs, batteries et contrôle-commande ont bénéficié d’années de R&D. Néanmoins, la partie la plus fragile reste la compréhension du monde réel. Il faut détecter un obstacle, distinguer un civil d’un combattant, puis décider sous stress. Or, un modèle d’intelligence artificielle se comporte très bien dans un cadre appris, mais il déraille quand le contexte sort du “catalogue”.

Dans des laboratoires et centres de recherche, l’écart entre environnement contrôlé et terrain réel est un sujet constant. Les chercheurs rappellent que les démonstrations sont souvent “assistées”, même quand cela n’apparaît pas. D’ailleurs, dès qu’un robot tombe, se coince ou perd sa localisation, il faut une équipe pour le remettre d’aplomb. Sur un champ de bataille, cette assistance n’existe pas.

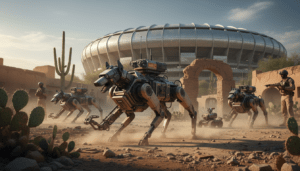

Étude de cas fictive: l’exercice “Aster-Field”

Lors d’un exercice prospectif imaginé, “Aster-Field”, une unité teste trois machines: un quadrupède de reconnaissance, un petit chenillé logistique et un humanoïde destiné à la manipulation. Au début, tout fonctionne. Ensuite, la poussière sature les caméras, et le GPS devient instable. Le quadrupède continue grâce à la fusion de capteurs, mais l’humanoïde perd du temps à “réinterpréter” les scènes. Le chenillé, lui, reste utile car sa mission est simple: livrer des munitions à un point précis.

La leçon est nette: plus la tâche est ouverte, plus l’autonomie est risquée. C’est précisément pour cela que l’intégration se fait par paliers, avec des règles et un contrôle. La suite logique mène vers les architectures de commande, puis vers la cyberdéfense qui protège l’ensemble.

Technologie militaire : quels robots et drones sont les plus crédibles à court terme ?

Pourquoi les drones dominent déjà la robotisation

Les drones se sont imposés car ils offrent un rapport coût/efficacité favorable. Ils étendent la vision, réduisent le risque humain et s’adaptent vite. De plus, leurs chaînes d’approvisionnement sont souvent plus flexibles que celles des véhicules lourds. Même quand la liaison radio est perturbée, certains modes de navigation permettent un retour ou une poursuite de mission limitée.

En pratique, les armées exploitent des familles complètes: micro-drones pour l’intérieur, quadricoptères pour l’observation courte portée, ailes fixes pour l’endurance. Ensuite, des charges utiles variées s’ajoutent: thermique, faible luminosité, relais radio, voire guerre électronique. Ainsi, la technologie évolue par modules, ce qui accélère l’adoption.

Robots terrestres: chenillés, roues et quadrupèdes

Au sol, les robots chenillés restent parmi les plus utiles. Ils franchissent mieux les débris et portent des charges. Par conséquent, ils servent au déminage, à la logistique sous le feu, ou à l’inspection d’itinéraires. Les plateformes à roues, elles, gagnent en autonomie sur routes, surtout pour des convois. Enfin, les quadrupèdes séduisent en milieux complexes, car ils passent des marches ou des terrains irréguliers.

Pourtant, chaque catégorie a ses limites. Un chenillé est bruyant et énergivore, donc détectable. Un quadrupède est agile, mais sa maintenance peut être délicate. Quant aux humanoïdes, ils promettent une compatibilité avec les infrastructures humaines. Néanmoins, leur rendement énergétique reste défavorable et leur robustesse doit encore mûrir.

Comparaison orientée hardware: ce qui compte vraiment sur le terrain

Les fiches marketing parlent de vitesse et d’agilité, alors que les militaires regardent d’autres critères. D’abord, l’endurance réelle, car une mission dure plus qu’une démo. Ensuite, la réparabilité, car une pièce cassée doit être remplacée vite. Enfin, la signature: bruit, chaleur, visibilité.

Pour clarifier, voici une liste de critères concrets souvent utilisés lors d’essais:

- 🔋 Autonomie énergétique mesurée en mission, pas en laboratoire.

- 📡 Résilience aux brouillages et modes dégradés sans liaison.

- 🧭 Navigation quand le GPS est absent ou trompé.

- 🛠️ Maintenance sur le terrain: modules, connecteurs, étanchéité.

- 👁️ Capteurs redondants: caméra, lidar, inertiel, thermique.

- 🔒 Cyberdéfense intégrée dès la conception.

Ce cadrage explique pourquoi les robots spécialisés progressent plus vite que les plateformes “généralistes”. Et logiquement, la réflexion glisse vers l’armement et les règles d’engagement, car la performance technique ne suffit pas.

Dans ce paysage, des acteurs très médiatisés, dont Unitree pour les humanoïdes, alimentent la vitrine. Cependant, le militaire privilégie souvent des systèmes moins “instagrammables”, mais plus fiables. Cette tension structure les choix à venir en stratégie militaire.

Armement autonome et intelligence artificielle : niveaux d’autonomie, contrôle humain et erreurs de ciblage

Du téléopéré au “fire-and-forget”: une échelle d’autonomie

Parler de robots autonomes sans préciser le niveau d’autonomie crée des malentendus. Un robot téléopéré dépend d’un opérateur qui voit, décide et agit. À l’inverse, un système autonome planifie et exécute avec une supervision minimale. Entre les deux, l’autonomie partielle est la norme: assistance à la navigation, suivi de trajectoire, stabilisation, ou évitement d’obstacles.

Dans les scénarios d’armement, la nuance devient cruciale. Un système peut acquérir une cible, mais demander une validation humaine. Il peut aussi limiter son action à une zone ou une fenêtre temporelle. Ainsi, le “contrôle humain significatif” se traduit en paramètres, en règles et en journaux d’événements.

Pourquoi l’identification reste l’épreuve reine

Sur un champ de bataille, les signaux sont ambigus. Des uniformes se ressemblent, des civils traversent, et des décoys apparaissent. Même avec des capteurs avancés, l’intelligence artificielle peut confondre une arme avec un outil, ou interpréter un geste. Par conséquent, les erreurs de classification sont l’obstacle le plus sensible, car elles touchent à la sécurité des non-combattants et à la légitimité des opérations.

Les spécialistes estiment souvent qu’il faut encore plusieurs années de progrès pour approcher une fiabilité robuste en terrain inconnu, surtout sans connectivité. Certaines analyses évoquent un horizon de cinq à dix ans pour des capacités nettement plus sûres, selon les missions. Toutefois, la tendance la plus réaliste consiste à limiter l’autonomie aux tâches à faible ambiguïté, puis à étendre progressivement.

Tests rigoureux: comment un “bon” modèle se casse la figure

Les tests modernes incluent des “pièges” conçus pour déstabiliser l’IA: fumée, contre-jour, silhouettes partielles, brouillage, ou objets adversariaux. Un robot peut réussir 99 fois, puis échouer à la 100e, ce qui est inacceptable pour certaines missions. Donc, les protocoles d’évaluation mettent l’accent sur les cas rares, pas seulement sur la moyenne.

Dans un scénario type, un drone repère un véhicule. Ensuite, une bâche thermique masque la signature. Le modèle hésite, puis bascule sur un mauvais label. À ce stade, soit l’humain valide et corrige, soit la mission est interrompue. Cette logique “fail safe” est une brique essentielle, car elle lie technologie, doctrine et stratégie militaire.

Une fois ces garde-fous posés, une autre question surgit: même parfaitement entraîné, un robot connecté peut-il rester digne de confiance face au piratage ? Le sujet conduit naturellement à la cyberdéfense.

Cyberdéfense et sécurité : protéger des robots autonomes contre le piratage et la guerre électronique

Un robot compromis devient un avantage pour l’adversaire

Un système robotisé combine capteurs, calcul, liaisons radio et mises à jour logicielles. Donc, il cumule les surfaces d’attaque. Si un adversaire infiltre la chaîne, il peut espionner, dégrader la mission, ou provoquer un incident. Dans le pire cas, un robot d’armement peut être détourné, ce qui transforme un atout en menace directe pour la sécurité des forces amies.

La guerre électronique amplifie ce risque. Un brouillage peut aveugler un drone, tandis qu’un leurre GNSS peut le déplacer. De même, un simple déni de service peut casser la coordination d’une flotte. Ainsi, l’autonomie doit inclure des modes dégradés et des mécanismes de repli.

Mesures techniques: du secure boot à la segmentation réseau

Les programmes sérieux exigent un secure boot et une chaîne de confiance matérielle. Ensuite, les communications sont chiffrées, authentifiées et surveillées. Par ailleurs, la segmentation limite les dégâts: un module compromis ne doit pas donner accès à tout. Dans les architectures modernes, les journaux d’événements sont signés, ce qui aide à détecter une altération.

Le hardware compte autant que le logiciel. Un composant non maîtrisé peut introduire une porte dérobée. C’est pourquoi certains acteurs investissent dans des SoC durcis, des HSM, et des capteurs avec attestation. De plus, la gestion des clés devient un sujet opérationnel, pas seulement informatique.

Cas d’école: la logistique autonome sous brouillage

Imaginons une base avancée qui utilise un petit robot terrestre pour livrer du matériel médical. L’itinéraire est connu, et l’objectif est simple. Toutefois, l’ennemi brouille les liaisons et perturbe le GNSS. Si le robot dépend du cloud, il s’arrête. En revanche, s’il possède des cartes locales, une odométrie fiable et une politique de repli, il termine la mission ou retourne au point de départ.

Cette robustesse se construit avec une approche “zéro confiance” adaptée au terrain. Autrement dit, aucun signal n’est considéré fiable par défaut. Grâce à cette posture, la cyberdéfense devient une partie intégrante de la stratégie militaire, au même titre que le camouflage ou la dispersion.

Une fois la sécurité technique adressée, il reste à comprendre comment les armées achètent, testent et industrialisent ces systèmes. C’est là que la logique d’écosystème et de marché pèse lourd.

Marché, tests terrain et stratégie militaire : comment les armées intègrent réellement les robots autonomes

Du prototype au déploiement: une chaîne de décisions

L’adoption militaire suit souvent une trajectoire en trois temps. D’abord, des essais rapides valident l’intérêt. Ensuite, des évaluations plus lourdes testent la tenue en conditions réelles. Enfin, l’industrialisation impose des contraintes de production, de support et de conformité. À chaque étape, des systèmes séduisants peuvent être écartés, faute de pièces, de formation ou de maintenance.

Les démonstrations publiques mettent en avant la performance. Cependant, les cahiers des charges internes insistent sur la disponibilité et le coût total. Un robot autonome excellent, mais fragile, perd face à une plateforme moyenne, mais réparable. Cette logique rappelle l’histoire de nombreuses technologie militaires, où la logistique décide autant que l’innovation.

Comparaisons de produits: humanoïdes vitrine vs robots utilitaires

Les humanoïdes attirent car ils peuvent manipuler des objets pensés pour des mains humaines. Néanmoins, ils restent chers et complexes. À l’inverse, un chenillé utilitaire fait moins rêver, mais il livre une valeur immédiate: transport, évacuation, pose de capteurs. Par conséquent, les achats initiaux se concentrent souvent sur les robots à mission claire.

Dans les catalogues 2025-2026, on observe aussi une montée des “kits” d’autonomie. Ils transforment un véhicule existant en plateforme semi-autonome, ce qui réduit les coûts. Ensuite, les armées peuvent réutiliser des châssis connus, tout en ajoutant une couche d’intelligence artificielle. Cette approche limite le risque et accélère l’intégration.

Fil conducteur: le groupe fictif “Atelier Northbridge”

Pour illustrer, un intégrateur fictif, “Atelier Northbridge”, reçoit une demande: sécuriser un périmètre et livrer du matériel sous menace. L’équipe compare trois solutions. D’abord, un humanoïde agile, parfait pour monter des escaliers. Ensuite, un quadrupède discret pour la reconnaissance. Enfin, un UGV chenillé robuste pour le transport.

Le choix final combine quadrupède et chenillé. Pourquoi ? Car la mission exige une fiabilité élevée et une maintenance simple. L’humanoïde est gardé pour des essais, notamment en environnement urbain. Cette décision illustre une règle pratique: la stratégie militaire adopte d’abord ce qui réduit le risque humain sans augmenter l’incertitude technique.

Au bout du compte, l’arrivée de robots autonomes sur les champs de bataille se fera par empilement d’usages, pas par une rupture hollywoodienne. Et ce sont les procédures, autant que les capteurs, qui trancheront la question.

Les robots autonomes sont-ils déjà utilisés sur les champs de bataille ?

Oui, sous des formes variées. Les drones et certains robots terrestres sont employés pour la reconnaissance, la logistique ou le déminage. En revanche, l’autonomie totale en environnement inconnu reste limitée, car la perception, la navigation dégradée et la sécurité logicielle posent encore des défis.

Pourquoi les drones progressent-ils plus vite que les humanoïdes en usage militaire ?

Parce qu’ils répondent à des missions plus directes et mesurables: observer, cartographier, relayer des communications. De plus, leur coût et leur déploiement sont souvent plus simples. Les humanoïdes, eux, exigent une robustesse mécanique et une intelligence artificielle de haut niveau pour des tâches très ouvertes.

Qu’est-ce que le “human-in-the-loop” pour l’armement autonome ?

C’est un mode où un humain valide une action critique, par exemple l’engagement d’une cible. Cette approche réduit le risque d’erreur d’identification et améliore la conformité aux règles d’engagement. Elle s’accompagne souvent de limites de zone, de temps, et d’une journalisation sécurisée.

Quel rôle joue la cyberdéfense dans les robots autonomes militaires ?

Elle est centrale. Un robot est un système connecté et capteur, donc une cible cyber. La cyberdéfense protège le démarrage sécurisé, les communications, les mises à jour et les clés cryptographiques. Sans ces protections, un adversaire peut espionner, désorienter ou détourner la plateforme, ce qui menace directement la sécurité des forces.

Quel horizon pour des robots vraiment autonomes en terrain hostile ?

Les estimations courantes évoquent plusieurs années de progrès pour gagner en fiabilité, notamment sur l’identification et la navigation sans assistance. L’évolution la plus probable passe par étapes: autonomie sur des tâches simples, puis extension graduelle, avec supervision humaine et tests terrain de plus en plus sévères.