⚡En Bref

- 📉 Amazon confirme une nouvelle vague de Licenciements : 16 000 postes concernés, dans un plan plus large visant 30 000 suppressions au total.

- 🏢 Les coupes touchent surtout les emplois de bureau et les niveaux managériaux, avec un discours centré sur la Réduction des coûts et la simplification interne.

- 🤖 L’Innovation technologique et l’IA servent de levier narratif, mais aussi de cap stratégique pour suivre la Concurrence au sein des GAFAM.

- 💰 Les économies visées (estimées autour de 6 milliards de dollars par an) doivent alimenter la Transformation numérique et les investissements IA sur le Marché mondial.

- ⚙️ Derrière l’annonce sociale, c’est une Stratégie d’entreprise de réallocation des ressources vers le cloud, les puces et l’IA appliquée qui se dessine.

Amazon avance vite, et le tempo n’a rien d’anodin. À la fin janvier, le Géant américain a confirmé une suppression de 16 000 postes, après une première salve enclenchée quelques mois plus tôt. Au total, 30 000 emplois doivent disparaître à l’échelle globale, un chiffre à mettre en perspective avec plus de 1,5 million de collaborateurs dans le monde. Pourtant, l’impact symbolique est fort, car il vise surtout les fonctions support, les strates de management et l’organisation interne, là où se joue la vitesse d’exécution.

En filigrane, une bataille se mène contre la Concurrence des autres GAFAM, à coups d’infrastructures cloud, d’outils d’IA générative, et de puissance de calcul. La trésorerie se tend, les attentes des marchés restent élevées, et l’entreprise doit financer sa Transformation numérique sans ralentir. Dans ce contexte, les Licenciements deviennent un instrument de pilotage : réduire les coûts, raccourcir les circuits de décision, et libérer des marges pour accélérer l’Innovation technologique sur le Marché mondial.

Licenciements chez Amazon : chiffres, périmètre et signaux faibles qui comptent

La confirmation de 16 000 suppressions a été présentée comme une étape d’un plan plus vaste : 30 000 postes retirés sur une fenêtre allant de l’automne à la fin janvier. En proportion, cela représente environ 2% des effectifs mondiaux, ce qui paraît limité. Néanmoins, la lecture change dès que le périmètre est précisé, car la cible concerne surtout le travail de bureau, donc les équipes qui structurent la feuille de route et l’exécution.

Cette distinction est cruciale. Les entrepôts ne sont pas le cœur affiché des coupes, tandis que les fonctions support, la coordination, et certains rôles administratifs le deviennent. Autrement dit, l’entreprise ne réduit pas seulement un volume, elle modifie une forme. Et quand une organisation taille dans ses couches managériales, la question implicite devient : quels arbitrages produit-on sur la vitesse, la qualité, et la capacité d’innovation ?

Une “correction Covid” qui ne dit pas tout

Officiellement, la justification renvoie au sur-recrutement de la période pandémie. L’argument est cohérent à l’échelle de la Silicon Valley, car de nombreux acteurs ont embauché fort entre 2020 et 2022. Pourtant, il ne suffit pas à expliquer l’insistance sur la réduction de la bureaucratie. En réalité, une correction d’effectifs n’a pas besoin de s’accompagner d’un discours sur les “niveaux hiérarchiques”, sauf si l’objectif vise aussi l’architecture interne.

Un exemple concret aide à comprendre. Dans une équipe produit typique, un empilement de validations peut ralentir un lancement de plusieurs semaines. Or, sur des cycles IA et cloud, quelques semaines peuvent coûter des parts d’usage. Donc, une Stratégie d’entreprise orientée vitesse privilégiera des équipes plus petites, avec des métriques plus directes. Ce choix peut séduire les investisseurs, mais il met aussi de la pression sur les équipes restantes.

Ce que “2%” signifie vraiment sur le terrain

Un pourcentage faible peut masquer des effets localisés. En France, une transposition théorique donnerait environ 500 emplois si l’on appliquait le taux à un effectif d’environ 25 000 personnes. Toutefois, les coupes ne se répartissent jamais de façon uniforme. Elles se concentrent sur des métiers, des divisions ou des géographies, ce qui change le vécu et la continuité des projets.

Par ailleurs, Amazon indique que des postes alternatifs peuvent être proposés lorsque c’est possible. Dans les faits, cette promesse dépend de la compatibilité des compétences, du niveau de séniorité et des localisations. Ainsi, un chef de programme peut difficilement basculer vers un rôle d’ingénierie sans passerelle. À la fin, le signal est limpide : la Réduction des coûts est un moyen, mais la reconfiguration opérationnelle est la finalité. Et ce mouvement prépare logiquement la bataille technologique décrite ensuite.

Concurrence GAFAM : pourquoi Amazon accélère sur l’IA et le cloud pour rester dans la course

La pression concurrentielle ne vient pas seulement des prix ou des parts de marché. Elle vient aussi de la perception : quel groupe “mène” sur l’IA, quels services deviennent des standards, et quelles plateformes captent les développeurs. Sur ce terrain, l’entreprise doit montrer des trajectoires nettes, car l’IA s’achète en calcul, en talents, et en data centers. Donc, les arbitrages financiers deviennent mécaniques.

Dans le même temps, un fait ressort : la visibilité médiatique des nouveaux modèles de langage estampillés Amazon reste moins forte que celle de certains rivaux. Cette réalité n’implique pas l’absence de R&D. Cependant, elle révèle une bataille d’écosystème. Sur le Marché mondial, un produit IA n’existe pas vraiment sans adoption massive, sans intégration simple, et sans coûts maîtrisés.

IA : productivité réelle ou argument financier ?

Le discours managérial lie souvent automatisation et simplification. Andy Jassy a déjà évoqué l’idée que des outils d’IA réduiraient certains besoins administratifs au fil du temps. Pourtant, plusieurs analystes estiment que l’effet direct sur l’emploi reste, à court terme, moins massif que la communication ne le suggère. Cette nuance compte, car elle montre une tension : l’IA sert d’axe industriel, mais elle sert aussi de récit de modernité.

Un cas d’usage typique illustre le sujet. Dans une équipe finance, un assistant IA peut accélérer la catégorisation de dépenses et la génération de rapports. Toutefois, il faut encore des validations, des audits, et des contrôles de conformité. Donc, le poste ne disparaît pas toujours. En revanche, la charge se réorganise, et un manager peut piloter plus large avec moins d’intermédiaires. Voilà pourquoi la réduction des niveaux hiérarchiques apparaît souvent en parallèle.

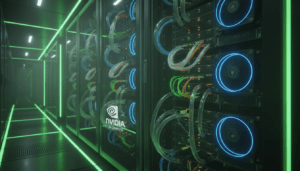

Le coût de la vitesse : calcul, data centers et dépendances matérielles

Accélérer en IA exige du matériel, pas seulement du logiciel. Cela passe par des GPU, des interconnexions rapides, du stockage, et une alimentation électrique stable. Or, ces postes pèsent sur la trésorerie. Dans les douze derniers mois, la marge de manœuvre financière s’est réduite, avec un excédent de trésorerie évoqué autour de 14 milliards de dollars, contre près de 70 milliards auparavant. Ce décrochage change le ton : il faut financer l’avenir tout en rassurant le marché.

Dans ce cadre, économiser environ 6 milliards de dollars par an via les Licenciements n’est pas qu’un chiffre. C’est un “budget IA” déguisé. Et ce budget alimente ensuite la Transformation numérique : services cloud plus agressifs, outils internes, et plateformes orientées développeurs. Le message est clair : la Concurrence se joue sur la cadence d’investissement, pas sur les communiqués.

Cette course à la puissance pose alors une question très concrète : quels choix techniques Amazon privilégie-t-il pour acheter du temps face aux autres GAFAM ? Le sujet devient matériel, donc mesurable, et c’est là que l’analyse hardware éclaire vraiment la stratégie.

Réduction des coûts et hardware : quand les licenciements financent l’infrastructure IA

Les grands modèles et les services cloud ne se construisent pas avec des slogans. Ils se construisent avec des racks, des fibres, des commutateurs, et des puces. Dès lors, une Réduction des coûts sur les fonctions de bureau peut être lue comme une réallocation vers l’infrastructure. Ce mécanisme est fréquent dans la tech : on réduit le “fonctionnement” pour augmenter le “capex”, c’est-à-dire l’investissement physique.

Dans un environnement où les GPU dominent les dépenses, la recherche d’efficience devient structurante. Cela implique des choix d’architecture : densité par baie, refroidissement, gestion énergétique, et optimisation réseau. Et, surtout, cela impose des compromis. Faut-il viser la performance brute, ou un coût par requête plus bas ? Cette question façonne l’offre cloud et, par ricochet, la compétitivité sur le Marché mondial.

Puces, accélérateurs et arbitrages de plateforme

Les hyperscalers poussent de plus en plus leurs accélérateurs maison. Cette logique réduit la dépendance à un fournisseur unique, tout en améliorant le coût total d’exploitation. Pour Amazon, cela s’inscrit dans une Stratégie d’entreprise classique : maîtriser la chaîne, de la puce au service managé. Cependant, un accélérateur interne doit convaincre les développeurs. Il doit offrir des outils, des bibliothèques, et des performances stables.

Un exemple parlant : une start-up fictive, “AtelierVision”, veut déployer un modèle de vision pour le retail. Si l’offre Amazon propose un coût inférieur par inférence, l’adoption grimpe. En revanche, si les outils de portage sont complexes, l’équipe bascule chez un concurrent. Ainsi, l’Innovation technologique ne se mesure pas qu’en téraflops. Elle se mesure en friction d’intégration.

Tests et critères concrets : ce que regardent les équipes IT

Dans les entreprises clientes, les responsables cloud évaluent des éléments très concrets. D’un côté, ils veulent des performances, mais de l’autre ils exigent une facture stable. Pour relier cela aux annonces sociales, il faut voir le lien : plus l’infrastructure est optimisée, plus Amazon peut baisser les prix ou ajouter des services sans rogner ses marges.

Voici une liste de critères observés lors de comparaisons multi-cloud, avec des points d’attention typiques :

- ⚙️ Coût par requête en IA (inférence) et variabilité selon la charge.

- 🔥 Gestion thermique et densité de calcul, car cela influe sur la disponibilité.

- 🔌 Efficacité énergétique des instances, cruciale avec la hausse des coûts électriques.

- 🧠 Écosystème logiciel (SDK, outils MLOps, compatibilité PyTorch/TensorFlow).

- 🛡️ Sécurité et conformité (chiffrement, audit, options souveraines selon pays).

Ces critères expliquent pourquoi les milliards économisés peuvent être “recyclés” en capacité de calcul. Et ce recyclage vise un objectif simple : mieux résister à la Concurrence des GAFAM sur les prix et sur la qualité de service. La prochaine étape consiste alors à comprendre comment cette mutation retombe sur l’organisation et les métiers.

Transformation numérique interne : moins de managers, plus d’automatisation, quels effets sur les métiers ?

Une entreprise qui réduit des niveaux hiérarchiques cherche souvent à raccourcir le chemin entre la décision et l’exécution. En théorie, cela augmente l’autonomie. En pratique, cela peut aussi accroître la charge, car les arbitrages remontent moins. Ainsi, la Transformation numérique ne s’arrête pas aux produits vendus, elle touche la manière de travailler : objectifs, outils, reporting, et coordination.

Chez Amazon, l’accent mis sur les postes de bureau suggère une volonté de “dé-bureaucratiser”. Toutefois, cette volonté a une contrepartie : l’entreprise doit remplacer des couches de coordination par des systèmes. Donc, des logiciels internes, des tableaux de bord, et des assistants IA deviennent des pièces d’organisation, pas seulement des gadgets.

Automatisation des tâches support : gains rapides, zones sensibles

L’IA générative excelle sur la synthèse, la recherche, et la rédaction standardisée. Par conséquent, les métiers support voient arriver des outils capables de produire des comptes rendus, des FAQ internes, ou des ébauches de documents. Cependant, les zones sensibles demeurent : confidentialité, hallucinations, et traçabilité des décisions. Dans une grande structure, une erreur se propage vite, donc les garde-fous doivent être stricts.

Un scénario concret éclaire le risque. Une équipe RH utilise un assistant pour harmoniser des descriptions de poste. Si l’outil introduit un biais ou oublie une contrainte légale locale, le document part quand même en validation. Ensuite, le problème devient opérationnel. Voilà pourquoi l’automatisation ne supprime pas la responsabilité, elle la déplace vers la supervision et la conformité.

Requalification et mobilité : promesse réaliste ou parcours du combattant ?

La proposition de reclassement interne existe, et elle est crédible dans certains cas. Néanmoins, elle dépend du timing et des compétences. Par exemple, un chef de projet peut évoluer vers un rôle de “program manager” plus technique, à condition d’avoir déjà un bagage cloud. À l’inverse, un profil purement administratif devra passer par une formation plus lourde.

À ce stade, l’enjeu devient social autant que technologique. Une Stratégie d’entreprise efficace ne se limite pas à réduire des lignes budgétaires. Elle maintient aussi la capacité d’exécution. Sinon, les économies se paient en retards, et la Concurrence gagne du terrain. L’insight est simple : l’IA peut remplacer des tâches, mais elle ne remplace pas la cohésion d’équipes bien outillées.

Marché mondial et perception investisseurs : pourquoi le récit “IA” pèse autant que les résultats

Sur les marchés, les annonces de Licenciements peuvent être interprétées comme un signal de discipline financière. Pourtant, l’histoire est assumée différemment selon le contexte. Si une entreprise coupe parce qu’elle décroche, la sanction arrive. À l’inverse, si elle coupe pour financer une bascule technologique, l’opération peut être saluée. C’est ici que le récit autour de l’Innovation technologique devient un actif.

Dans le cas d’Amazon, l’argument “IA” sert à transformer une nouvelle négative en accélération stratégique. De plus, il offre une grille de lecture compatible avec les attentes du moment : capex élevé, plateformes IA, et croissance du cloud. Cependant, les investisseurs ne se contentent pas d’une narration. Ils regardent la capacité à livrer des produits adoptés, et à le faire avant les autres GAFAM.

Les économies comme carburant : de la marge à l’investissement

Un ordre de grandeur circule : environ 6 milliards de dollars d’économies annuelles potentielles. Ce montant, réinjecté, peut financer des data centers, des achats de GPU, et des équipes de recherche. Donc, la Réduction des coûts devient un mécanisme de compétitivité. Et, sur le Marché mondial, la compétitivité se joue aussi sur le prix des services IA, qui peut baisser brutalement quand un acteur accepte de rogner sa marge.

Un exemple simple : si Amazon réduit le coût de certaines instances IA, une entreprise de e-commerce peut migrer des workloads pour économiser chaque mois. Ensuite, l’effet boule de neige démarre, car l’écosystème suit les volumes. Voilà pourquoi l’arbitrage interne se retrouve, quelques trimestres plus tard, dans des décisions d’achats IT un peu partout.

Quand la confiance dépend d’un catalogue et pas d’un communiqué

Les clients comparent. Ils testent. Ils benchmarkent des temps de réponse, des prix, et des garanties. Ainsi, le succès ne vient pas d’une annonce, mais d’un catalogue cohérent : modèles, API, outils de déploiement, et support. Pour rester audible face à la Concurrence, Amazon doit rendre ses offres IA évidentes, et surtout faciles à adopter.

Cette exigence explique aussi la quête de simplification interne. Une organisation plus plate peut livrer plus vite, à condition de préserver l’expertise. La phrase clé à retenir tient alors en un point : la bataille des GAFAM se gagne autant dans les data centers que dans l’organisation qui décide ce qu’on y déploie.

Pourquoi Amazon supprime-t-il 30 000 postes si cela ne représente qu’environ 2% des effectifs ?

Parce que l’effet recherché n’est pas seulement volumétrique. Amazon cible surtout des rôles de bureau et des niveaux hiérarchiques afin de réduire la bureaucratie, accélérer l’exécution et financer des priorités comme l’IA et le cloud sur le marché mondial.

Les licenciements chez Amazon sont-ils directement causés par l’intelligence artificielle ?

L’IA est un facteur, car elle automatise certaines tâches support et change les besoins en coordination. Toutefois, les coupes répondent aussi à une stratégie d’entreprise plus large : réduction des coûts, simplification organisationnelle et réallocation de budget vers l’innovation technologique.

Quels métiers sont les plus touchés par cette vague de licenciements ?

Les informations publiques indiquent surtout des postes de bureau, notamment des fonctions support et des strates managériales. Les entrepôts ne sont pas présentés comme la cible principale, ce qui montre une volonté de reconfigurer l’organisation plutôt que la logistique.

En quoi la concurrence des autres GAFAM pèse-t-elle sur ces décisions ?

Les autres géants accélèrent sur les plateformes IA, les services cloud et l’écosystème développeurs. Pour rester compétitif, Amazon doit investir massivement dans l’infrastructure et les outils, ce qui renforce la pression pour dégager des marges via la réduction des coûts.

Quelles métriques techniques les entreprises utilisent-elles pour comparer les offres IA d’AWS et des concurrents ?

Les entreprises regardent notamment le coût par requête (inférence), la performance et la stabilité des instances, l’efficacité énergétique, l’écosystème logiciel (SDK/MLOps) et les garanties de sécurité et conformité. Ces critères déterminent l’adoption, bien plus que la communication.